ĪĪĪĪAIōQ─śĄ─┼dŲęŌ╬Čų°łDŽ±╝╝ąg╚š┌ģ│╔╩ņŻ¼═¼Ģrę▓├µ┼R “AI ║┌«a”ĦüĒĄ─ŽĄ┴ąå¢Ņ}ĪŻĮ³╚šŻ¼░┘Č╚į┌ÖÓ═■DeepFakeĘ└é╬öĄō■╝»FaceForensics Benchmark╔Ž╦óą┬╝oõøŻ¼ęįš¹¾wÖz£y£╩┤_┬╩0.821Ą─│╔┐ā│¼įĮSOTAŻ¼ŅI┼▄ąąśIĪŻ

ĪĪĪĪfaceforensic-benchmark░±å╬ĮY╣¹

ĪĪĪĪFaceForensics Benchmark╩ŪĄ┬ć°─Į─ß║┌╣żśI┤¾īW(TUM)┬ō║ŽGoogleĄ╚ČÓ╝ęÖCśŗ╣▓═¼░l▓╝Ą─┤¾ęÄ─Ż╚╦─śé╬įņöĄō■╝»Ż¼ė├ė┌┤┘▀Mī”╚╦─śé╬įņÖz£yĄ─īWąg蹊┐Ż¼▓ó╠ß╔²╣żśIĮńī”ė┌╚╦─śĘ└é╬śIäš┬õĄžĄ─ųžęĢ│╠Č╚ĪŻFaceForensics BenchmarköĄō■╝»ōĒėą╦─ĘNśIĮńŽ╚▀MĄ─╚╦─śé╬įņ╝╝ągŻ¼Ęųäe╩ŪFace2FaceĪóFaceSwapĪóDeepFakes║═NeuralTexturesĪŻ▀@ą®é╬įņ│÷üĒĄ─╚╦─śłDŽ±ūį╚╗▒ŲšµŻ¼╚╦č█Äū║§¤oĘ©▒µäešµé╬Ż¼śO┤¾Ąž╠ßĖ▀┴╦╚╬äšļyČ╚ĪŻ

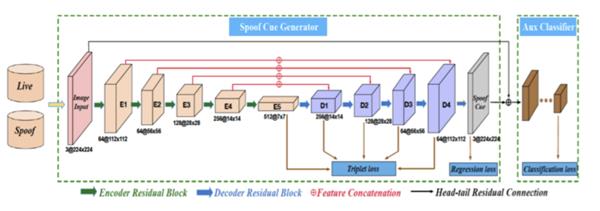

ĪĪĪĪ╗∙ė┌┤╦Ż¼░┘Č╚īóūį蹥─Learning Generalized Spoof Cue╦ŃĘ©(šō╬─ģó┐╝Ż║https://arxiv.org/pdf/2005.03922.pdf)ę²╚ļ╚╦─ś║Ž│╔łDŽ±Ķbäe╚╬䚯¼š¹¾wÖz£y£╩┤_┬╩▀Mę╗▓Į╠ßĖ▀Ż¼▓óĄŪĒöFaceForensics Benchmark░±å╬ĪŻ

ĪĪĪĪLGSCŠWĮjĮYśŗłD

ĪĪĪĪō■ŽżŻ¼LGSCĘĮĘ©ūŅįńė├ė┌ĮŌøQ╚╦─ś╗Ņ¾wĄ─Ķbäeå¢Ņ}Ż¼į┌ĮŌøQ╗Ņ¾wå¢Ņ}Ģrę²╚ļ«É│ŻÖz£yĄ─╦╝ŽļŻ¼╝┘įO╗Ņ¾w×ķŠ▀ėąŽÓ═¼╠žš„Ą─ķ]╝»Ż¼╗Ņ¾w╣źō¶×ķķ]╝»ęį═ŌĄ─ļx╚║śė▒ŠŻ¼ęįĮŌøQ╣źō¶ĘĮ╩ĮĄ─ČÓśėąįī”ė┌╗Ņ¾w┼ąäeą¦╣¹Ą─ė░ĒæŻ¼Ųõī”╣źō¶łDŽ±┼c╗Ņ¾włDŽ±ų«ķgĄ─┐╔ģ^Ęų╣źō¶ŠĆ╦„(Spoof Cue)▀MąąĮ©─ŻŻ¼īó╗Ņ¾wĄ─╣źō¶ŠĆ╦„Č©┴x×ķ┼c▌ö╚ļłDŽ±│▀Č╚ŽÓ═¼Ą─all-zero map,īó╗Ņ¾w╣źō¶Ą─╣źō¶ŠĆ╦„Č©┴x×ķnone-zero mapŻ¼įOėŗ┴╦ę╗ĘN╣źō¶ŠĆ╦„╔·│╔Ų„▀Mąą╣źō¶ŠĆ╦„╔·│╔▓óę²╚ļ▌oų·ĘųŅÉŲ„▀Mąą┬ō║Žė¢ŠÜĪŻ

ĪĪĪĪį┌─Żą═ė¢ŠÜ▀^│╠ųąŻ¼LGSCĘĮĘ©ų╗ī”╗Ņ¾w▀Mąą’@╩ĮĄ─L1 Regression Loss▒OČĮŻ¼ī”ĘŪ╗Ņ¾w▓╗▀Mąą╚╬║╬╗žÜw▒OČĮŻ¼═©▀^ļ[╩ĮĄ─ČÓ╝ētriplet Lossīó╗Ņ¾wśė▒Šį┌╠žš„┐šķgųą▀Mąą└ŁĮ³Ż¼īó╣źō¶śė▒Š═Ųļx╗Ņ¾wģ^ė“Ż¼═©▀^┼cįŁ╩╝łDŽ±Ą─Üł▓Ņ▀BĮė║═▌oų·ĘųŅÉŲ„▀Mę╗▓Į╠ß╔²╣źō¶ŠĆ╦„Ą─┐╔ģ^Ęųąį║═Ę║╗»ąįĪŻųĄĄ├ūóęŌĄ─╩ŪŻ¼LGSCĘĮĘ©═©▀^┬ō║Ž▒OČĮĄ─ĘĮ╩ĮīW┴ĢĄ├ĄĮ┴╦╝µŠ▀┐╔ģ^Ęųąį║═Ę║╗»ąįĄ─╣źō¶ŠĆ╦„Ż¼į┌ŅA£yĢrŲõ▓ó▓╗╩╣ė├ĘųŅÉŲ„▌ö│÷▀MąąĮY╣¹┼ąäeŻ¼Č°╩Ūų▒Įė╩╣ė├╣źō¶ŠĆ╦„łDĄ─┴┐╗»öĄųĄė├ė┌įu╣└ę╗ÅłłDŲ¼╩Ūʱ×ķ╣źō¶łDŽ±Ż¼įōĘĮĘ©ęčį┌ČÓéĆ╗Ņ¾wöĄō■╝»ųąĄ─ČÓĒŚprotocol╔ŽŠ∙╚ĪĄ├State Of The ArtĮY╣¹ĪŻ

ĪĪĪĪļSų°DeepFakeĪóFaceSwapĄ╚╚╦─śŠÄ▌ŗ╝░╔·│╔╝╝ągĄ─░lš╣Ż¼śO┤¾Ą─═Ųäė┴╦╚ń╠ōöMų„▓źĪó╚╦─ś║Ž│╔Ą╚ą┬┼dŖ╩śĘ╬─╗»Ą─æ¬ė├Ż¼Ą½═¼Ģrę▓Įo╚╦─ś░▓╚½Ä¦üĒ┴╦Øōį┌═■├{ĪŻ└²╚ń═©▀^ “ōQ─ś”╝╝ąg▀Mąą╔½ŪķęĢŅl╔·│╔Īó╠ōöMš■ų╬╚╦╬’ųvįÆĄ╚Ż¼ī”╔ńĢ■įņ│╔ć└ųž▓╗┴╝ė░ĒæĪŻėąš{▓ķ’@╩ŠŻ¼─┐Ū░Ą─AIōQ─śā░╚╗ęčĮøą╬│╔┴╦ę╗éĆ║┌«a«aśIµ£Ż¼╔Žė╬╠ß╣®▄ø╝■╝░╝╝ągĪóųąė╬╠ß╣®ęĢŅlĪóššŲ¼Č©ųŲĪóŽ┬ė╬╩█┘u│╔ŲĘęĢŅlŻ¼ę▓ėą╔╠╝ęū÷╚½«aśIµ£Ą─╔·ęŌŻ¼ęčįņ│╔ć└ųž╬Ż║”ĪŻ

ĪĪĪĪ┤╦═ŌŻ¼į┌ę╗ą®╩╣ė├╚╦─śūóāįūRäeł÷Š░Ž┬Ż¼┐╔─▄Ģ■┤µį┌▓╗Ę©Ęųūė═©▀^╔Žé„AI║Ž│╔╚╦─śłDŽ±Ų¾łD├╔╗ņ▀^ĻPĪŻę╗ŽĄ┴ą“ōQ─ś”╝╝ąg║Ž│╔Ą─╚╦─śłDŽ±║▄ļy═©▀^╚Ōč█▒µäešµé╬Ż¼╝ė╔Ž╚╦─śöĄō■╔µ╝░ĄĮė├æ¶Ą─ążŽ±║═éĆ╚╦ļ[╦ĮŻ¼┤█Ė─╚╦─śöĄō■ę▓īóī”ė├æ¶éĆ╚╦ą┼Žó░▓╚½įņ│╔═■├{ĪŻ

ĪĪĪĪ“ōQ─ś”ę²░lĄ─å¢Ņ}Ż¼ęčį┌śIĮńę²ŲÅVĘ║ĻPūóĪŻ░┘Č╚LGSCĘĮĘ©į┌īWąg蹊┐Ą─═¼Ģręč═Ļ│╔┬õĄžŻ¼░┘Č╚┤¾─Xęč╗∙ė┌įō╦ŃĘ©į┌╚╦─śūRäeĄ─╗Ņ¾w─ŻēKųą╩ū░lī”╚╦─ś║Ž│╔łDĶbäe─▄┴”Ż¼▓óį┌“╚╦─śÖz£y”Īó“H5ęĢŅl╗Ņ¾wÖz£y”Īó“į┌ŠĆ╗Ņ¾wÖz£y” APIųą╔ŽŠĆĪŻį┌ČÓĘN╗Ņ¾w╝╝ąg╝ė│ųĄ─╗∙ĄA╔ŽŻ¼ą┬į÷╣”─▄┐╔ęį£╩┤_ĶbäeAIōQ─ś╝╝ąg║═║┌┐═╣żŠ▀╔·│╔Ą─╚╦─śłDŽ±Ż¼░▓╚½Ą╚╝ēīŹ¼F▀MļAĪŻ┤╦═ŌŻ¼įōĒŚą┬╣”─▄į┌╚╦─śīÅ║╦Īóą┬┬äĶbšµĪ󹿎±ŠSÖÓĪó╔½ŪķłDŽ±īÅ║╦Ą╚ųTČÓĘĮ├µŠ∙ėą║▄Ė▀Ą─īŹė├ārųĄŻ¼▓╗āH▒Żūoų°ÅV┤¾éĆ╚╦ė├æ¶Ą─ą┼ŽóĪóÖÓ굯¼▀Ćģfų·Ų¾śI╠ß╔²┴╦ŲõĘ■äš░▓╚½ąįĪŻ

ĪĪĪĪ─┐Ū░Ż¼░┘Č╚ęčķ_Ę┼ŠĆ╔Ž║Ž│╔łDÖz£yĮė┐┌Ż¼║¾└mīó│ų└mā×╗»ßśī”▓╗═¼┬õĄžł÷Š░Ą─▓Ņ«É╗»─▄┴”Ż¼▒ŻšŽ╚╦─śŽÓĻPæ¬ė├Ą─░▓╚½Ż¼ęį╝╝ąg├└╗»╔·╗ŅŻ¼Ė³ęį╝╝ąg╩žūo╔·╗ŅĪŻ

ĪĪĪĪ╬─š┬ā╚╚▌āH╣®ķåūxŻ¼▓╗śŗ│╔═Č┘YĮ©ūhŻ¼šłųö╔„ī”┤²ĪŻ═Č┘Yš▀ō■┤╦▓┘ū„Ż¼’LļUūįō·ĪŻ

║Żł¾╔·│╔ųą...

║Ż╦ćAIĄ──Żą═ŽĄĮyį┌ć°ļH╩ął÷╔ŽÅV╩▄║├įuŻ¼─┐Ū░šŠā╚└█ėŗ─Żą═öĄ│¼▀^80╚féĆŻ¼║Ł╔wīæīŹĪóČ■┤╬į¬Īó▓Õ«ŗĪóįOėŗĪóözė░Īó’LĖ±╗»łDŽ±Ą╚ČÓŅÉą═æ¬ė├ł÷Š░Ż¼╗∙▒ŠĖ▓╔w╦∙ėąų„┴„äōū„’LĖ±ĪŻ

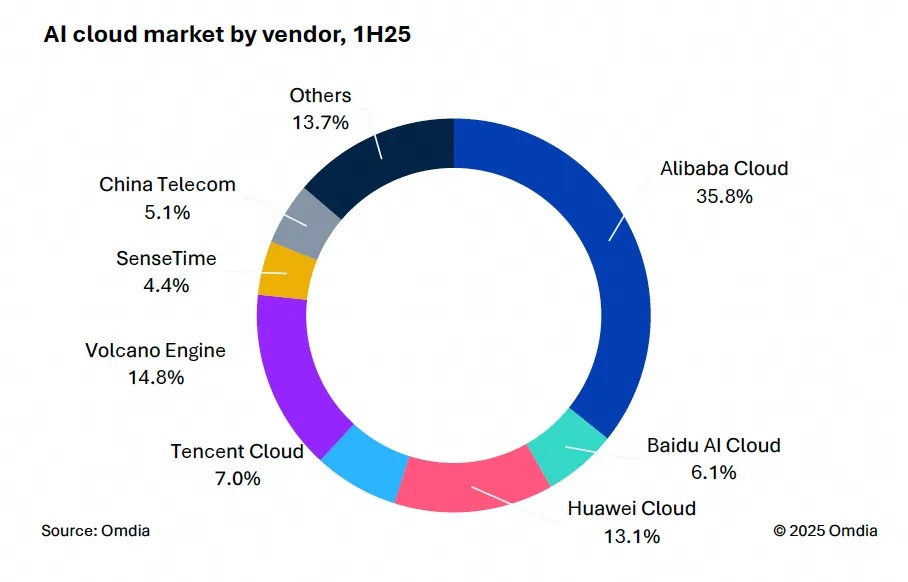

9į┬9╚šŻ¼ć°ļHÖÓ═■╩ął÷š{čąÖCśŗėóĖ╗┬³(Omdia)░l▓╝┴╦ĪČųąć°AIįŲ╩ął÷Ż¼1H25ĪĘł¾ĖµĪŻųąć°AIįŲ╩ął÷░ó└’įŲš╝▒╚8%╬╗┴ąĄ┌ę╗ĪŻ

9į┬24╚šŻ¼╚A×ķ└żņ`š┘ķ_Ī░ųŪ─▄¾w“ׯ¼ę╗Ų┴ĄĮ╬╗Ī▒╚A×ķIdeaHubŪ¦ąą░┘śI¾w“×╣┘ėŗäØ░l▓╝Ģ■ĪŻ

č┼±R╣■ū“╚šą¹▓╝═Ų│÷ā╔┐ŅŅ^┤„╩ĮČ·ÖCŻ¼Ęųäe╩ŪŲĮ░Õš±─żĄ─YH-4000║═äė╚”įŁ└ĒĄ─YH-C3000ĪŻ

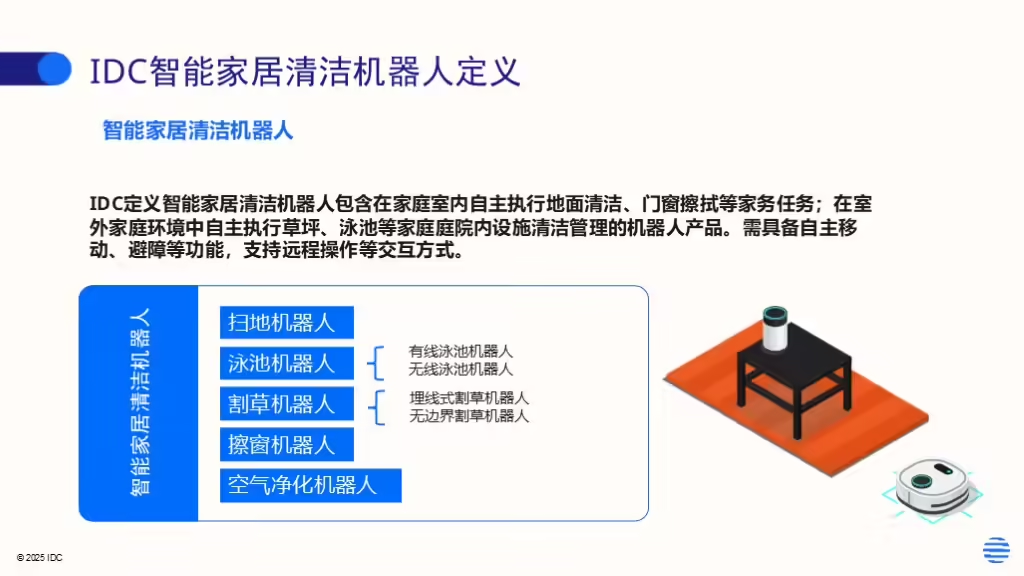

IDCĮ±╚š░l▓╝Ą─ĪČ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖCŲ„╚╦įOéõ╩ął÷╝ŠČ╚Ė·█Öł¾ĖµŻ¼2025─ĻĄ┌Č■╝ŠČ╚ĪĘ’@╩ŠŻ¼╔Ž░ļ─Ļ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖCŲ„╚╦╩ął÷│÷žø1,2╚f┼_Ż¼═¼▒╚į÷ķL33%Ż¼’@╩Š│÷ŲĘŅÉÅŖä┼Ą─╩ął÷ąĶŪ¾ĪŻ