ĪĪĪĪ╠ōöMĖĶ╩ųįĮüĒįĮ│÷╚”Ą─Į±╠ņŻ¼ūį╝║ķ_░l(f©Ī)ę╗éĆ(g©©) APP ║Ž│╔ĖĶ┬ĢęčĮø(j©®ng)▓╗╩Ū╩▓├┤ļy╩┬┴╦ĪŻ

ĪĪĪĪī”(du©¼)ė┌╠ōöMĖĶ╩ų┬Õ╠ņę└Ą─Ę█ĮzüĒšfŻ¼2022 ─Ļ 7 į┬ 12 ╚š╩Ūę╗éĆ(g©©)┤¾╚šūėĪŻ▀@ę╗╠ņŻ¼╦¹éāŠ█╝»į┌╩└ĮńĖ„ĄžĄ─Ų┴─╗Ū░Ż¼┼Ńūį╝║Ą─┼╝Ž±Č╚▀^┴╦šQ╔·╩«ų▄─Ļ╝o(j©¼)─Ņ╚šĪŻ▀@ł÷(ch©Żng)ÜvĢr(sh©¬) 3 éĆ(g©©)ČÓąĪĢr(sh©¬)Ą─ų▒▓źč▌│¬Ģ■(hu©¼)╚╦ÜŌų▒ŲŲŪ¦╚fĪŻ

ĪĪĪĪÜvĢr(sh©¬)╩«─ĻĮø(j©®ng)Š├▓╗╦źŻ¼▀@╩Ū║▄ČÓ╚╦ŅÉĖĶ╩ųČ╝║▄ļyū÷ĄĮĄ─╩┬ŪķŻ¼Ą½╠ōöM┼╝Ž±┬Õ╠ņę└ū÷ĄĮ┴╦ĪŻ┼c┤╦═¼Ģr(sh©¬)Ż¼║▄ČÓą┬╔·┤·╠ōöMĖĶ╩ųę▓į┌Ļæ└m(x©┤)│÷Ą└Ż¼š„Ę■ų°įĮüĒįĮČÓČ■┤╬į¬ęį═ŌĄ─╚╦ĪŻ

ĪĪĪĪ║▄ČÓĘ█Įz┴¶čįšfŻ¼¤ošōÅ─═Ōą╬▀Ć╩Ū┬Ģę¶üĒ┐┤Ż¼┬Õ╠ņę└Č╝įĮüĒįĮŠ½ų┬┴╦Ż¼ė╚Ųõ╩Ū┬Ģę¶įĮüĒįĮĮėĮ³šµ╚╦ĪŻ▀@ą®Ę█ĮzĄ─ĖąėXø]ėąÕe(cu©░)ĪŻ╠ōöMĖĶ╩ųĄ─Įø(j©®ng)Š├▓╗╦źŻ¼▒│║¾Ą─ų¦ō╬ŲõīŹ(sh©¬)╩Ū╝╝ąg(sh©┤)Ą─Ą³┤·Ż¼ė╚Ųõ╩ŪĖĶ┬Ģ║Ž│╔╝╝ąg(sh©┤)ĪŻ

ĪĪĪĪ╠ōöMĖĶ╩ų┼cĖĶ┬Ģ║Ž│╔

ĪĪĪĪÅ─╝╝ąg(sh©┤)╔ŽüĒšfŻ¼ĖĶ┬Ģ║Ž│╔╩ŪšZ(y©│)ę¶║Ž│╔Ą─ūėŅI(l©½ng)ė“ĪŻĄ½┼c│ŻęÄ(gu©®)Ą─šZ(y©│)ę¶║Ž│╔╚╬äš(w©┤)ŽÓ▒╚Ż¼ĖĶ┬Ģ║Ž│╔┤µį┌ę╗ą®¬Ü(d©▓)╠žų«╠Ä [1]Ż¼▒╚╚ńŻ║

ĪĪĪĪ▌ö╚ļ╠žš„▒╚▌^ČÓ(│²┴╦ę¶╦žĪó┬Ģš{(di©żo)ĪóĒŹ┬╔▀ģĮńĄ╚╬─▒Š╠žš„Ż¼▀Ćėąę¶Ę¹Īó╣Ø(ji©”)┼─Īó▀Bę¶Ę¹Ą╚śĘūVą┼Žó)Ż¼Č°Ūę▀@ą®Ņ~═ŌĄ─╠žš„ŽĪ╩Ķąį║▄┤¾;

ĪĪĪĪī”(du©¼)Ģr(sh©¬)ķL(zh©Żng)Ą─ī”(du©¼)²Rę¬Ū¾╠žäeć└(y©ón)Ė±Ż¼╣Ø(ji©”)┼─ę¬│¬£╩(zh©│n)Ż¼▒╚╚ń▓╗─▄īó╦─Ęųę¶Ę¹│¬│╔Č■Ęųę¶Ę¹;

ĪĪĪĪī”(du©¼)ę¶Ė▀ę¬Ū¾╠žäeć└(y©ón)Ė±Ż¼ą²┬╔ę¬│¬£╩(zh©│n)Ż¼▒╚╚ń▓╗─▄░čųąčļ C │¬│╔ųąčļ D;

ĪĪĪĪę¬ėąę╗Č©Ą─ūį╚╗Č╚║═ŪķĖąŻ¼╔µ╝░ęąę¶Īó╗¼ę¶Ą╚╝╝Ū╔Ż¼ę¶Ę¹ų«ķgĄ─╠°ūāę¬ėąę╗Č©Ą─ŠÅø_Ėą;

ĪĪĪĪī”(du©¼)▓╔śė┬╩Ą╚ę╗ą®šZ(y©│)궊Ä┤aī┘ąįėąę╗Č©Ą─ę¬Ū¾;

ĪĪĪĪĮ³Äū╩«─ĻüĒŻ¼╚╦éāę╗ų▒į┌┼¼┴”ĮŌøQ▀@ą®å¢Ņ}Ż¼ŲõķgĮø(j©®ng)Üv┴╦╗∙ė┌å╬į¬Ų┤ĮėĄ─║Ž│╔ĪóĮy(t©»ng)ėŗ(j©¼)ģóöĄ(sh©┤)║Ž│╔Īó╗∙ė┌╔ŅČ╚īW(xu©”)┴Ģ(x©¬)Ą─║Ž│╔Ą╚╝╝ąg(sh©┤)┬ĘŠĆĄ─Ą³┤·║═╚┌║ŽĪŻ

ĪĪĪĪŲ┤Įė║Ž│╔ųĖĄ─╩Ūį┌╩┬Ž╚õøųŲ║├Ą─▓╔śė┬ĢÄņ(k©┤)ųąīżšęī”(du©¼)æ¬(y©®ng)Ą─▓╔śė▓óūŅĮKŲ┤Įė│╔═Ļš¹ĖĶŪ·Ą─ĘĮĘ©ĪŻĮy(t©»ng)ėŗ(j©¼)ģóöĄ(sh©┤)║Ž│╔ät╩ŪŽ╚«a(ch©Żn)╔·ę╗ą®║Ž│╔ę¶Ņl▒žę¬Ą─┬ĢīW(xu©”)ģóöĄ(sh©┤)Ż¼╚╗║¾į┘└¹ė├▀@ą®ģóöĄ(sh©┤)║Ž│╔ę¶ŅlŻ¼ųąķgę¬ė├ĄĮ┬Ģ┤aŲ„ [2]ĪŻ

ĪĪĪĪ└¹ė├▀@ą®é„Įy(t©»ng)ĘĮĘ©Ż¼╚╦éā║▄įńŠ═ū÷│÷┴╦ę╗ą®▒╚▌^╩▄ÜgėŁĄ─▄ø╝■Ż¼▒╚╚ńč┼±R╣■ķ_░l(f©Ī)Ą─ VOCALOIDĪŻ╦³Ą─įńŲ┌║Ž│╔ĮY(ji©”)╣¹┐╔ęįį┌ę╗ą®┤¾╗Ą─╠ōöMĖĶ╩ųųą┬ĀĄĮŻ¼▒╚╚ń│§ę¶╬┤üĒĪŻ

ĪĪĪĪ╚╗Č°Ż¼āH┐┐▀@ą®é„Įy(t©»ng)Ą─ĘĮĘ©═©│Żļyęį╝Ü(x©¼)┴ŻČ╚Ąž┐╠«ŗ┬Ģ궥─ūā╗»(▒╚╚ńø]ėąōQÜŌ┬ĢĪó═┬ūų▓╗▀Bž×)Ż¼┼cšµīŹ(sh©¬)Ą─╚╦┬Ģ╚įėą▓ŅŠÓĪŻļSų°╔ŅČ╚īW(xu©”)┴Ģ(x©¬)Ą─┼dŲŻ¼╗∙ė┌╔ŅČ╚īW(xu©”)┴Ģ(x©¬)╗“╚┌║Ž┴╦╔ŅČ╚īW(xu©”)┴Ģ(x©¬)Ą─║Ž│╔╝╝ąg(sh©┤)ØuØu│╔╩ņŻ¼╔·│╔Ą─ĖĶ┬Ģ═∙═∙Ė³šµīŹ(sh©¬)ĪóĖ³╝Ü(x©¼)─ü [3]ĪŻėą╚╦╔§ų┴į┌ AI ║Ž│╔Ą─ĖĶŪ·Ž┬įu(p©¬ng)šōŻ║ĪĖAI ▒╚╬ęĖ³Ž±╚╦Ī╣ĪŻ

ĪĪĪĪłDį┤Ż║https://b23.tv/hDiGxuK

ĪĪĪĪ┐╔ęįė├ė┌ĖĶ┬Ģ║Ž│╔Ą─╔ŅČ╚īW(xu©”)┴Ģ(x©¬)─Żą═ėąįSČÓĘNŻ¼░³└©ŠĒĘe╔±Įø(j©®ng)ŠW(w©Żng)Įj(lu©░)ĪóŠ▀ėąķL(zh©Żng)Č╠Ų┌ėøæø(LSTM)Ą─裣h(hu©ón)╔±Įø(j©®ng)ŠW(w©Żng)Įj(lu©░)Īó╔·│╔ī”(du©¼)┐╣ŠW(w©Żng)Įj(lu©░)Ą╚ĪŻ┤╦═ŌŻ¼ę▓ėąčąŠ┐š▀└¹ė├ĖĶ┬Ģ║Ž│╔┼cšZ(y©│)ę¶║Ž│╔(TTS)Ą─ŽÓ╦ŲąįŻ¼╠ß│÷┴╦ę╗ą®ūį╗žÜw Seq2Seq ─Żą═ĪŻ

ĪĪĪĪ«ö(d©Īng)╚╗Ż¼«ö(d©Īng)Ū░ą¦╣¹Ė³║├Ą─ę╗ą®╔ŅČ╚īW(xu©”)┴Ģ(x©¬)╝▄śŗ(g©░u)(╚ń Transformer)ę▓▒╗ė├ĄĮ┴╦ĖĶ┬Ģ║Ž│╔ŅI(l©½ng)ė“Ż¼šQ╔·┴╦ XiaoiceSingĪóHifiSinger ║═öU(ku©░)╔ó╚źįļĖ┼┬╩─Żą═ DiffSinger Ą╚ĪŻ╚╗Č°Ż¼▀@ą®ą¦╣¹▌^║├Ą─╔ŅČ╚īW(xu©”)┴Ģ(x©¬)┤¾─Żą══©│ŻąĶꬎ¹║─║Ż┴┐Ą─öĄ(sh©┤)ō■(j©┤)║═╦Ń┴”Ż¼▓╗╩ŪŲš═©ķ_░l(f©Ī)š▀╗“ąĪą═äō(chu©żng)śI(y©©)╣½╦Š─▄═µĄ├▐D(zhu©Żn)Ą─ĪŻ

ĪĪĪĪ▓╗▀^Ż¼Ųš═©ķ_░l(f©Ī)š▀║═ąĪą═äō(chu©żng)śI(y©©)╣½╦Š┐╔ęį▓╗ė├ūį╝║äė(d©░ng)╩ųķ_░l(f©Ī)Ż¼ę“?y©żn)ķć?gu©«)ā╚(n©©i)ęčĮø(j©®ng)ėąę╗ą®ŲĮ┼_(t©ói)ķ_╩╝╠ß╣®ŽÓæ¬(y©®ng)Ą──▄┴”Ż¼▒╚╚ń─▄╠ß╣®Č╦ĪóįŲķ_Ę┼─▄┴”Ą─╚A×ķ HMS CoreĪŻķ_░l(f©Ī)š▀ų╗ąĶę¬║å(ji©Żn)å╬Ą─Äū▓ĮŻ¼Š═─▄īó▀@ĒŚ(xi©żng)─▄┴”▀\(y©┤n)ė├ĄĮūį╝║Ą─ APP ╔Ž(įöŪķęŖģó┐╝µ£Įė [5])ĪŻ

ĪĪĪĪ╚A×ķAudio Editor KitĖĶ┬Ģ║Ž│╔śėę¶00:0000:54╬┤╝ė╚ļ║Ž╝»

ĪĪĪĪ┐╔ęįė^▓ņĄĮŻ¼ūŅĮ³Äū─ĻŻ¼AI ĖĶ┬Ģ║Ž│╔▀@ę╗┘ÉĄ└š²ūāĄ├įĮüĒįĮ│÷╚”Ż¼ę▓ėąįĮüĒįĮČÓĄ─═Č┘Y╚╦ķ_╩╝┐┤ĄĮ▀@ę╗ŅI(l©½ng)ė“Ą─ār(ji©ż)ųĄĪŻ▒╚╚ń╚ź─ĻŻ¼ĮY(ji©”)║Ž AI ▀M(j©¼n)ąąĖĶ┬Ģ║Ž│╔Ą─ęŲäė(d©░ng)Č╦▄ø╝■ ACE ╠ōöMĖĶ╝¦Š═½@Ą├┴╦öĄ(sh©┤)░┘╚f├└į¬ Pre-A ▌å╚┌┘YĪŻ

ĪĪĪĪ×ķ╩▓├┤┤¾╝ęįĖęŌ╗©▀@├┤┤¾Š½┴”╚ź═Č┘YĪó┤“─źĖĶ┬Ģ║Ž│╔?į┌═Č┘Y╚╦┐┤üĒŻ¼║═ėą╔ŅČ╚īW(xu©”)┴Ģ(x©¬)╝ė│ųĄ─ęĢŅl╝¶▌ŗ▄ø╝■ę╗śėŻ¼▀@╩Ūę╗ĘNė├╦Ń┴”üĒĮŌĘ┼äō(chu©żng)įņ┴”Ą─ĘĮ╩ĮĪŻę¶śĘū„×ķūŅŲš╩└Ą─Ŗ╩śĘā╚(n©©i)╚▌Ż¼Ą½äō(chu©żng)ū„▀Ć╝»ųąį┌śO╔┘öĄ(sh©┤)╚╦╩ų╔ŽŻ¼äō(chu©żng)ū„Ą─ķTÖæžĮ┤²ĮĄĄ═ [6]ĪŻ

ĪĪĪĪ┴Ē═ŌŻ¼į┌┤·▒Ēų°╬┤üĒĄ─ĪĖį¬ėŅųµĪ╣ųąŻ¼╚ń╣¹╬ęéāŽļūī╠ōöM╚╦Īó╠ōöMč▌│¬Ģ■(hu©¼)Įo╚╦Ė³šµīŹ(sh©¬)ĪóĖ³│┴Į■Ą─¾w“×(y©żn)Ż¼ĖĶ┬Ģ║Ž│╔ę▓╩Ū▒žĒÜę¬▀^Ą─ę╗ĻP(gu©Īn)ĪŻ

ĪĪĪĪ«ö(d©Īng)╚╗Ż¼╚ń╣¹╬ęéāŽļį┌į¬ėŅųµųą┤“įņĖ³╝ė│┴Į■Ą─╠ōöMč▌│¬Ģ■(hu©¼)Ż¼āH░l(f©Ī)┴”┤“─źĖĶ┬Ģ║Ž│╔╩Ū▓╗ē“Ą─Ż¼Ųõ╦¹╝╝ąg(sh©┤)Ż¼▒╚╚ńę¶į┤ĘųļxĪó┐šķgę¶Ņlõų╚ŠĄ╚ę▓║▄ųžę¬ĪŻ

ĪĪĪĪ╚ń║╬▐kę╗ł÷(ch©Żng)Ė╗ėąĪĖ┐šķgĖąĪ╣Ą─╠ōöMč▌│¬Ģ■(hu©¼)?

ĪĪĪĪ╚╦ŅÉĄ─ā╔ų╗Č·Čõ┐╔ęįĘų▒µ┬Ģį┤Ą─╬╗ų├Ż¼ę“?y©żn)ķÅ─┬Ģį┤é„▀fĄĮā╔ų╗Č·ČõĄ─┬Ģę¶┤µį┌╝Ü(x©¼)╬óĄ─▓Ņ«ÉŻ¼░³└©ĄĮ▀_(d©ó)Ģr(sh©¬)ķgĪóĮė╩šĄĮĄ──▄┴┐ęį╝░ŽÓ╬╗▓ŅĄ╚ą┼ŽóŻ¼▀@Š═Įo╚╦ĦüĒ┴╦┐šķgĖąĪŻ×ķ┴╦▀ĆįŁ▀@ĘNĖąėXŻ¼┐šķgę¶Ņl╝╝ąg(sh©┤)╩╣ė├ą┼╠¢(h©żo)╠Ä└ĒĄ─ĘĮĘ©ī”(du©¼)ĄĮ▀_(d©ó)ā╔Č·Ą─┬Ģ궹┼╠¢(h©żo)▀M(j©¼n)ąą─ŻöMŻ¼īó┬Ģł÷(ch©Żng)▀ĆįŁ×ķ╚²ŠS┐šķgŻ¼Ė³ĮėĮ³šµīŹ(sh©¬)╩└ĮńĪŻ

ĪĪĪĪ└ĒŽļĄ─┐šķgę¶Ņlą¦╣¹ī”(du©¼)╠ōöMč▌│¬Ģ■(hu©¼)Ą─│┴Į■ĖąĘŪ│Żųžę¬ĪŻ╬ęéā┐╔ęįŽļŽ¾ę╗Ž┬┤„ų° VR Ņ^’@ą└┘pÓć¹ÉŠ²╠ōöMč▌│¬Ģ■(hu©¼)Ą─ŪķŠ░Ż¼¼F(xi©żn)ł÷(ch©Żng)▓╗ų╣ėąÓć¹ÉŠ²Ą─ĖĶ┬ĢŻ¼▀ĆėąõōŪ┘Ą╚śĘŲ„Ą─┬Ģ궯¼▀@ą®┬Ģę¶Įo╬ęéāĄ─ĖąėX▓╗æ¬(y©®ng)įō╩ŪÅ─╬ęéāĄ─Č·ÖC(j©®)ųą░l(f©Ī)│÷Ą─Ż¼Č°╩Ū╬ęéāų▄ć·Ą─ę╗Ų¼ģ^(q©▒)ė“Ż¼śĘŲ„éāę▓Ė„ėąŲõ╬╗ų├ĪŻ

ĪĪĪĪę╗ą®é„Įy(t©»ng)Ą─ 3D ę¶ŅlųŲū„╝╝ąg(sh©┤)┐╔ęį▀_(d©ó)ĄĮ╗“ĮėĮ³▀@ĘNą¦╣¹Ż¼Ą½ųŲū„▀^│╠▒╚▌^Ę▒¼ŹŻ¼ąĶę¬½@╚ĪįŁ╩╝Ą─Ęų▄ē╦ž▓─(╚ńõøųŲĄ─╚╦┬ĢĪóõōŪ┘┬ĢĄ╚)Ż¼▓ó╩╣ė├īŻśI(y©©)Ą─öĄ(sh©┤)ūųę¶Ņl╣żū„šŠ(DAW)║═ 3D ╗ņę¶▓Õ╝■╩ų╣żųŲū„Ż¼ę“┤╦ųŲū„ų▄Ų┌ķL(zh©Żng)Īó╔·«a(ch©Żn)ą¦┬╩Ą═Īó│╔▒ŠĖ▀ĪóķTÖæĖ▀ĪŻ┤╦═ŌŻ¼ķ_░l(f©Ī)š▀ė╔ė┌ø]ėąĖĶŪ·Ą─įŁ╩╝Ęų▄ēŻ¼ę“┤╦═©▀^é„Įy(t©»ng)ĘĮĘ©īó 2D ę¶Ņl▐D(zhu©Żn)│╔ 3D ļyČ╚ę▓║▄┤¾ĪŻ

ĪĪĪĪ╔ŅČ╚īW(xu©”)┴Ģ(x©¬)═¼śė┐╔ęįį┌▀@ę╗å¢Ņ}ųą░l(f©Ī)ō]ū„ė├ĪŻ

ĪĪĪĪ═©▀^ī”(du©¼)┤¾┴┐Ą─궜Ę▀M(j©¼n)ąą╔ŅČ╚īW(xu©”)┴Ģ(x©¬)Į©─ŻŻ¼▓óĮY(ji©”)║Žé„Įy(t©»ng)ą┼╠¢(h©żo)╠Ä└Ē─▄┴”Ż¼╬ęéā┐╔ęįīŹ(sh©¬)¼F(xi©żn)ę¶į┤ĘųļxĪŻ▓╗▀^Ż¼×ķ┴╦┤_▒Ż├┐ę╗éĆ(g©©)śĘŲ„Č╝─▄▒M┐╔─▄ĄžĘųļx═Ļš¹ŪęĖ╔ā¶Ż¼╬ęéā┐╔─▄▀ĆąĶę¬ßśī”(du©¼)▓╗═¼Ą─śĘŲ„ę¶╔½╠ž³c(di©Żn)īŻķTįO(sh©©)ėŗ(j©¼)▀^│╠ųąę¬ė├ĄĮĄ─ūāōQŠžĻć║═ŠW(w©Żng)Įj(lu©░)ĮY(ji©”)śŗ(g©░u)Ż¼▀@Š═ėąę╗Č©Ą─╝╝ąg(sh©┤)ķTÖæ┴╦ĪŻ

ĪĪĪĪĘųļxų«║¾Ą─┐šķgę¶Ņlõų╚Šę▓┤µį┌ę╗ą®ļyŅ}Ż¼▒╚╚ńę¬ĮŌøQę“Ņ^ą═Īó╝ńīÆĄ╚╚╦¾w¾wš„Ą─▓Ņ«ÉĦüĒĄ─ HRTF(Ņ^ŽÓĻP(gu©Īn)é„▀f║»öĄ(sh©┤))ę“╚╦Č°«ÉĄ─ļyŅ}Ż¼▀Ćę¬ĀI(y©¬ng)įņ┐šķgųą┬Ģ궥─Ę┤╔õĪó╔ó╔õĪóĖ╔╔µĄ╚╬’└Ē¼F(xi©żn)Ž¾ĪŻ

ĪĪĪĪ▓╗▀^Ż¼▀@ą®å¢Ņ}ę▓ęčĮø(j©®ng)ėą┴╦¼F(xi©żn)│╔Ą─ĮŌøQĘĮ░ĖŻ¼Č°Ūęį┌╔Ž├µ╠ߥĮĄ─╚A×ķ HMS Core ę¶ŅlŠÄ▌ŗĘ■äš(w©┤)(Audio Editor Kit)ųąČ╝─▄šęĄĮŻ¼Ųõ¬Ü(d©▓)ėąĄ─ūāōQŠžĻćĪóŠW(w©Żng)Įj(lu©░)ĮY(ji©”)śŗ(g©░u)║═ę╗ŽĄ┴ąĄ─┬Ģį┤×V▓©╝╝ąg(sh©┤)Č╝ęčĮø(j©®ng)Ž“ķ_░l(f©Ī)š▀ķ_Ę┼ĪŻķ_░l(f©Ī)š▀āHąĶ▌ö╚ļ┴ó¾w┬ĢŻ¼Š═─▄┐ņ╦┘╔·│╔ 3D ę¶Ņlā╚(n©©i)╚▌(įöŪķęŖģó┐╝µ£Įė [7])ĪŻ

ĪĪĪĪHMS Coreę¶ŅlŠÄ▌ŗĘ■äš(w©┤)3Dę¶Ņl╔·│╔╩ŠęŌłD

ĪĪĪĪŲš═©ķ_░l(f©Ī)š▀╚ń║╬╚ļŠų?

ĪĪĪĪį┌ AI ╦∙ų¦│ųĄ─Ė„ĘN«a(ch©Żn)śI(y©©)ųąŻ¼ę¶ŅlŠÄ▌ŗ╩Ū▒╗Ą═╣└Ą─ę╗éĆ(g©©)Ż¼ė╚Ųõ╩Ūį┌«ö(d©Īng)Ū░╠ōöM╚╦«a(ch©Żn)ŲĘŠ«ćŖĪóį¬ėŅųµ▒╗╝─ėĶ║±═¹Ą─▒│Š░Ž┬ĪŻ

ĪĪĪĪiMedia Research(░¼├Įū╔įā)š{(di©żo)čąöĄ(sh©┤)ō■(j©┤)’@╩ŠŻ¼ĮėĮ³Ų▀│╔ė├涎▓Üg╠ōöM╚╦ą╬Ž¾Ą─═Ōą╬ / ┬Ģ궯¼Ųõ┤╬Ž▓Üg╠ōöM╚╦Ą─ū„ŲĘ [8]ĪŻ╦¹éāĄ─öĄ(sh©┤)ō■(j©┤)▀Ć’@╩ŠŻ¼2020 ─Ļųąć°(gu©«)╠ōöM┼╝Ž±║╦ą─╩ął÷(ch©Żng)ęÄ(gu©®)─Ż×ķ 34.6 ā|į¬Ż¼ŅA(y©┤)ėŗ(j©¼) 2022 ─Ļīó▀_(d©ó)ĄĮ 120.8 ā|į¬;2020 ─Ļ╠ōöM┼╝Ž±Ä¦äė(d©░ng)ų▄▀ģ╩ął÷(ch©Żng)ęÄ(gu©®)─Ż×ķ 645.6 ā|į¬Ż¼ŅA(y©┤)ėŗ(j©¼) 2022 ─Ļ×ķ 1866.1 ā|į¬Ż¼ŲŲ╚”ą¦æ¬(y©®ng)Øu’@ [9]ĪŻ▀@śėĄ─╩ął÷(ch©Żng)ęÄ(gu©®)─Żī”(du©¼)ė┌«a(ch©Żn)ŲĘķ_░l(f©Ī)Ą─ąĶŪ¾▓╗čįČ°ė„ĪŻ

ĪĪĪĪ╚ń╣¹─Ńę▓Žļūį╝║śŗ(g©░u)Į©ę╗éĆ(g©©)ĪĖAI + ę¶ŅlŠÄ▌ŗĪ╣APPŻ¼╗“š▀į┌ūį╝║Ą─ APP ųą╝ė╚ļĖĶ┬Ģ║Ž│╔Īó3D ę¶ŅlĄ╚╣”─▄Ż¼Įė╚ļ╚A×ķ HMS Core Ą╚ķ_Ę┼─▄┴”ŲĮ┼_(t©ói)▓╗╩¦×ķę╗éĆ(g©©)▒ŃĮ▌Ą─▀xō±Ż¼ę“?y©żn)ķ▀@éĆ(g©©)ŲĮ┼_(t©ói)▓╗āH╠ß╣®┴╦¼F(xi©żn)│╔Ą─╝╝ąg(sh©┤)─▄┴”Ż¼▀ĆėąŽÓæ¬(y©®ng)Ą─╝╝ąg(sh©┤)╬─ÖnĪóĮŌøQĘĮ░Ė╩Š└²Īó╝╝ąg(sh©┤)ĮŌūxšn│╠Īó╗źäė(d©░ng)╔ńģ^(q©▒)Ą╚ū„×ķ▌oų·ĪŻ

ĪĪĪĪ╣┘ĘĮūŅĮ³Ą─ę╗┤╬╝╝ąg(sh©┤)ĮŌūx(HMS Core Discovery ų▒▓źĄ┌ 17 Ų┌)▒Ń╩ŪŠ█Į╣ HMS Core ę¶ŅlŠÄ▌ŗĘ■äš(w©┤)Ż¼š╣╩ŠĖĶ┬Ģ║Ž│╔Īó┐šķgę¶Ņlõų╚ŠĪóę¶į┤ĘųļxĄ╚─▄┴”Ą─ą┬═µĘ©Ż¼Ė³ėąų¬├¹Ą─ÅŚ│¬ę¶śĘ╔ńģ^(q©▒)│¬°å App ╝ė├╦Ż¼ę╗Ų╠Įėæė░ę¶Ŗ╩śĘæ¬(y©®ng)ė├╚ń║╬śŗ(g©░u)ų■▓Ņ«É╗»Ėé(j©¼ng)ĀÄ(zh©źng)┴”Īó┤“įņĪĖ┬ĢĪ╣┼RŲõŠ│Ą─┬ĀėX╩óčńĪŻĖą┼d╚żĄ─ķ_░l(f©Ī)š▀┐╔ęįÆ▀┤aŻ¼ĻP(gu©Īn)ūó├„═Ē 7 ³c(di©Żn)Ą─ų▒▓źķgĪŻ

ĪĪĪĪ╬─š┬ā╚(n©©i)╚▌āH╣®ķåūxŻ¼▓╗śŗ(g©░u)│╔═Č┘YĮ©ūhŻ¼šł(q©½ng)ųö(j©½n)╔„ī”(du©¼)┤²ĪŻ═Č┘Yš▀ō■(j©┤)┤╦▓┘ū„Ż¼’L(f©źng)ļU(xi©Żn)ūįō·(d©Īn)ĪŻ

║Żł¾(b©żo)╔·│╔ųą...

║Ż╦ćAIĄ──Żą═ŽĄĮy(t©»ng)į┌ć°(gu©«)ļH╩ął÷(ch©Żng)╔ŽÅV╩▄║├įu(p©¬ng)Ż¼─┐Ū░šŠā╚(n©©i)└█ėŗ(j©¼)─Żą═öĄ(sh©┤)│¼▀^80╚féĆ(g©©)Ż¼║Ł╔wīæīŹ(sh©¬)ĪóČ■┤╬į¬Īó▓Õ«ŗĪóįO(sh©©)ėŗ(j©¼)Īóözė░Īó’L(f©źng)Ė±╗»łDŽ±Ą╚ČÓŅÉą═æ¬(y©®ng)ė├ł÷(ch©Żng)Š░Ż¼╗∙▒ŠĖ▓╔w╦∙ėąų„┴„äō(chu©żng)ū„’L(f©źng)Ė±ĪŻ

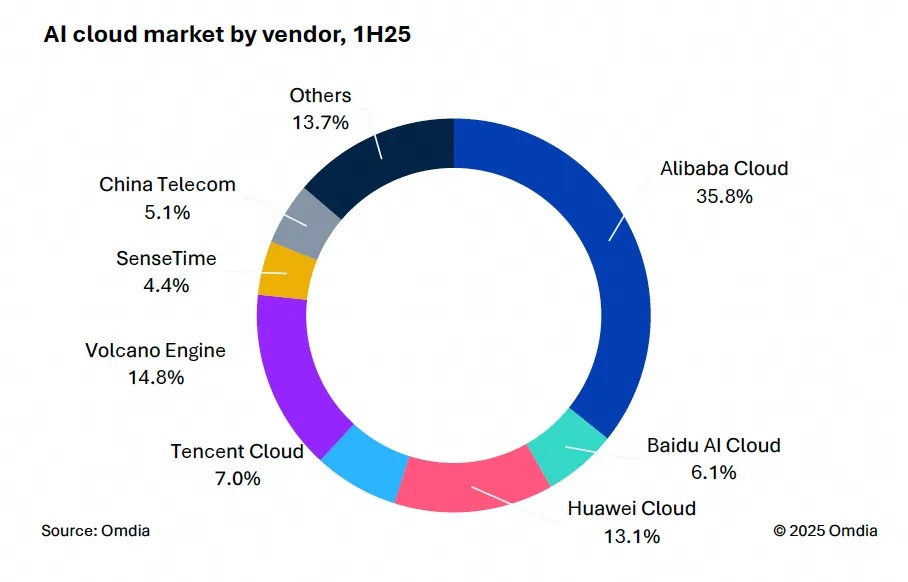

9į┬9╚šŻ¼ć°(gu©«)ļHÖÓ(qu©ón)═■╩ął÷(ch©Żng)š{(di©żo)čąÖC(j©®)śŗ(g©░u)ėóĖ╗┬³(Omdia)░l(f©Ī)▓╝┴╦ĪČųąć°(gu©«)AIįŲ╩ął÷(ch©Żng)Ż¼1H25ĪĘł¾(b©żo)ĖµĪŻųąć°(gu©«)AIįŲ╩ął÷(ch©Żng)░ó└’įŲš╝▒╚8%╬╗┴ąĄ┌ę╗ĪŻ

9į┬24╚šŻ¼╚A×ķ└żņ`š┘ķ_Ī░ųŪ─▄¾w“×(y©żn)Ż¼ę╗Ų┴ĄĮ╬╗Ī▒╚A×ķIdeaHubŪ¦ąą░┘śI(y©©)¾w“×(y©żn)╣┘ėŗ(j©¼)äØ░l(f©Ī)▓╝Ģ■(hu©¼)ĪŻ

č┼±R╣■ū“╚šą¹▓╝═Ų│÷ā╔┐ŅŅ^┤„╩ĮČ·ÖC(j©®)Ż¼Ęųäe╩ŪŲĮ░Õš±─żĄ─YH-4000║═äė(d©░ng)╚”įŁ└ĒĄ─YH-C3000ĪŻ

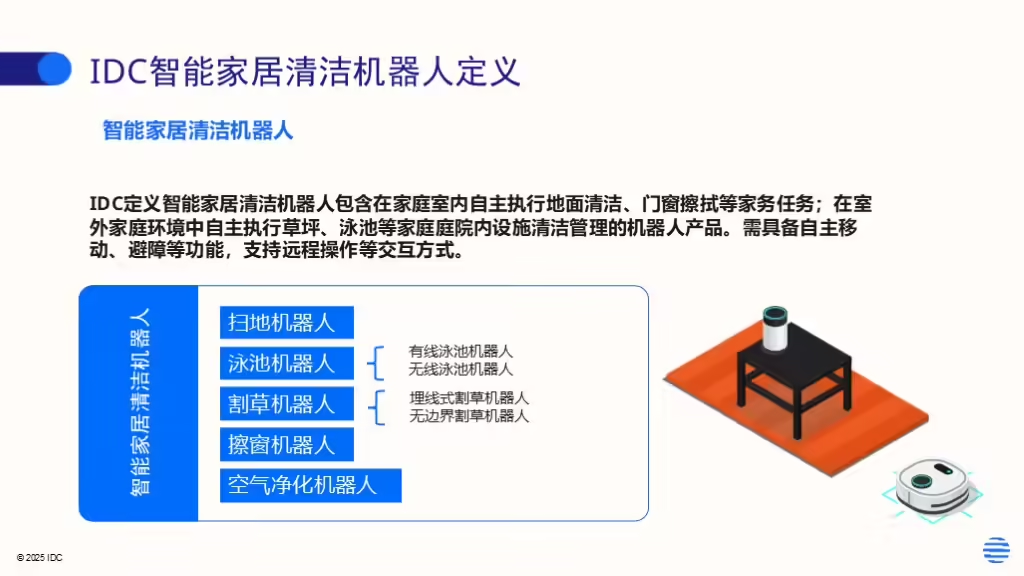

IDCĮ±╚š░l(f©Ī)▓╝Ą─ĪČ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖC(j©®)Ų„╚╦įO(sh©©)éõ╩ął÷(ch©Żng)╝ŠČ╚Ė·█Öł¾(b©żo)ĖµŻ¼2025─ĻĄ┌Č■╝ŠČ╚ĪĘ’@╩ŠŻ¼╔Ž░ļ─Ļ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖC(j©®)Ų„╚╦╩ął÷(ch©Żng)│÷žø1,2╚f┼_(t©ói)Ż¼═¼▒╚į÷ķL(zh©Żng)33%Ż¼’@╩Š│÷ŲĘŅÉÅŖ(qi©óng)ä┼Ą─╩ął÷(ch©Żng)ąĶŪ¾ĪŻ