ĪĪĪĪ┤╦┐╠Ż¼─Ńæ¬(y©®ng)įō╩Ūį┌ļŖ─X╗“╩ųÖC╔Ž┐┤▀@Ų¬╬─š┬ĪŻ▓╗╣▄į§śėŻ¼▀@ą®ÖCŲ„Č╝ī┘ė┌¼F(xi©żn)┤·ėŗ╦ŃÖCŻ¼╦³éāČ╝ėąųąčļ╠Ä└ĒŲ„(CPU)║═Ųõ╦¹×ķ╠žČ©╣”─▄Ę■äš(w©┤)Ą─īŻė├ąŠŲ¼Ż¼└²╚ń’@┐©Īó┬Ģ┐©ĪóŠW(w©Żng)┐©Īóé„ĖąŲ„╚┌║ŽĄ╚ĪŻ╠Ä└Ē╠žČ©╚╬äš(w©┤)ĢrŻ¼īŻė├╠Ä└ĒŲ„═∙═∙▒╚═©ė├ CPU Ė³┐ņĖ³Ė▀ą¦ĪŻ

ĪĪĪĪėŗ╦ŃÖC░l(f©Ī)š╣įńŲ┌Ż¼CPU Č╝Ģ■║═īŻė├╠Ä└ĒŲ„┼õ║Ž╩╣ė├ĪŻ1970 ─Ļ┤·Ą─ 8 ╬╗║═ 16 ╬╗ CPU ąĶę¬ę└┘ć▄ø╝■üĒ─ŻöMĖĪ³cųĖ┴ŅŻ¼ę“┤╦ł╠(zh©¬)ąąĖĪ³c▀\╦ŃĘŪ│Ż┬²ĪŻČ°ė╔ė┌ėŗ╦ŃÖC▌oų·įO(sh©©)ėŗ(CAD)║═╣ż│╠─ŻöMĄ╚æ¬(y©®ng)ė├ī”ĖĪ³c▀\╦ŃĄ─╦┘Č╚ę¬Ū¾▌^Ė▀Ż¼ė┌╩Ū╚╦éāķ_╩╝ė├öĄ(sh©┤)īW(xu©”)ģf(xi©”)╠Ä└ĒŲ„(math coprocessor)▌oų· CPUŻ¼ūīöĄ(sh©┤)īW(xu©”)ģf(xi©”)╠Ä└ĒŲ„Ęųō·╦∙ėąĖĪ³c▀\╦Ń╚╬äš(w©┤)Ż¼╦³Ą─ĖĪ³c▀\╦Ń╦┘Č╚║═ą¦┬╩Č╝▒╚ CPU Ė³Ė▀ĪŻ▀@Š═╩ŪīŻė├╠Ä└ĒŲ„Ą─ę╗éĆ└²ūėĪŻ

ĪĪĪĪĻP(gu©Īn)ūó AI ║═░ļī¦(d©Żo)¾wąąśI(y©©)Ą─┼¾ėčĮ³üĒ┐╔─▄┬Āšf▀^ “ÖCŲ„īW(xu©”)┴Ģ(x©¬)(ML)īŻė├╠Ä└ĒŲ„”(╝┤ AI ╝ė╦┘Ų„)ĪŻūŅ│ŻęŖĄ─ AI ╝ė╦┘Ų„─¬▀^ė┌ NVIDIA GPUŻ¼┤╦═Ō▀Ćėą Intel Ą─ Habana Gaudi ╠Ä└ĒŲ„ĪóGraphcore Ą─ Bow IPUĪóGoogle Ą─ TPUĪóAWS Ą─ Trainium ║═ Inferentia ąŠŲ¼Ą╚ĪŻ

ĪĪĪĪ×ķ╩▓├┤╚ńĮ±ėą▀@├┤ČÓ AI ╝ė╦┘Ų„┐╔╣®▀xō±?╦³éā║═ CPU ėą╩▓├┤▓╗═¼?╦ŃĘ©╚ń║╬Ė─ūā▓┼─▄▀mæ¬(y©®ng)▀@ą®ė▓╝■?ė▓╝■ėųįō╚ń║╬░l(f©Ī)š╣▓┼─▄ų¦│ųūŅą┬Ą─╦ŃĘ©? ▒Š╬─īóę╗ę╗ĮŌ┤ĪŻ▒Š╬─ų„ę¬ā╚(n©©i)╚▌░³└©Ż║

ĪĪĪĪ×ķ╩▓├┤ąĶę¬īŻė├ AI ╝ė╦┘Ų„?

ĪĪĪĪML ė▓╝■Ą─ĘųŅÉŻ║CPUĪóGPUĪóAI ╝ė╦┘Ų„ĪóFPGA ║═ ASIC

ĪĪĪĪ“ė▓╝■Ėąų¬(Hardware-aware)” Ą─╦ŃĘ©║═ “╦ŃĘ©Ėąų¬(Algorithms-aware)” Ą─ė▓╝■

ĪĪĪĪAI ╝ė╦┘Ų„┼cĖ▀ą¦ ML ╦ŃĘ©Ą─ģf(xi©”)═¼▀M╗»

ĪĪĪĪßśī”═Ų└ĒĄ─ AI ╝ė╦┘Ų„┼cĖ▀ą¦╦ŃĘ©

ĪĪĪĪßśī”ė¢(x©┤n)ŠÜĄ─ AI ╝ė╦┘Ų„┼cĖ▀ą¦╦ŃĘ©

ĪĪĪĪAI ╝ė╦┘Ų„Ą─╬┤üĒ

ĪĪĪĪ1

ĪĪĪĪ×ķ╩▓├┤ąĶę¬īŻė├ AI ╝ė╦┘Ų„?

ĪĪĪĪśŗ(g©░u)Į© ML īŻė├╠Ä└ĒŲ„ėą╚²éĆĘĮ├µĄ─įŁę“Ż║─▄ą¦Īóąį─▄Īó─Żą═┤¾ąĪ╝░Å═(f©┤)ļsČ╚ĪŻĮ³üĒŻ¼ę¬╠ßĖ▀─Żą═£╩┤_┬╩Ż¼═©│Żū÷Ę©╩ŪöU┤¾─Żą═ģóöĄ(sh©┤)┴┐Ż¼▓óė├Ė³┤¾ą═Ą─öĄ(sh©┤)ō■(j©┤)╝»ė¢(x©┤n)ŠÜ─Żą═ĪŻėŗ╦ŃÖCęĢėXĪóūį╚╗šZčį╠Ä└Ē║══Ų╦]ŽĄĮy(t©»ng)Č╝▓╔ė├▀@ĘNū÷Ę©ĪŻ

ĪĪĪĪšZčį─Żą═ĘĮ├µŻ¼Ū░Äū─ĻšQ╔·Ą─ GPT-3 ėą 1750 ā|ģóöĄ(sh©┤)Ż¼«öĢr▒╗ęĢ×ķ┤¾─Żą═Ą─ “╠ņ╗©░Õ”Ż¼Ą½║¾üĒėų│÷¼F(xi©żn)┴╦ GLaM ║═ NVIDIA MT-NLGŻ¼ģóöĄ(sh©┤)┴┐Ęųäe▀_ĄĮ 1.2 ╚fā|║═ 5300 ā|ĪŻ░┤ššÜv╩ĘęÄ(gu©®)┬╔Ż¼─Żą═īóįĮüĒįĮ┤¾Ż¼Č°¼F(xi©żn)ėą╠Ä└ĒŲ„Ą─╦Ń┴”īó¤oĘ©ØMūŃ┤¾─Żą═į┌ė¢(x©┤n)ŠÜĢrķg║══Ų└Ēčė▀tĘĮ├µĄ─ę¬Ū¾ĪŻ

ĪĪĪĪ▓╗▀^Ż¼śŗ(g©░u)Į© AI īŻė├╝ė╦┘Ų„Ą─ūŅųžę¬įŁę“▀Ć╩Ū─▄ą¦Ż¼ķ_░l(f©Ī) AI īŻė├ąŠŲ¼┐╔╣Ø(ji©”)╩ĪŠ▐┤¾Ą──▄į┤Ż¼┐╔Ė▓╔wčą░l(f©Ī)═Č╚ļėąėÓĪŻ

ĪĪĪĪ×ķ╩▓├┤ąĶę¬Ė▀─▄ą¦Ą─╠Ä└ĒŲ„?

ĪĪĪĪML ─Żą═įĮ┤¾Ż¼ąĶꬳ╠(zh©¬)ąąĄ─ā╚(n©©i)┤µįLå¢▓┘ū„Š═įĮČÓĪŻ┼cā╚(n©©i)┤µįL墎Ó▒╚Ż¼ŠžĻć - ŠžĻć▀\╦Ń║═ŠžĻć - Ž“┴┐▀\╦ŃĄ──▄ą¦Ė▀║▄ČÓĪŻĖ∙ō■(j©┤)╦╣╠╣ĖŻ┤¾īW(xu©”)Ēn╦╔▓®╩┐Ą─šō╬─ (https://arxiv.org/pdf/1506.02626v3.pdf)Ż¼ūx╚Īā╚(n©©i)┤µĄ──▄║─▒╚╝ė / │╦▀\╦Ń▓┘ū„Ą──▄║─Ė▀│÷║├ÄūéĆöĄ(sh©┤)┴┐╝ēĪŻ┤¾ą═╔±Įø(j©®ng)ŠW(w©Żng)Įj(lu©░)ė╔ė┌¤oĘ©Ų¼╔Ž┤µā”Ż¼ąĶꬳ╠(zh©¬)ąąĖ³ČÓ DRAM ūx╚Ī▓┘ū„Ż¼ę“┤╦─▄║─▀Ćę¬Ė³Ė▀ĪŻ

ĪĪĪĪłDį┤Ż║https://arxiv.org/pdf/1506.02626v3.pdf

ĪĪĪĪė├═©ė├╠Ä└ĒŲ„▀\ąą╔ŅČ╚╔±Įø(j©®ng)ŠW(w©Żng)Įj(lu©░)ĢrŻ¼öU┤¾╠Ä└ĒŲ„ęÄ(gu©®)─Ż┐╔ęįĦüĒąį─▄╠ß╔²Ż¼Ą½╝┤▒Ńų╗╩ŪąĪĘ∙╠ß╔²ę▓ĒÜęį┤¾┴┐─▄║─║═Š▐Ņ~įO(sh©©)éõ│╔▒Š×ķ┤·ārĪŻ

ĪĪĪĪCPU Ą╚═©ė├╠Ä└ĒŲ„Ā▐╔³Ą═─▄║─ōQ╚Ī═©ė├ąįŻ¼AI ╝ė╦┘Ų„Ą╚īŻė├╠Ä└ĒŲ„ätĀ▐╔³═©ė├ąįōQ╚ĪĄ═─▄║─ĪŻ

ĪĪĪĪ╩╣ė├ AI ╝ė╦┘Ų„ät▓╗ę╗śėĪŻAI ╝ė╦┘Ų„═©▀^Ė─▀MįO(sh©©)ėŗŻ¼┐╔ęį£p╔┘ā╚(n©©i)┤µįLå¢Ż¼╠ß╣®Ė³┤¾Ą─Ų¼╔ŽŠÅ┤µŻ¼▀Ć┐╔ęįŠ▀éõ╠žČ©Ą─ė▓╝■╣”─▄(╚ń╝ė╦┘ŠžĻć - ŠžĻćėŗ╦Ń)ĪŻė╔ė┌ AI ╝ė╦┘Ų„╩Ū╗∙ė┌╠žČ©Č°śŗ(g©░u)Į©Ą─įO(sh©©)éõŻ¼┐╔Ė∙ō■(j©┤)╦ŃĘ©▀Mąą▀m┼õĖ─▀MŻ¼ę“┤╦Ųõ▀\ąąą¦┬╩Ģ■▒╚═©ė├╠Ä└ĒŲ„Ė³Ė▀ĪŻ

ĪĪĪĪ2

ĪĪĪĪML ė▓╝■Ą─ĘųŅÉ ——CPUĪóGPUĪóAI ╝ė╦┘Ų„ĪóFPGA ║═ ASIC

ĪĪĪĪĮėŽ┬üĒ╬ęéāšä?w©┤)ä╝ė╦┘Ų„Ą─▓╗═¼ĘNŅÉŻ¼ęį╝░╦³éāĄ─═©ė├║═īŻė├│╠Č╚ĪŻ

ĪĪĪĪ╚ń╔ŽłD╦∙╩ŠŻ¼ūŅŠ▀═©ė├ąįĄ─╩Ū CPUŻ¼┐╔ęį▀\ąą╚╬ęŌ┤·┤aĪŻīŻė├ąŠŲ¼┐╔ł╠(zh©¬)ąąĄ─╚╬äš(w©┤)Ż¼CPU ę▓─▄ł╠(zh©¬)ąąŻ¼╚ńłDŽ±╠Ä└ĒĪóšZę¶╠Ä└ĒĪóÖCŲ„īW(xu©”)┴Ģ(x©¬)Ą╚ĪŻ╚╗Č°Ż¼CPU Ą─ąį─▄║═─▄ą¦Č╝▒╚▌^Ą═ĪŻ

ĪĪĪĪīŻė├ąįūŅÅŖĄ─╩ŪīŻė├╝»│╔ļŖ┬Ę(ASIC)Ż¼ėųĘQ╣╠Č©╣”─▄ąŠŲ¼Ż¼ę“×ķ╦³ų╗─▄ł╠(zh©¬)ąąę╗ĘN╗“ÄūĘN╚╬äš(w©┤)Ż¼Č°Ūę═©│Ż▓╗┐╔ŠÄ│╠Ż¼ę▓ø]ėą├µŽ“ķ_░l(f©Ī)š▀Ą─ APIĪŻČ·ÖCųąĄ─ĮĄįļ╠Ä└ĒŲ„Š═╩Ūę╗ĘN ASIC ąŠŲ¼Ż¼╦³ąĶę¬═¼ĢrŠ▀éõĄ═─▄║─║═Ė▀ąį─▄Ż¼▀@śė▓┼─▄╝╚čėķLČ·ÖCļŖ│ž╩╣ė├ĢrķgŻ¼ėų─▄īŹ¼F(xi©żn)Ą═čė▀tŻ¼ęį├Ōė├æ¶┐┤╣Ø(ji©”)─┐Ģrė÷ĄĮ┬Ģ«ŗ▓╗═¼▓ĮĄ─įŃĖŌ¾w“×ĪŻ

ĪĪĪĪ╔ŽłDųąŻ¼įĮ┐┐ū¾┤·▒Ē═©ė├ąį║═┐╔ŠÄ│╠ąįįĮÅŖ;įĮ┐┐ėę┤·▒ĒīŻė├ąį║═ą¦┬╩įĮĖ▀ĪŻ─Ū├┤ GPUĪóFPGA ║═ AI ╝ė╦┘Ų„Ęųäe╠Äė┌łDųą╩▓├┤╬╗ų├─ž?

ĪĪĪĪ┤░Ė╩ŪŻ║╦³éāČ╝╠Äį┌▀@ā╔éĆśOČ╦ų«ķgĪŻ

ĪĪĪĪ┐┐Į³ ASIC ę╗Č╦Ą─╩Ū¼F(xi©żn)ł÷┐╔ŠÄ│╠▀ē▌ŗķTĻć┴ą(FPGA)ĪŻŅÖ├¹╦╝┴xŻ¼F(xi©żn)PGA ╩Ū┐╔ŠÄ│╠Ą─Ż¼Ą½ŠÄ│╠╚╦åTąĶꬊ▀éõė▓╝■įO(sh©©)ėŗų¬ūRŻ¼▀ĆĒÜī” VerilogĪóVHDL Ą╚ė▓╝■├Ķ╩÷šZčį(HDL)ėąę╗Č©┴╦ĮŌĪŻōQčįų«Ż¼F(xi©żn)PGA ŠÄ│╠┼cė▓╝■ĻP(gu©Īn)┬ō(li©ón)Č╚╠½Ė▀Ż¼Č°▄ø╝■ķ_░l(f©Ī)╚╦åT╚▒Ę”▀@ĘĮ├µĄ─ŠÄ│╠╝╝─▄║═╣żŠ▀Ż¼ę“┤╦ļyęįī”╦³▀MąąŠÄ│╠ĪŻ

ĪĪĪĪ┐┐Į³ CPU ę╗Č╦Ą─╩Ū GPUĪŻGPU ╩Ū├µŽ“╠žČ©─┐Ą─╠Ä└ĒŲ„Ż¼╔├ķL╠Ä└Ē▓óąą╚╬äš(w©┤)Ż¼└²╚ńłDą╬ų°╔½Ų„ėŗ╦Ń║═ŠžĻć│╦Ę©ĪŻCPU Ė³▀m║Žčė▀t├¶Ėąą═æ¬(y©®ng)ė├Ż¼GPU ätĖ³▀m║Žę¬Ū¾Ė▀═╠═┬┴┐Ą─æ¬(y©®ng)ė├ĪŻGPU ┼c CPU Ą─ŽÓ╦Ųų«╠Äį┌ė┌╦³éāČ╝┐╔ŠÄ│╠ĪŻČ°ū„×ķ▓óąą╠Ä└ĒŲ„Ż¼GPU ╩╣ė├ NVIDIA CUDA ║═ OpenCL Ą╚šZčįŻ¼ļm╚╗─▄╠Ä└ĒĄ─╚╬äš(w©┤)ĘNŅÉ▒╚ CPU ╔┘Ż¼Ą½į┌▀\ąą░³║¼▓óąą╚╬äš(w©┤)Ą─┤·┤aĢrśOĖ▀ą¦ĪŻ

ĪĪĪĪIntel Ą─ Habana Gaudi ╠Ä└ĒŲ„ĪóAWS Ą─ Trainium ║═ Inferentia ąŠŲ¼Ą╚ AI ╝ė╦┘Ų„ät╠Äį┌ GPU Ą─ėęé╚(c©©)ĪŻHabana Gaudi ╠Ä└ĒŲ„Š▀éõ┐╔ŠÄ│╠ąįŻ¼Ą½═©ė├ąį▒╚ GPU Ė³Ą═Ż¼╦∙ęįæ¬(y©®ng)╠Ä GPU ėęé╚(c©©)ĪŻAWS Ą─ Inferentia ąŠŲ¼▓╗┐╔ŠÄ│╠Ż¼Ą½┐╔ęį╝ė╦┘ČÓĘN▓┘ū„Ż¼╚ń╣¹─ŃĄ─ ML ─Żą═▓╗ų¦│ų▀@ą®▓┘ū„Ż¼Inferentia Š═Ģ■ł╠(zh©¬)ąą CPU ╗ž═╦(fallback)─Ż╩ĮĪŻŠC╔ŽŻ¼Inferentia æ¬(y©®ng)╠Ä Habana Gaudi Ą─ėęé╚(c©©)ĪŻ

ĪĪĪĪ3

ĪĪĪĪ“ė▓╝■Ėąų¬(Hardware-aware)” Ą─╦ŃĘ©

ĪĪĪĪ║═ “╦ŃĘ©Ėąų¬(Algorithms-aware)” Ą─ė▓╝■

ĪĪĪĪ═©▀^ęį╔ŽĘųŅÉŻ¼╬ęéāī”Ė„ĘN╠Ä└ĒŲ„ėą┴╦┤¾ų┬šJūRĪŻ Ž┬├µ╬ęéāüĒšä?w©┤)ä▀@ą®╠Ä└ĒŲ„╚ń║╬┼c▄ø╝■╗źŽÓ┼õ║ŽĪŻ

ĪĪĪĪ═©ė├ėŗ╦Ń─Żą═ėąā╔éĆĮM│╔▓┐ĘųŻ║(1) ▄ø╝■┼c╦ŃĘ©;(2) ▀\ąą▄ø╝■Ą─ė▓╝■╠Ä└ĒŲ„ĪŻę╗░ŃČ°čįŻ¼▀@ā╔▓┐Ęų╗źŽÓ¬Ü┴ó —— ŠÄīæ▄ø╝■Ģr║▄╔┘Ģ■┐╝æ]▄ø╝■Ģ■į┌╩▓├┤ė▓╝■╔Ž▀\ąą;Č°ė▓╝■įO(sh©©)ėŗĄ─│÷░l(f©Ī)³cät╩Ūūīė▓╝■▒M┐╔─▄ų¦│ųĖ³ČÓĘNŅÉĄ─▄ø╝■ĪŻ

ĪĪĪĪ═©ė├ėŗ╦Ń─Żą═ųØuč▌▀MŻ¼ąĶę¬æ¬(y©®ng)ė├ė┌╔ŅČ╚īW(xu©”)┴Ģ(x©¬)Ą╚ę¬Ū¾Ė▀ąį─▄║═Ė▀─▄ą¦Ą─ŅI(l©½ng)ė“Ż¼ę“┤╦ąĶę¬╝ėÅŖ╦ŃĘ©įO(sh©©)ėŗ║═ė▓╝■įO(sh©©)ėŗų«ķgĄ─┬ō(li©ón)ŽĄĪŻ¼F(xi©żn)┤· ML ėŗ╦Ń─Żą══¼śė░³║¼ā╔éĆĮM│╔▓┐ĘųŻ║(1) ML ╦ŃĘ©┼c▄ø╝■┐“╝▄;(2) ┼c AI ╝ė╦┘Ų„┼õ║Ž╩╣ė├Ą─═©ė├╠Ä└ĒŲ„ĪŻ

ĪĪĪĪ▓╗═¼ė┌═©ė├ėŗ╦Ń─Żą═Ą─ķ_░l(f©Ī)Ż¼ML čą░l(f©Ī)╚╦åTĢ■ßśī”╠žČ©ė▓╝■įO(sh©©)ėŗ ML ╦ŃĘ©ĪŻ▒╚╚ńŻ¼ŠÄīæ┤·┤aĢr┐╔ęį│õĘų└¹ė├ė▓╝■Ą─╠žČ©╣”─▄(╚ńų¦│ųČÓĘNŠ½Č╚Ż║INT8ĪóFP16ĪóBF16ĪóFP32)īŹ¼F(xi©żn)╠žČ©Ą─ąŠŲ¼╣”─▄(╗ņ║ŽŠ½Č╚ĪóĮY(ji©”)śŗ(g©░u)╗»ŽĪ╩Ķ)ĪŻ╚╗║¾Ż¼ė├涊═┐╔ęį═©▀^│ŻęŖĄ─ ML ▄ø╝■┐“╝▄╩╣ė├▀@ą®╣”─▄ĪŻ═¼└ĒŻ¼ė▓╝■įO(sh©©)ėŗĤĢ■ßśī”╠žČ©╦ŃĘ©śŗ(g©░u)Į© AI ╝ė╦┘Ų„ĪŻ▒╚╚ńŻ¼×ķ╝ė╦┘ ML ŠžĻćėŗ╦ŃČ°įO(sh©©)ėŗīŻķTĄ─ąŠŲ¼╣”─▄(╚ń NVIDIA į┌ Volta GPU ╝▄śŗ(g©░u)ųąę²╚ļ Tensor Core)ĪŻ

ĪĪĪĪ▀@Š═╩Ū AI ╝ė╦┘Ų„║═ ML ╦ŃĘ©Ą─ģf(xi©”)═¼▀M╗»ĪŻė▓╝■įO(sh©©)ėŗĤ×ķ AI ╝ė╦┘Ų„į÷╝ė ML ╦ŃĘ©┐╔ęį╩╣ė├Ą─╣”─▄Ż¼Č° ML čą░l(f©Ī)╚╦åTät└¹ė├ AI ╝ė╦┘Ų„Ą─ė▓╝■╣”─▄┴┐╔ĒįO(sh©©)ėŗą┬Ą─╦ŃĘ©ĪŻ

ĪĪĪĪė▓╝■║═▄ø╝■Ą─ģf(xi©”)═¼┐╔ęįĦüĒĖ³║├Ą─ąį─▄║═Ė³Ė▀Ą──▄ą¦ĪŻ

ĪĪĪĪ4

ĪĪĪĪAI ╝ė╦┘Ų„┼cĖ▀ą¦ ML ╦ŃĘ©Ą─ģf(xi©”)═¼▀M╗»

ĪĪĪĪAI ╝ė╦┘Ų„Ęų×ķā╔ŅÉŻ║ (1) ė├ė┌ė¢(x©┤n)ŠÜĄ─ AI ╝ė╦┘Ų„; (2) ė├ė┌═Ų└ĒĄ─ AI ╝ė╦┘Ų„ĪŻ ė╔ė┌ė¢(x©┤n)ŠÜ║══Ų└ĒĄ──┐ś╦▓╗═¼Ż¼Č° AI ╝ė╦┘Ų„╩Ūßśī”╠žČ©╣żū„žō▌dĄ─īŻė├╠Ä└ĒŲ„Ż¼ę“┤╦ėą▒žę¬×ķ▓╗═¼ŅÉą═Ą─╣żū„žō▌dĘųäeįO(sh©©)ėŗ╠Ä└ĒŲ„ĪŻ

ĪĪĪĪė├ė┌ė¢(x©┤n)ŠÜĄ─ AI ╝ė╦┘Ų„Ą──┐ś╦╩Ū£p╔┘ė¢(x©┤n)ŠÜĢrķgŻ¼Č°Ūęæ¬(y©®ng)Š▀éõ─▄┼õ║Žė¢(x©┤n)ŠÜ╦ŃĘ©Ą─ė▓╝■╠ž³cĪŻ ę“┤╦Ż¼AI ė¢(x©┤n)ŠÜ╝ė╦┘Ų„Ą─╣”┬╩═©│Ż▌^┤¾Ż¼ā╚(n©©i)┤µ┐šķgę▓▌^┤¾Ż¼ęįØMūŃ▌^Ė▀Ą─═╠═┬┴┐(├┐├ļ╠Ä└ĒĄ─öĄ(sh©┤)ō■(j©┤))ę¬Ū¾ĪŻ ė╔ė┌ AI ė¢(x©┤n)ŠÜ╝ė╦┘Ų„ūóųž═╠═┬┴┐Ż¼ę“┤╦╠ßĖ▀═╠═┬┴┐║═└¹ė├┬╩ėąų·ė┌ĮĄĄ═─▄║─│╔▒Š(╝┤═©▀^öU┤¾═╠═┬┴┐ĮĄĄ═ “─▄║─ / ═╠═┬┴┐” ų«ķgĄ─▒╚┬╩)ĪŻ AI ė¢(x©┤n)ŠÜ╝ė╦┘Ų„▀Ćų¦│ų╗ņ║ŽŠ½Č╚ė¢(x©┤n)ŠÜŻ¼╩╣ė├▌^Ą═Š½Č╚ęį╝ė┐ņėŗ╦Ń╦┘Č╚Ż¼╩╣ė├Ė▀Š½Č╚└█Ęeėŗ╦ŃĮY(ji©”)╣¹Ż¼Å─Č°īŹ¼F(xi©żn)▒╚═©ė├╠Ä└ĒŲ„Ė³Ė▀Ą──▄ą¦ĪŻ (║¾╬─▀Ćīóįöšä AI ╝ė╦┘Ų„Ą─╗ņ║ŽŠ½Č╚ė¢(x©┤n)ŠÜĪŻ )

ĪĪĪĪAI ═Ų└Ē╝ė╦┘Ų„Ą──┐ś╦╩ŪŻ¼į┌▀\ąą┤¾┴┐¬Ü┴óöĄ(sh©┤)ō■(j©┤)┼·┤╬ĢrĮĄĄ═ŅA(y©┤)£yčė▀tŻ¼ę“┤╦ąĶꬊ▀éõĖ▀─▄ą¦╠ž³cŻ¼ąĶę¬ĮĄĄ═ “─▄║─ / ŅA(y©┤)£y” ų«ķgĄ─▒╚┬╩ĪŻļm╚╗ę▓┐╔īóė¢(x©┤n)ŠÜ╝ė╦┘Ų„ė├ė┌═Ų└Ē╝ė╦┘(«ģŠ╣ė¢(x©┤n)ŠÜųąĄ─Ū░Ž“é„▓ź▀^│╠▒Š┘|(zh©¼)╔Ž╝┤╩Ūę╗ĘN═Ų└Ē╚╬äš(w©┤))Ż¼Ą½╩╣ė├ė¢(x©┤n)ŠÜ╝ė╦┘Ų„ĢrŻ¼“─▄║─ / ═Ų└Ē” ų«▒╚Ģ■┤¾║▄ČÓŻ¼ę“×ķė¢(x©┤n)ŠÜ╝ė╦┘Ų„╠Ä└ĒąĪą═öĄ(sh©┤)ō■(j©┤)┼·┤╬Ą─═Ų└ĒšłŪ¾Ģr└¹ė├┬╩▌^Ą═ĪŻ

ĪĪĪĪė¢(x©┤n)ŠÜ╝ė╦┘Ų„Š═Ž±╣½Į╗▄ćŻ¼ų╗ėą▒Ż│ų│╦┐═ØMåT▓┼─▄īŹ¼F(xi©żn)Ė▀─▄ą¦(ė═║─ / │╦┐═öĄ(sh©┤)ų«▒╚Ą═)ĪŻ╚ń╣¹┘╝┤¾Ą─╣½Į╗▄ć├┐┤╬ų╗▌dę╗éĆ╚╦Ż¼Ųõė═║─ / │╦┐═öĄ(sh©┤)ų«▒╚īóūāĄ├śOĖ▀ĪŻČ°═Ų└Ē╝ė╦┘Ų„Š═Ž±┼▄▄ćŻ¼Ųõ╦┘Č╚▒╚╣½Į╗▄ć┐ņŻ¼ų╗▌dę╗╚╦Ģr─▄ą¦▒╚╣½Į╗▄ćĖ▀(┼▄▄ćĄ─å╬├¹│╦┐═ė═║─▒╚╣½Į╗▄ćĄ═)ĪŻĄ½╚ń╣¹Žļė├┼▄▄ćę╗┤╬▌d 50 éĆ╚╦Ż¼╦³Š═Ģ■┼▄Ą├śO┬²(║╬ør│¼▌d▀`Ę©)ĪŻ

ĪĪĪĪŽ┬╬─īóĘųäešä?w©┤)ōė?x©┤n)ŠÜ║══Ų└ĒĄ─╣żū„┴„Ż¼ęį╝░ AI ╝ė╦┘Ų„║═▄ø╝■æ¬(y©®ng)Š▀éõ╩▓├┤╠ž³c▓┼─▄į┌ė¢(x©┤n)ŠÜ║══Ų└ĒųąīŹ¼F(xi©żn)Ė▀ąį─▄║═Ė▀─▄ą¦ĪŻ

ĪĪĪĪ5

ĪĪĪĪßśī”═Ų└ĒĄ─ AI ╝ė╦┘Ų„┼cĖ▀ą¦╦ŃĘ©

ĪĪĪĪML ═Ų└Ē╝┤╩ŪĖ∙ō■(j©┤)ą┬Ą─öĄ(sh©┤)ō■(j©┤)╩╣ė├ė¢(x©┤n)ŠÜ║├Ą──Żą═ęį▌ö│÷ŅA(y©┤)£yĮY(ji©”)╣¹ĪŻ ▒Š╣Ø(ji©”)īóėæšō AI ╝ė╦┘Ų„╔Ž▀\ąąĄ─┐╔╠ß╔²═Ų└Ēąį─▄║═ą¦┬╩Ą─╦ŃĘ©ĪŻ

ĪĪĪĪ╠ß╔²ÖCŲ„īW(xu©”)┴Ģ(x©¬)ą¦┬╩ūŅųžę¬Ą─ĘĮĘ©╩Ū┴┐╗»ĪŻę¬│õĘų└ĒĮŌ┴┐╗»Ż¼╩ūŽ╚ĒÜ┴╦ĮŌėŗ╦ŃÖCė▓╝■ųąĄ─öĄ(sh©┤)ūų▒Ē╩ŠĘĮĘ©ĪŻĖĪ³cöĄ(sh©┤)╩ŪöĄ(sh©┤)ūųėŗ╦ŃÖCųąė├ęį▒Ē╩Š▀B└m(x©┤)īŹųĄĄ─ļx╔ó▒Ē╩Šą╬╩ĮĪŻML ╦ŃĘ©═©│Ż╗∙ė┌ IEEE 754 ś╦£╩ė├å╬Š½Č╚(FP32)ā”┤µ║═╠Ä└ĒöĄ(sh©┤)ūųĪŻIEEE 754 ▀ĆęÄ(gu©®)Č©┴╦ AI ╝ė╦┘Ų„ų¦│ųĄ─Ųõ╦¹│ŻęŖĖĪ³cŅÉą═Ż¼╚ń░ļŠ½Č╚(FP16)║═ļpŠ½Č╚(FP64)ĪŻ

ĪĪĪĪ¼F(xi©żn)┤· AI ╝ė╦┘Ų„ę▓ų¦│ų IEEE 754 ęį═ŌĄ─öĄ(sh©┤)ūųĖ±╩ĮŻ¼└²╚ń BF16(ė╔ Google Brain ę²▀M;NVIDIA Ampere GPUĪóAWS InferentialĪóAWS TraniumĪóIntel Habana Gaudi ║═ Google TPU Š∙ų¦│ų┤╦Ė±╩Į)║═ TF32(NVIDIA Ampere ╝▄śŗ(g©░u)║═ AWS Tranium ąŠŲ¼ų¦│ų┤╦Ė±╩Į)ĪŻ═Ų└Ē╝ė╦┘Ų„▀Ćų¦│ųš¹öĄ(sh©┤)Š½Č╚Ż¼╚ń INT8 ║═ INT4ĪŻ

ĪĪĪĪ┴┐╗»į┌═Ų└ĒųąĄ─ā×(y©Łu)ä▌

ĪĪĪĪį┌═Ų└Ē╚╬äš(w©┤)ųąŻ¼─Żą═ÖÓ(qu©ón)ųž║═╝ż╗Ņ║»öĄ(sh©┤)▌ö│÷Š∙┐╔▒╗┴┐╗»Ż¼└²╚ń┐╔īó FP32(ė¢(x©┤n)ŠÜ│Żė├Š½Č╚)▐D(zhu©Żn)╗»×ķĖ³Ą═Š½Č╚Ą─▒Ē╩Šą╬╩Į(FP16ĪóBF16 ║═ INT8)ĪŻ╩╣ė├▌^Ą═Š½Č╚┐╔ęį½@Ą├Ė³Ė▀Ą─ąį─▄║═─▄ą¦ĪŻ«ö░č FP32 ▐D(zhu©Żn)╗»×ķ FP16 ▓┘ū„ĢrŻ¼öĄ(sh©┤)ō■(j©┤)┤¾ąĪ┐╔£p░ļŻ¼─▄║─┐╔£p╔┘╝s 75%(öĄ(sh©┤)ō■(j©┤)üĒį┤Ż║ https://arxiv.org/pdf/1506.02626v3.pdf ) Ż¼╩╣ė├Ą─╣Ķ├µĘe(silicon area)ę▓┐╔£p╔┘╝s 75%ĪŻ

ĪĪĪĪ╚ń╣¹āHÅ─═Ų└ĒĄ─ĮŪČ╚┐╝æ]ė▓╝■įO(sh©©)ėŗŻ¼┐╔ęįśŗ(g©░u)Į©āH╣®═Ų└Ē╩╣ė├ĪóāHų¦│ų▌^Ą═Š½Č╚Ą─╝ė╦┘Ų„Ż¼▀@śėŠ═┐╔ęį┐sąĪ╝ė╦┘Ų„Ą─│▀┤ńŻ¼▓ó╠ßĖ▀─▄ą¦ĪŻīó▀\╦ŃĮY(ji©”)╣¹Å─ FP32 ▐D(zhu©Żn)╗»×ķ INT8 öĄ(sh©┤)ō■(j©┤)▀Ć┐╔▀Mę╗▓Į£p╔┘─▄║─Ż¼ę“×ķöĄ(sh©┤)ō■(j©┤)┤¾ąĪ£p╔┘ĄĮįŁüĒĄ─ 1/4ĪŻ

ĪĪĪĪ╚╗Č°Ż¼═©▀^┴┐╗»ĘĮĘ©╠ß╔²ėŗ╦Ńą¦┬╩Ģ■ōp╩¦ę╗Č©Ą─ŅA(y©┤)£y£╩┤_ąįĪŻę“×ķīóĖ▀Š½Č╚▒Ē╩Šą╬╩Į▐D(zhu©Żn)╗»×ķĄ═Š½Č╚▒Š┘|(zh©¼)╔Ž╩Ūę╗ĘNē║┐sŻ¼ē║┐sęŌ╬Čų°Ģ■ōp╩¦▓┐ĘųöĄ(sh©┤)ō■(j©┤)ĪŻFP32 Ą─äėæB(t©żi)ĘČć·▒╚ FP16 ║═ INT8 Ė³┤¾Ż¼ę“┤╦Ż¼═Ų└ĒųąŻ¼┴┐╗»Ą──┐Ą─╩Ū▒Ż┴¶öĄ(sh©┤)ō■(j©┤)ųąĄ─ “ą┼╠¢”Ż¼╚ź│²öĄ(sh©┤)ō■(j©┤)ųąĄ─ “įļ┬Ģ”Ż¼×ķīŹ¼F(xi©żn)▀@éĆ─┐Ą─┐╔ęįėąČÓĘNĘĮĘ©ĪŻ

ĪĪĪĪ╩╣ė├ NVIDIA GPU ▀Mąą┴┐╗»

ĪĪĪĪNVIDIA Ą─ Ampere ║═ Turing Ą╚▌^ą┬ GPU ╝▄śŗ(g©░u)Š∙ų¦│ųČÓĘNŠ½Č╚ŅÉą═ĪŻ2016 ─ĻŻ¼NVIDIA į┌ Pascal ╝▄śŗ(g©░u)ųą╩ū┤╬ę²▀M┴╦ FP16 Š½Č╚ŅÉą═Ż¼Č°ūŅą┬Ą─ Ampere ║═ Turing ╝▄śŗ(g©░u) GPU Š∙¾w¼F(xi©żn)┴╦ “ė▓╝■┼c╦ŃĘ©Ą─ģf(xi©”)═¼▀M╗»”ĪŻ╬ęų«Ū░īæ▀^ę╗Ų¬╬─š┬ĮķĮB GPU Ą─═Ļš¹░l(f©Ī)š╣╩Ę║═▓╗═¼╝▄śŗ(g©░u)Ą─ GPU ╝░Ųõ╠ž³cŻ║Choosing the right GPU for deep learning on AWS( https://towardsdatascience.com/choosing-the-right-gpu-for-deep-learning-on-aws-d69c157d8c86 )ĪŻ

ĪĪĪĪ▒Š╣Ø(ji©”)īóŠ█Į╣ė▓╝■║═▄ø╝■īė├µ╚ń║╬ų¦│ų GPU ▀Mąą┴┐╗»ĪŻ

ĪĪĪĪęį NVIDIA Ą─ Ampere ╝▄śŗ(g©░u)×ķ└²ĪŻ─Ń┐╔ęįį┌ AWS įŲĘ■äš(w©┤)Ų„╔Ž═©▀^åóäė Amazon EC2 p4d īŹ└²╗“ G5 īŹ└²¾w“× Ampere ╝▄śŗ(g©░u)Ą─ąį─▄ĪŻp4d ║═ G5 īŹ└²Ęųäe╩╣ė├ NVIDIA Ą─ A100 ║═ A10G GPUŻ¼ā╔┐Ņ GPU Č╝╗∙ė┌ Ampere ╝▄śŗ(g©░u)Ż¼Č╝ų¦│ų FP64ĪóFP32ĪóFP16Īó INT8ĪóBF16 ║═ TF32 Š½Č╚ŅÉą═Ż¼ę▓Č╝░³║¼ę╗ĘN▒╗ NVIDIA ĘQ×ķ “Tensor Core” Ą─▀\╦Ńå╬į¬Ż¼ė├ė┌╗ņ║ŽŠ½Č╚ėŗ╦ŃĪŻ═Ų└ĒĢrė├ĄĮĄ─ųž³cŠ½Č╚ŅÉą═ų╗ėą FP16 ║═ INT8 ā╔ĘN(Ųõ╦¹Š½Č╚ŅÉą═īóį┌Ž┬ę╗╣Ø(ji©”)ųą╠ߥĮė¢(x©┤n)ŠÜĢrįöšä)ĪŻ

ĪĪĪĪ┤¾ČÓöĄ(sh©┤)╔ŅČ╚īW(xu©”)┴Ģ(x©¬)┐“╝▄Č╝╩╣ė├ NVIDIA GPU ║═ FP32 Ė±╩Įė¢(x©┤n)ŠÜ─Żą═Ż¼ę“┤╦ NVIDIA ═Ų│÷ TensorRT ŠÄūgŲ„Ż¼ė├ęį╝ė┐ņ═Ų└Ē╦┘Č╚ĪŻTensorRT ┐╔īó FP32 Ė±╩ĮĄ──Żą═ÖÓ(qu©ón)ųž║═╝ż╗Ņ║»öĄ(sh©┤)┴┐╗»×ķ FP16 ║═ INT8 Ė±╩ĮĪŻ┴┐╗»ĢrŻ¼TensorRT Ž╚┤_Č©ę╗éĆ▒╚└²ę“ūė(scaling factor)Ż¼╚╗║¾Ė∙ō■(j©┤)įōŽĄöĄ(sh©┤)īó FP32 Ą─äėæB(t©żi)ĘČć·ė│╔õĄĮ FP16 ╗“ INT8 Ą─äėæB(t©żi)ĘČć·ĪŻė│╔õĄĮ INT8 Ą─ļyČ╚ė╚ŲõĖ▀Ż¼ę“×ķ INT8 Ą─äėæB(t©żi)ĘČć·▒╚ FP32 ąĪ╠½ČÓĪŻINT8 āH─▄▒Ē╩Š 256 éĆöĄ(sh©┤)ųĄŻ¼Č° FP32 ūŃūŃ─▄▒Ē╩Š 4.2×109 éĆöĄ(sh©┤)ųĄĪŻ

ĪĪĪĪ╚ń║╬į┌═©▀^┴┐╗»╠ßĖ▀═Ų└Ē╦┘Č╚Ą─═¼Ģr£p╔┘Š½Č╚ōp╩¦?ę╗░Ńėąā╔ĘNĘĮĘ©Ż║

ĪĪĪĪė¢(x©┤n)ŠÜ║¾┴┐╗»(PTQ)Ż║╩╣ė├ę╗éĆė¢(x©┤n)ŠÜ║├Ą─Īóęį FP32 Ė±╩Įėŗ╦ŃĄ──Żą═Ż¼┤_Č©▒╚└²ę“ūėŻ¼╚╗║¾īó FP32 ė│╔õ×ķ INT8ĪŻ┤_Č©▒╚└²ę“ūėĄ─ĘĮĘ©╩ŪŻ║TensorRT ║Ō┴┐├┐éĆ╔±Įø(j©®ng)ŠW(w©Żng)Įj(lu©░)īėųą╝ż╗Ņ║»öĄ(sh©┤)▌ö│÷Ą─Ęų▓╝Ż¼╚╗║¾šęĄĮę╗éĆ╩╣ģó┐╝Ęų▓╝(reference distribution)║═┴┐╗»Ęų▓╝(quantized distribution)ų«ķgą┼Žóōp╩¦(KL ╔óČ╚)ūŅąĪĄ─▒╚└²ę“ūėĪŻ

ĪĪĪĪ┴┐╗»Ėąų¬ė¢(x©┤n)ŠÜ(QAT)Ż║į┌ė¢(x©┤n)ŠÜųąėŗ╦Ń▒╚└²ę“ūėŻ¼╩╣─Żą═┐╔ęį▀mæ¬(y©®ng)ą┼Žóōp╩¦▓óīóą┼Žóōp╩¦ĮĄĄĮūŅĄ═ĪŻ

ĪĪĪĪ┐╔ęŖŻ¼ė▓╝■▓╗öÓ░l(f©Ī)š╣Ż¼Š▀éõĖ³ČÓ┐╔╠ß╔²ą¦┬╩Ą─╣”─▄(╚ńĮĄĄ═Š½Č╚)ĪŻ ═¼ĢrŻ¼╦ŃĘ©ę▓▓╗öÓ▀M╗»Ż¼┐╔ęįĖ³║├Ąž└¹ė├ė▓╝■Ą─╣”─▄ĪŻ

ĪĪĪĪ╬ęĄ─┴Ēę╗Ų¬╬─š┬╠ß╣®┴╦ NVIDIA TensorRT į┌ GPU ╔ŽīŹąą┴┐╗»Ą─┤·┤a╩Š└² ( https://towardsdatascience.com/a-complete-guide-to-ai-accelerators-for-deep-learning-inference-gpus-aws-inferentia-and-amazon-7a5d6804ef1c )ĪŻ

ĪĪĪĪ╩╣ė├ AWS Inferentia ąŠŲ¼▀Mąą┴┐╗»

ĪĪĪĪNVIDIA GPU įO(sh©©)ėŗų«│§ė├ė┌łDŽ±╠Ä└Ē╝ė╦┘Ż¼║¾üĒ▓┼č▌ūā│╔ÅŖ┤¾Ą─ AI ╝ė╦┘Ų„Ż¼Č° AWS Inferentia ąŠŲ¼ę╗ķ_╩╝╝┤╩Ū×ķÖCŲ„īW(xu©”)┴Ģ(x©¬)═Ų└ĒČ°╔·ĪŻ

ĪĪĪĪ├┐ēK AWS Inferentia ąŠŲ¼║¼ 4 éĆ NeuronCoreĪŻNeuronCore ╩Ū╗∙ė┌├}äėĻć┴ąĄ─ŠžĻćŽÓ│╦ę²ŪµŻ¼ėąā╔╝ē┤µā”īė┤╬ĮY(ji©”)śŗ(g©░u)║═śO┤¾Ą─Ų¼╔ŽŠÅ┤µ┐šķgĪŻAWS Inferentia ąŠŲ¼ų¦│ų FP16ĪóBF16 ║═ INT8 öĄ(sh©┤)ō■(j©┤)ŅÉą═Ż¼▓╗ų¦│ųĖ³Ė▀Š½Č╚Ą─Ė±╩Į —— «ģŠ╣ AWS Inferentia ╩Ūę╗ĘN═Ų└ĒīŻė├╠Ä└ĒŲ„Ż¼═Ų└ĒĢr¤oĒÜė├ĄĮĖ³Ė▀Ą─Š½Č╚ĪŻš²╚ń NVIDIA ×ķ GPU ═Ų│÷┴╦ TensorRT ŠÄūgŲ„Ż¼AWS ę▓═Ų│÷┴╦ AWS Neuron SDK ║═ AWS Neuron ŠÄūgŲ„Ż¼įōŠÄūgŲ„ų¦│ų┴┐╗»║═ā×(y©Łu)╗»Ż¼┐╔╠ßĖ▀═Ų└Ēą¦┬╩ĪŻ

ĪĪĪĪ▒M╣▄ AWS Inferentia ąŠŲ¼ų¦│ų INT8 Ė±╩ĮŻ¼Ą½Įžų┴▒Š╬─ū½īæĢrŻ¼AWS Neuron ŠÄūgŲ„ų╗ų¦│ų┴┐╗»ĄĮ FP16 ║═ BF16 Ė±╩ĮĪŻ ė├ FP32 Ė±╩Įė¢(x©┤n)ŠÜĄ──Żą═Ģ■į┌ŠÄūg▀^│╠ųąūįäė▒╗▐D(zhu©Żn)╗»×ķ BF16 Ė±╩ĮĪŻ ╚ń╣¹į┌╩╣ė├ AWS Neuron ŠÄūgŲ„ų«Ū░╚╦╣żīó FP32 Ė±╩ĮĄ─ÖÓ(qu©ón)ųž┴┐╗»×ķ FP16Ż¼─Ū├┤ŠÄūgŲ„Š═Ģ■▒Ż┴¶ FP16 Š½Č╚ė├ė┌═Ų└ĒĪŻ

ĪĪĪĪ┼c GPU ŽÓ▒╚Ż¼AWS Inferentia ąŠŲ¼▓╗┐╔ŠÄ│╠Ż¼īŻė├ąį▒╚ GPU Ė³ÅŖŻ¼Ė³ĮėĮ³ ASICĪŻ ╚ń╣¹─Żą═ųą░³║¼Ą─▓┘ū„Š∙×ķ AWS Inferentia ╦∙ų¦│ųŻ¼─Ū├┤ī”ė┌╠žČ©Ą──Żą═║═┼·┤╬ęÄ(gu©®)─Ż(batch size)Č°čįŻ¼╩╣ė├ Inferentia Š═▒╚╩╣ė├ GPU Ė³─▄╠ßĖ▀─Żą═Ą──▄ą¦ĪŻ ╚╗Č°Ż¼╚ń╣¹─Żą═║¼ėą Inferentia ▓╗ų¦│ųĄ─▓┘ū„Ż¼AWS Neuron ŠÄūgŲ„Ģ■ūįäėīóŽÓæ¬(y©®ng)▓┘ū„ų├ė┌ų„ÖC CPU ╔ŽŻ¼▀@Š═ī¦(d©Żo)ų┬ CPU ║═╝ė╦┘Ų„ų«ķgąĶę¬▀MąąöĄ(sh©┤)ō■(j©┤)░ß▀\Ż¼▀MČ°ĮĄĄ═ąį─▄║═ą¦┬╩ĪŻ

ĪĪĪĪ6

ĪĪĪĪßśī”ė¢(x©┤n)ŠÜĄ─ AI ╝ė╦┘Ų„┼cĖ▀ą¦╦ŃĘ©

ĪĪĪĪML ė¢(x©┤n)ŠÜ╝┤└¹ė├ė¢(x©┤n)ŠÜöĄ(sh©┤)ō■(j©┤)ā×(y©Łu)╗»─Żą═ģóöĄ(sh©┤)Ż¼ęį╠ßĖ▀─Żą═Ą─ŅA(y©┤)£y£╩┤_Č╚ĪŻ▒Š╣Ø(ji©”)īóėæšō AI ╝ė╦┘Ų„╔Ž▀\ąąĄ─╦ŃĘ©╚ń║╬╠ß╔²═Ų└Ēąį─▄║═─▄ą¦ĪŻ

ĪĪĪĪĮėŽ┬üĒ╬ęéāę└┼fĢ■ėæšōŠ½Č╚Ż¼▓╗▀^▀@┤╬╩ŪÅ─ė¢(x©┤n)ŠÜ╣żū„┴„Ą─ĮŪČ╚ĪŻ ╚ńŪ░╦∙╩÷Ż¼ė¢(x©┤n)ŠÜĢrŻ¼─Żą═ÖÓ(qu©ón)ųž║═╝ż╗Ņ║»öĄ(sh©┤)Č╝ęį FP32 Ė±╩Į┤µā”Ż¼F(xi©żn)P32 ū±čŁįńį┌╔ŅČ╚īW(xu©”)┴Ģ(x©¬)ų«Ū░Š═šQ╔·Ą─ IEEE 754 ĖĪ³cöĄ(sh©┤)ś╦£╩ĪŻ FP32 ų«╦∙ęį▒╗▀x×ķÖCŲ„īW(xu©”)┴Ģ(x©¬)─¼šJĄ─ĖĪ³cöĄ(sh©┤)▒Ē╩Šą╬╩ĮŻ¼╩Ūę“×ķė¢(x©┤n)ŠÜĢr FP16 ┐╔▒Ē╩ŠĄ─ą┼Žó┴┐▓╗ē“┤¾Ż¼Č° FP64 ┐╔▒Ē╩ŠĄ─ą┼Žó┴┐ät╠½┤¾Ż¼Č°Ūęę▓▓╗▒žė├ĄĮ▀@├┤Ė▀Ą─Š½Č╚ĪŻ ÖCŲ„īW(xu©”)┴Ģ(x©¬)ąĶę¬ę╗ĘNŠ½Č╚╠Äį┌ FP16 ║═ FP64 ų«ķgĄ─▒Ē╩ŠĖ±╩ĮŻ¼Ą½«öĢrĄ─ė▓╝■▓ó▓╗ų¦│ųĪŻ

ĪĪĪĪōQčįų«Ż¼«öĢrĄ─ė▓╝■▓ó▓╗─▄ØMūŃ ML ╦ŃĘ©Ą─ąĶŪ¾Ż¼▓ó╬┤│╔×ķ “╦ŃĘ©Ėąų¬” Ą─ė▓╝■ĪŻ

ĪĪĪĪ╚ń╣¹«öĢrĄ─ ML 蹊┐╚╦åTėąĖ³║├Ą─▀xō±Ż¼╦¹éāæ¬(y©®ng)įōĢ■▀xę╗ĘN▓╗═¼ė┌ FP32 Ą─Ė±╩ĮŻ¼╗“š▀╩╣ė├╗ņ║ŽŠ½Č╚üĒ╠ß╔²ąį─▄║═ą¦┬╩ĪŻ ╗ņ║ŽŠ½Č╚ę▓š²╩Ū─┐Ū░ AI ╝ė╦┘Ų„Ą─░l(f©Ī)š╣ĘĮŽ“ĪŻ īŹ¼F(xi©żn)╗ņ║ŽŠ½Č╚Ż¼ąĶę¬ė▓╝■║═╦ŃĘ©Ą─ģf(xi©”)═¼įO(sh©©)ėŗĪŻ

ĪĪĪĪ╗ņ║ŽŠ½Č╚ė¢(x©┤n)ŠÜ╠ß╔²ąį─▄┼cą¦┬╩

ĪĪĪĪŠžĻć│╦Ę©▀\╦Ń╩Ū╔±Įø(j©®ng)ŠW(w©Żng)Įj(lu©░)ė¢(x©┤n)ŠÜ║══Ų└ĒĄ─╗∙▒Š▓┘ū„ĪŻ AI ╝ė╦┘Ų„Ą─ų„ę¬╣żū„╝┤×ķį┌╔±Įø(j©®ng)ŠW(w©Żng)Įj(lu©░)Ą─▓╗═¼īėųąīó▌ö╚ļöĄ(sh©┤)ō■(j©┤)║═ÖÓ(qu©ón)ųžĄ─┤¾ą═ŠžĻćŽÓ│╦ĪŻ ╗ņ║ŽŠ½Č╚ė¢(x©┤n)ŠÜ▒│║¾Ą─╦╝Žļ╩ŪŻ¼ė¢(x©┤n)ŠÜĢrĄ─ŠžĻć│╦Ę©░l(f©Ī)╔·į┌▌^Ą═Š½Č╚▒Ē╩Š(FP16ĪóBF16ĪóTF32)Ż¼ę“┤╦╦³éāĖ³┐ņ║═─▄ą¦Ė³Ė▀Ż¼╚╗║¾ė├ FP32 Ė±╩Į└█Ęe▀\╦ŃĮY(ji©”)╣¹Ż¼ęįĮĄĄ═ą┼Žóōp╩¦Ż¼Å─Č°╠ß╔²ė¢(x©┤n)ŠÜ╦┘Č╚║═─▄ą¦ĪŻ

ĪĪĪĪ╩╣ė├ NVIDIA GPU ▀Mąą╗ņ║ŽŠ½Č╚ė¢(x©┤n)ŠÜ

ĪĪĪĪ2017 ─ĻŻ¼NVIDIA ą¹▓╝═Ų│÷ Volta GPU ╝▄śŗ(g©░u)Ż¼Ųõųą░³║¼īŻķTė├ė┌ÖCŲ„īW(xu©”)┴Ģ(x©¬)Ą─ Tensor Core ▀\╦Ńå╬į¬ĪŻTensor Core ═©▀^ FP16 ▀\╦Ń║═ FP32 └█ĘeĮY(ji©”)╣¹īŹ¼F(xi©żn)╗ņ║ŽŠ½Č╚ė¢(x©┤n)ŠÜ( https://arxiv.org/abs/1710.03740 )ĪŻNVIDIA Ą─ą┬ę╗┤·ą┬╝▄śŗ(g©░u)▀Ćų¦│ųĖ³ČÓĄ═Š½Č╚Ė±╩Į(BF16ĪóTF32)ĪŻį┌ąŠŲ¼īė┤╬Ż¼Tensor Core ł╠(zh©¬)ąąĄ═Š½Č╚(reduced-precision)╚┌║Ž│╦╝ė(FMA)▀\╦ŃŻ¼ė├ FP32 └█ĘeĮY(ji©”)╣¹ĪŻ

ĪĪĪĪ├┐ę╗┤· NVIDIA ╝▄śŗ(g©░u)Ą─▀M▓ĮČ╝¾w¼F(xi©żn)┴╦ė▓╝■║═╦ŃĘ©ų«ķgĄ─ģf(xi©”)═¼įO(sh©©)ėŗ║═ģf(xi©”)═¼░l(f©Ī)š╣ĪŻ

ĪĪĪĪNVIDIA Volta ╝▄śŗ(g©░u)(2017)ę²╚ļĄ┌ę╗┤· Tensor CoreŻ¼«öĢrāHų¦│ų FP16 ▀\╦Ń║═ FP32 └█ĘeĮY(ji©”)╣¹ĪŻ

ĪĪĪĪNVIDIA Turing ╝▄śŗ(g©░u)(2018)Ą─ Tensor Core ų¦│ųĖ³Ą═Š½Č╚Ą─ INT8 ║═ INT4(ų„ę¬┐╔ęį╝ė╦┘═Ų└ĒŻ¼Č°ĘŪ╝ė╦┘ė¢(x©┤n)ŠÜ)ĪŻ

ĪĪĪĪNVIDIA Ampere ╝▄śŗ(g©░u)(2020)Ą─ Tensor Core ▀Ćų¦│ų BF16 ║═ TF32Ż¼ę▓Š═╩ŪšfŻ¼╦³┐╔ęįł╠(zh©¬)ąą FP16ĪóBF16 ║═ TF32 ▀\╦ŃŻ¼▓óŪęė├ FP32 └█ĘeĮY(ji©”)╣¹Ż¼ęįīŹ¼F(xi©żn)╗ņ║ŽŠ½Č╚

ĪĪĪĪ╗ņ║ŽŠ½Č╚ė¢(x©┤n)ŠÜĄ─ę╗┤¾ļy³c╩Ū▄ø╝■īė├µĄ─īŹ¼F(xi©żn)ĪŻ ė├æ¶▒žĒÜį┌ė¢(x©┤n)ŠÜĢrł╠(zh©¬)ąąŅ~═ŌĄ─▓┘ū„Ż¼▒╚╚ńīóÖÓ(qu©ón)ųž▐D(zhu©Żn)╗»×ķ FP16 Ė±╩ĮŻ¼Ą½═¼ĢrĢ■▒Ż┴¶ÖÓ(qu©ón)ųžĄ─ FP32 Ė▒▒Š║═ōp╩¦┐sĘ┼(loss scaling)ĪŻ ▒M╣▄ NVIDIA ┐╔ęįūī╔ŅČ╚īW(xu©”)┴Ģ(x©¬)┐“╝▄į┌ų╗ąĶą▐Ė─╔┘┴┐┤·┤aĄ─ŪķørŽ┬ł╠(zh©¬)ąą▀@ą®▓┘ū„Ż¼╦³ī”ė├æ¶Ą─ę¬Ū¾ę└╚╗║▄Ė▀Ż¼▓╗Ž±╩╣ė├ FP32 ė¢(x©┤n)ŠÜ─Ū├┤║åå╬ĪŻ

ĪĪĪĪNVIDIA Ą─ Ampere ╝▄śŗ(g©░u)ų¦│ų TF32Ż¼┐╔ęįėąą¦ĮŌøQ▀@ę╗ė├涾w“×ļyŅ}ĪŻTF32 Ė±╩ĮĄ─║├╠Äį┌ė┌Ż¼╦³ĮY(ji©”)║Ž┴╦ FP32 Ą─äėæB(t©żi)ĘČć·║═ FP16 Ą─Š½Č╚Ż¼ę“┤╦╔ŅČ╚īW(xu©”)┴Ģ(x©¬)┐“╝▄¤oąĶ▐D(zhu©Żn)ōQĖ±╩Į║═▒Ż┴¶Ė▒▒ŠĄ╚Ņ~═Ō▓┘ū„╝┤┐╔ų▒Įėų¦│ų TF32 Ė±╩ĮĪŻ╚╗Č°Ż¼į┌×ķķ_░l(f©Ī)š▀£p╔┘┬ķ¤®Ą─ŪķørŽ┬Ż¼╩╣ė├ TF32 ┐╔īŹ¼F(xi©żn)▒╚ FP32 Ė³║├Ą─ąį─▄Ż¼Ą½ NVIDIA ę└╚╗═Ų╦]╩╣ė├ FP16 ╗“ BF16 Ė±╩Į▀Mąą╗ņ║ŽŠ½Č╚ė¢(x©┤n)ŠÜŻ¼ęį▒Ń½@Ą├ūŅ┐ņĄ─ė¢(x©┤n)ŠÜąį─▄ĪŻ

ĪĪĪĪ╩╣ė├Ųõ╦¹ AI ╝ė╦┘Ų„▀Mąą╗ņ║ŽŠ½Č╚ė¢(x©┤n)ŠÜ

ĪĪĪĪIntel Habana Gaudi ╠Ä└ĒŲ„

ĪĪĪĪHabana Gaudi ╝ė╦┘Ų„ų¦│ų╗ņ║ŽŠ½Č╚ė¢(x©┤n)ŠÜĄ─ĘĮ╩Į┼c NVIDIA GPU ŅÉ╦Ų —— ═©▀^ę╗éĆĖĮ╝ė╣żŠ▀┼õ║Ž╔ŅČ╚īW(xu©”)┴Ģ(x©¬)┐“╝▄Ż¼╩╣ė├Ė±╩Į▐D(zhu©Żn)ōQ║═Ė▒▒Š▒Ż┤µ╣”─▄ĪŻ╚¶Žļ¾w“× Intel Habana Gaudi AI ╝ė╦┘Ų„Ą─╣”─▄Ż¼┐╔ęį═©▀^ AWS įŲĘ■äš(w©┤)Ų„åóäė Amazon EC2 DL1 īŹ└²Ż¼įōīŹ└²┼õéõ 8 éĆ Gaudi ╝ė╦┘Ų„ĪŻ

ĪĪĪĪAWS Tranium ąŠŲ¼

ĪĪĪĪAWS į┌ 2021 ─Ļ re:Invent ┤¾Ģ■╔Žą¹▓╝═Ų│÷ Tranium ąŠŲ¼Ż¼įōąŠŲ¼ė╔ AWS Ą─ Annapurna īŹ“×╩ęčą░l(f©Ī)Ż¼ė├ė┌ AI ╝ė╦┘ĪŻ─┐Ū░Ż¼Tranium ąŠŲ¼╔ą╬┤Ą├ĄĮ┤¾ęÄ(gu©®)─Żæ¬(y©®ng)ė├ĪŻAWS į┌┤¾Ģ■╔ŽĮķĮBĘQŻ¼Tranium īóų¦│ų FP16ĪóTF32ĪóBF16ĪóINT8Ż¼ęį╝░ę╗ĘNĘQ×ķ cFP8(Č©ųŲ 8 ╬╗ĖĪ³cöĄ(sh©┤))Ą─╚½ą┬Ė±╩ĮĪŻ

ĪĪĪĪ7

ĪĪĪĪAI ╝ė╦┘Ų„Ą─╬┤üĒ

ĪĪĪĪ╚ńĮ±Ż¼ML ╦Ńʩ蹊┐║═ė▓╝■įO(sh©©)ėŗČ╝į┌┼Ņ▓¬░l(f©Ī)š╣ĪŻAI ╝ė╦┘Ų„ę▓īóį┌ąį─▄║═─▄ą¦ĘĮ├µ│ų└m(x©┤)▀M▓ĮŻ¼ųØu┐╔ęįŽ±═©ė├╠Ä└ĒŲ„ę╗śė¤o┐p╩╣ė├ĪŻ

ĪĪĪĪ¼F(xi©żn)┤·Ą─ AI ╝ė╦┘Ų„ęčŠ▀éõ└ĒŽļųąĄ─ė▓╝■╣”─▄Ż¼└²╚ńų¦│ų INT1 ║═ INT4Ż¼▀@ā╔ĘNŠ½Č╚ŅÉą═╔ą╬┤▒╗ė├ė┌ė¢(x©┤n)ŠÜ║══Ų└ĒŻ¼Ą½╗“įS╦³éāĄ─┤µį┌┐╔ęį┤▀╔·ą┬Ą─ ML ╦ŃĘ©ĪŻAI ╝ė╦┘Ų„ų«ķgĄ─╗ź┬ō(li©ón)ę▓ØuęŖĖ’ą┬ĪŻ

ĪĪĪĪļSų°─Żą═ęÄ(gu©®)─ŻįĮüĒįĮ┤¾Ż¼╬ęéāąĶę¬Ė³┤¾Ą─ėŗ╦Ń╝»╚║Ż¼īóĖ³ČÓ AI ╝ė╦┘Ų„▀BĮėŲüĒŻ¼Å─Č°ų¦│ųĖ³┤¾Ą─╣żū„žō▌dĪŻ×ķ┤╦Ż¼NVIDIA ═Ų│÷┴╦Ė▀ĦīÆĄ─ NVLink ║═ NVSwitchŻ¼ė├ė┌ GPU ų«ķgĄ─╗ź┬ō(li©ón);Intel Ą─ Habana Gaudi ╠Ä└ĒŲ„ätį┌Ų¼╔Ž╝»│╔┴╦╗∙ė┌ęį╠½ŠW(w©Żng)Ą─ RoCE RDMAĪŻ╬┤üĒ AI æ¬(y©®ng)ė├īóĖ³╝ėÅVĘ║Ż¼ AI ╝ė╦┘Ų„ę▓īó│╔×ķ¼F(xi©żn)┤·ėŗ╦ŃŁh(hu©ón)Š│Ą─ųą┴„ĒŲų∙ĪŻ

ĪĪĪĪŽŻ═¹╬┤üĒĄ─ AI ╝ė╦┘Ų„ĦüĒĖ³║├Ą─ė├æ¶║═ķ_░l(f©Ī)š▀¾w“×ĪŻ╚ńĮ±Ą─«Éśŗ(g©░u)ėŗ╦Ń─Żą═ąĶę¬ģf(xi©”)š{(di©żo)ČÓéĆ CPU ║═ AI ╝ė╦┘Ų„Ż¼ī”┤¾▓┐ĘųöĄ(sh©┤)ō■(j©┤)┐ŲīW(xu©”)╝ę║═ķ_░l(f©Ī)╚╦åTČ°čįŻ¼šŲ╬š╦³éāĄ─┬ō(li©ón)ŠW(w©Żng)║═┤µā”įO(sh©©)ų├ļyČ╚ŅHĖ▀ĪŻ╩╣ė├ Amazon SageMaker Ą╚įŲ═ą╣▄Ę■äš(w©┤)┐╔╩Ī╚ź╣▄└Ē╗∙ĄA(ch©│)įO(sh©©)╩®Ą─┬ķ¤®Ż¼┐╔ęįĘĮ▒ŃĄžöU┤¾ÖCŲ„īW(xu©”)┴Ģ(x©¬)ęÄ(gu©®)─ŻŻ¼╚╗Č°Ż¼ķ_į┤┐“╝▄╚įŽŻ═¹ė├æ¶ī”Ąūīėė▓╝■ĪóŠ½Č╚ŅÉą═ĪóŠÄūgŲ„▀xō±║═┬ō(li©ón)ŠW(w©Żng)įŁšZĄ╚ėą▌^╔ŅĄ─┴╦ĮŌĪŻ

ĪĪĪĪ╬┤üĒŻ¼ķ_░l(f©Ī)╚╦åT┐╔ęįĄŪ╚ļ▀h│╠ IDEŻ¼╚╗║¾╩╣ė├ķ_į┤ ML ┐“╝▄▀\ąą┤·┤aŻ¼Č°▓╗▒ž┐╝æ]┤·┤aį┌║╬ĘNįO(sh©©)éõ╔Žęį║╬ĘNĘĮ╩Į▀\ąąĪŻ ╦¹éā╬©ę╗ąĶę¬╦╝┐╝Ą─ų╗╩Ū│╔▒Š║═╦┘Č╚ų«ķgĄ─ÖÓ(qu©ón)║Ō —— Žļ½@Ą├Ė▀╦┘Č╚Š═ČÓ╗©ÕXŻ¼Žļ╩ĪÕXŠ═į┌╦┘Č╚╔Ž═ūģf(xi©”)ĪŻ╬ę╩ŪéĆśĘė^Ą─╚╦Ż¼╬ęšJ×ķŠÓļx▀@śėĄ─╬┤üĒęčĮø(j©®ng)▓╗▀h┴╦ĪŻ

ĪĪĪĪ(▒Š╬─Įø(j©®ng)╩┌ÖÓ(qu©ón)║¾ŠÄūg░l(f©Ī)▓╝ĪŻįŁ╬─Ż║ https://towardsdatascience.com/ai-accelerators-machine-learning-algorithms-and-their-co-design-and-evolution-2676efd47179)

ĪĪĪĪŅ^łDį┤ūį brookhaven, Pixabay

ĪĪĪĪ╬─š┬ā╚(n©©i)╚▌āH╣®ķåūxŻ¼▓╗śŗ(g©░u)│╔═Č┘YĮ©ūhŻ¼šłųö╔„ī”┤²ĪŻ═Č┘Yš▀ō■(j©┤)┤╦▓┘ū„Ż¼’LļUūįō·ĪŻ

║Żł¾╔·│╔ųą...

║Ż╦ćAIĄ──Żą═ŽĄĮy(t©»ng)į┌ć°ļH╩ął÷╔ŽÅV╩▄║├įuŻ¼─┐Ū░šŠā╚(n©©i)└█ėŗ─Żą═öĄ(sh©┤)│¼▀^80╚féĆŻ¼║Ł╔wīæīŹĪóČ■┤╬į¬Īó▓Õ«ŗĪóįO(sh©©)ėŗĪóözė░Īó’LĖ±╗»łDŽ±Ą╚ČÓŅÉą═æ¬(y©®ng)ė├ł÷Š░Ż¼╗∙▒ŠĖ▓╔w╦∙ėąų„┴„äō(chu©żng)ū„’LĖ±ĪŻ

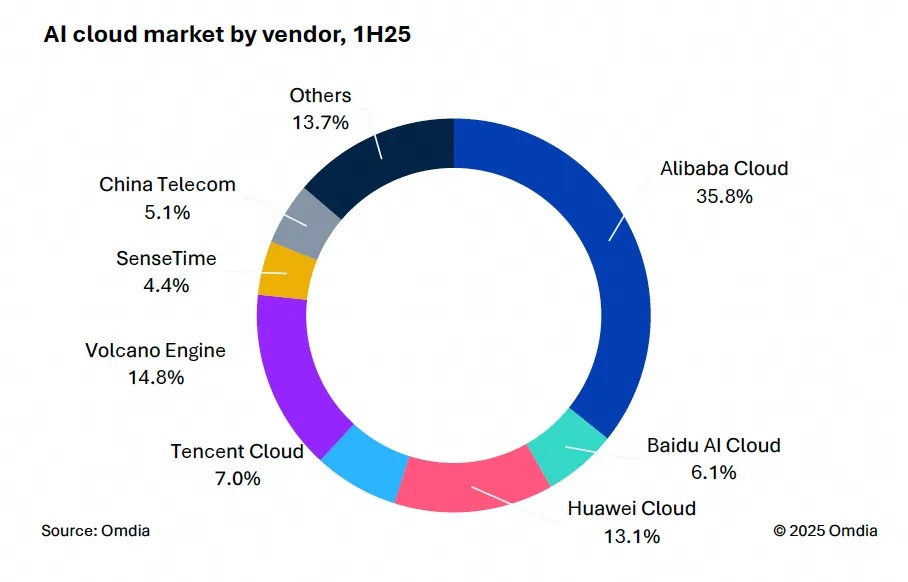

9į┬9╚šŻ¼ć°ļHÖÓ(qu©ón)═■╩ął÷š{(di©żo)čąÖCśŗ(g©░u)ėóĖ╗┬³(Omdia)░l(f©Ī)▓╝┴╦ĪČųąć°AIįŲ╩ął÷Ż¼1H25ĪĘł¾ĖµĪŻųąć°AIįŲ╩ął÷░ó└’įŲš╝▒╚8%╬╗┴ąĄ┌ę╗ĪŻ

9į┬24╚šŻ¼╚A×ķ└żņ`š┘ķ_Ī░ųŪ─▄¾w“ׯ¼ę╗Ų┴ĄĮ╬╗Ī▒╚A×ķIdeaHubŪ¦ąą░┘śI(y©©)¾w“×╣┘ėŗäØ░l(f©Ī)▓╝Ģ■ĪŻ

č┼±R╣■ū“╚šą¹▓╝═Ų│÷ā╔┐ŅŅ^┤„╩ĮČ·ÖCŻ¼Ęųäe╩ŪŲĮ░Õš±─żĄ─YH-4000║═äė╚”įŁ└ĒĄ─YH-C3000ĪŻ

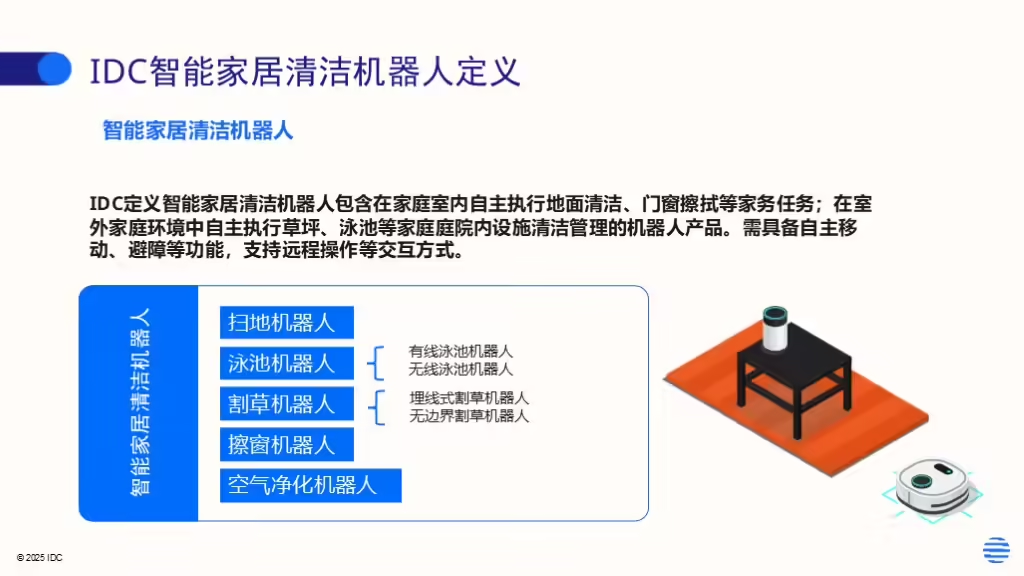

IDCĮ±╚š░l(f©Ī)▓╝Ą─ĪČ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖCŲ„╚╦įO(sh©©)éõ╩ął÷╝ŠČ╚Ė·█Öł¾ĖµŻ¼2025─ĻĄ┌Č■╝ŠČ╚ĪĘ’@╩ŠŻ¼╔Ž░ļ─Ļ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖCŲ„╚╦╩ął÷│÷žø1,2╚f┼_Ż¼═¼▒╚į÷ķL33%Ż¼’@╩Š│÷ŲĘŅÉÅŖä┼Ą─╩ął÷ąĶŪ¾ĪŻ