ĪĪĪĪū„š▀Ż³Sean Lie

ĪĪĪĪĘŁūgŻ³║·čÓŠ²Īó│╠║Ųį┤

ĪĪĪĪĮ³─ĻüĒŻ¼╔±ĮøŠWĮj─Żą═ęÄ─Ż│╩ųĖöĄ╝ēį÷ķLŻ¼Å─2018─ĻōĒėą│¼1ā|ģóöĄĄ─BertĄĮ2020─ĻōĒėą1750ā|éĆģóöĄGPT-3Ż¼Č╠Č╠ā╔─Ļ─Żą═Ą─ģóöĄ┴┐į÷╝ė┴╦3éĆöĄ┴┐╝ēŻ¼Č°Ūę▀@ĘNį÷ķL▀Ć┐┤▓╗ĄĮ▒MŅ^ĪŻ

ĪĪĪĪ╚╦éāäéäéķ_╩╝░lŠ“╔±ĮøŠWĮjĄ─æ¬ė├Øō┴”Ż¼Ą½é„ĮyĄ─ė¢ŠÜ║══Ų└ĒĘĮ╩Įęč╚╗¤oĘ©Ė·╔Ž╔±ĮøŠWĮjęÄ─ŻĄ─’w╦┘į÷ķL╦┘Č╚Ż¼¤oĘ©ØMūŃ┤¾ęÄ─ŻÖCŲ„īW┴Ģ╦∙ąĶĄ─ā╚┤µ║═╦Ń┴”ąĶŪ¾ĪŻ×ķ┤╦Ż¼ć°ā╚═ŌųTČÓäōśI╣½╦ŠīżŪ¾ī”▄øė▓╝■Ą╚▀MąąīŹ┘|ąįĄ─Ąūīė╝╝ągĖ’ą┬üĒĮŌøQ▀@ę╗╠¶æĪŻ

ĪĪĪĪū„×ķśIā╚éõ╩▄ĻPūóĄ─AI╝ė╦┘Ų„äōśI╣½╦ŠŻ¼│╔┴óė┌2016─ĻĄ─CerebrasŽŻ═¹═©▀^śŗĮ©╚½ą┬AI╝ė╦┘Ų„ĘĮ░ĖĮŌøQAIėŗ╦Ńå¢Ņ}Ż¼ęįīŹ¼FöĄ┴┐╝ēėŗ╦Ńąį─▄Ż║╩ūŽ╚Ż¼ąĶę¬Ė─▀Mėŗ╦Ń║╦ą─╝▄śŗŻ¼Č°▓╗ų╗╩Ūę╗╬ČĄž╠ß╔²├┐├ļĖĪ³c▀\╦Ń┤╬öĄŻ╗Ųõ┤╬Ż¼ąĶę¬ęį│¼įĮ─”Ā¢Č©┬╔Ą─╦┘Č╚╠ßĖ▀ąŠŲ¼╝»│╔Č╚Ż╗ūŅ║¾Ż¼▀Ćę¬║å╗»╝»╚║▀BĮėŻ¼┤¾Ę∙Č╚╠ß╔²╝»╚║ėŗ╦Ńą¦┬╩ĪŻ

ĪĪĪĪ×ķ┴╦īŹ¼F╔Ž╩÷─┐ś╦Ż¼CerebrasįOėŗ┴╦ę╗ĘNą┬Ą─ėŗ╦Ń║╦ą─╝▄śŗĪŻ╦³ūīå╬┼_įOéõ▀\ąą│¼┤¾ęÄ─Ż─Żą═│╔×ķ┐╔─▄Ż¼┤╦═ŌŻ¼╦³ķ_░l│÷ų╗ąĶ║åå╬öĄō■▓󹹥─ÖMŽ“öUš╣║═▒ŠĄžĘŪĮYśŗ╗»ŽĪ╩Ķ╝ė╦┘╝╝ągŻ¼╩╣┤¾─Żą═Ą─æ¬ė├ķTÖæ┤¾Ę∙ĮĄĄ═ĪŻ

ĪĪĪĪ2021─ĻŻ¼Cerebrasį°═Ų│÷╚½Ū“ūŅ┤¾AIąŠŲ¼Wafer Scale Engine 2(WSE-2)Ż¼├µĘe╩Ū46225ŲĮĘĮ║┴├ūŻ¼▓╔ė├7nm╣ż╦ćŻ¼ōĒėą2.6╚fā|éĆŠ¦¾w╣▄║═85╚féĆAIā×╗»║╦Ż¼▀Ć═Ų│÷┴╦╩└Įń╔ŽĄ┌ę╗éĆ╚╦ŅÉ┤¾─XęÄ─ŻĄ─AIĮŌøQĘĮ░ĖCS-2 AIėŗ╦ŃÖCŻ¼┐╔ų¦│ų│¼▀^120╚fā|ģóöĄęÄ─ŻĄ─ė¢ŠÜĪŻĮ±─Ļ6į┬Ż¼╦³ėųį┌╗∙ė┌å╬éĆWSE-2ąŠŲ¼Ą─CS-2ŽĄĮy╔Žė¢ŠÜ┴╦╩└Įń╔ŽūŅ┤¾Ą─ōĒėą200ā|ģóöĄĄ─NLP─Żą═Ż¼’@ų°ĮĄĄ═┴╦įŁ▒ŠąĶę¬öĄŪ¦éĆGPUė¢ŠÜĄ─│╔▒ŠĪŻ

ĪĪĪĪį┌Į³Ų┌┼e▐kĄ─Hot Chips┤¾Ģ■╔ŽŻ¼Cerebras┬ō║Žäō╩╝╚╦&╩ūŽ»ė▓╝■╝▄śŗĤSean Lie╔Ņ╚ļĮķĮB┴╦Cerebrasė▓╝■Ż¼š╣╩Š┴╦╦¹éāį┌║╦ą─╝▄śŗĪó┐vŽ“öUš╣║═ÖMŽ“öUš╣ĘĮ├µĄ─äōą┬ĘĮĘ©ĪŻęįŽ┬╩Ū╦¹Ą─č▌ųvā╚╚▌Ż¼ė╔OneFlow╔ńģ^ŠÄūgĪŻ

ĪĪĪĪ1

ĪĪĪĪCerebrasėŗ╦Ń║╦ą─╝▄śŗ

ĪĪĪĪėŗ╦Ń║╦ą─(compute core)╩Ū╦∙ėąėŗ╦ŃÖC╝▄śŗĄ─“ą─┼K”Ż¼Č°Cerebrasßśī”╔±ĮøŠWĮjĄ─╝Ü┴ŻČ╚äėæBŽĪ╩Ķąįųžą┬įOėŗ┴╦ėŗ╦Ń║╦ą─ĪŻ

ĪĪĪĪłD2╩Ūę╗┐ŅąĪą═║╦ą─Ż¼╦³ų╗ėą38,000ŲĮĘĮ╬ó├ūŻ¼Ųõųąę╗░ļĄ─╣Ķ├µĘeė├ė┌48 KBā╚┤µŻ¼┴Ēę╗░ļ╩Ū║¼110,000éĆś╦£╩å╬į¬(cell)Ą─ėŗ╦Ń▀ē▌ŗĪŻš¹éĆėŗ╦Ń║╦ą─ęį1.1 GHzĄ─ĢrńŖŅl┬╩Ė▀ą¦▀\ąąŻ¼Č°ĘÕųĄ╣”┬╩ų╗ėą30║┴═▀ĪŻ

ĪĪĪĪŽ╚Å─ā╚┤µšfŲĪŻGPUĄ╚é„Įy╝▄śŗ╩╣ė├╣▓ŽĒųąčļDRAMŻ¼Ą½DRAM┤µ╚Ī╦┘Č╚▌^┬²Ż¼╬╗ų├ę▓▌^▀hĪŻ╝┤▒Ń╩╣ė├ųąĮķīė(interposer)║═HBMĄ╚╝ŌČ╦╝╝ągŻ¼Ųõā╚┤µÄ¦īÆę▓▀hĄ═ė┌║╦ą─öĄō■═©┬ĘĦīÆĪŻ└²╚ńŻ¼öĄō■═©┬ĘĦīÆ═©│Ż╩Ūā╚┤µÄ¦īÆĄ─100▒ČĪŻ

ĪĪĪĪ▀@ęŌ╬Čų°├┐ę╗éĆüĒūįā╚┤µĄ─▓┘ū„öĄ(operand)ų┴╔┘ę¬į┌öĄō■═©┬Ęųą▒╗╩╣ė├100┤╬Ż¼▓┼─▄īŹ¼FĖ▀└¹ė├┬╩ĪŻę¬ū÷ĄĮ▀@ę╗³cŻ¼é„ĮyĄ─ĘĮĘ©╩Ū═©▀^▒ŠĄžŠÅ┤µ║═▒ŠĄž╝─┤µŲ„īŹ¼FöĄō■Å═ė├ĪŻ

ĪĪĪĪ╚╗Č°Ż¼ėąę╗ĘNĘĮĘ©┐╔ęįūīöĄō■═©┬ĘęįśOų┬ąį─▄└¹ė├ā╚┤µÄ¦īÆŻ¼Š═╩Ūīóā╚┤µ═Ļ╚½Ęų▓╝į┌ę¬╩╣ė├ā╚┤µĄ─å╬į¬┼į▀ģĪŻ▀@śėę╗üĒŻ¼ā╚┤µÄ¦īÆŠ═Ą╚ė┌║╦ą─öĄō■═©┬ĘĄ─▓┘ū„öĄÄ¦īÆĪŻ

ĪĪĪĪ▀@╩Ūę╗éĆ║åå╬Ą─╬’└ĒįŁ└ĒŻ║īó▒╚╠žöĄō■Å─▒ŠĄžā╚┤µęŲäėĄĮöĄō■═©┬ĘŻ¼ųąķgų╗ėąÄū╩«╬ó├ūĄ─ŠÓļxŻ¼ŽÓ▒╚īó╦³═©▀^öĄō■░³ęŲäėĄĮ═Ō▓┐įOéõę¬╚▌ęūĄ├ČÓĪŻ

ĪĪĪĪłD3š╣╩Š┴╦Cerebrasėŗ╦Ń║╦ą─Ą─ā╚┤µįOėŗŻ¼├┐éĆ║╦ą─┼õėą48 KB▒ŠĄžSRAMŻ¼8éĆ32╬╗īÆĄ─å╬Č╦┐┌bank╩╣ŲõŠ▀éõĖ▀├▄Č╚Ż¼═¼Ģr┐╔▒ŻūC│õĘų░lō]śOų┬ąį─▄Ż¼▀@ĘN╝ēäeĄ─bank┐╔╠ß╣®│¼│÷öĄō■═©┬Ę╦∙ąĶĄ─ā╚┤µÄ¦īÆĪŻ

ĪĪĪĪę“┤╦Ż¼╬ęéā┐╔ęįÅ─ā╚┤µųą╠ß╣®śOų┬öĄō■═©┬Ęąį─▄Ż¼ę▓Š═╩Ū├┐éĆ裣hų╗ąĶ2éĆ64╬╗ūx╚ĪŻ¼ę╗éĆ64╬╗īæ╚ļŻ¼ę“┤╦╦³┐╔ęį▒ŻūCöĄō■═©┬Ę│õĘų░lō]ąį─▄ĪŻųĄĄ├ūóęŌĄ─╩ŪŻ¼├┐éĆ║╦ą─Ą─ā╚┤µŽÓ╗ź¬Ü┴óŻ¼ø]ėąé„ĮyęŌ┴x╔ŽĄ─╣▓ŽĒā╚┤µĪŻ

ĪĪĪĪ│²┴╦Ė▀ąį─▄Ą─SRAMęį═ŌŻ¼Cerebrasėŗ╦Ń║╦ą─▀ĆŠ▀éõę╗éĆ256ūų╣ØĄ─▄ø╝■╣▄└ĒŠÅ┤µŻ¼╣®ŅlĘ▒įLå¢Ą─öĄō■ĮYśŗ╩╣ė├Ż¼╚ń└█╝ėŲ„Ą╚ĪŻįōŠÅ┤µļxöĄō■═©┬ĘĘŪ│ŻŠo£ÉŻ¼╦∙ęįŽ¹║─Ą─╣”┬╩śOĄ═ĪŻ╔Ž╩÷Ęų▓╝╩Įā╚┤µ╝▄śŗįņŠ═┴╦¾@╚╦Ą─ā╚┤µÄ¦īÆŻ¼ŽÓ«öė┌═¼Ą╚├µĘeGPUā╚┤µÄ¦īÆĄ─200▒ČĪŻ

ĪĪĪĪ2

ĪĪĪĪ╦∙ėąBLAS╝ēäeĄ─śOų┬ąį─▄

ĪĪĪĪėą┴╦śO┤¾Ą─ā╚┤µÄ¦īÆŻ¼Š═┐╔ęįīŹ¼FįSČÓū┐įĮĄ─╣”─▄ĪŻ▒╚╚ńŻ¼┐╔ęį│õĘų░lō]╦∙ėąBLAS╝ēäe(╗∙ĄAŠĆąį┤·öĄ│╠ą“╝»Ż¼BLAS levels)Ą─śOų┬ąį─▄ĪŻé„ĮyĄ─CPU║═GPU╝▄śŗĄ─Ų¼╔Žā╚┤µÄ¦īÆėąŽ▐Ż¼ę“┤╦ų╗─▄īŹ¼FGEMM(═©ė├ŠžĻć│╦Ę©)Ą─śOų┬ąį─▄Ż¼╝┤ŠžĻć-ŠžĻćŽÓ│╦ĪŻ

ĪĪĪĪÅ─łD4┐╔ęŖŻ¼į┌Ą═ė┌ŠžĻć-ŠžĻćŽÓ│╦Ą─╚╬║╬BLAS╝ēäeČ╝ąĶę¬▒╚ā╚┤µÄ¦īÆĄ─┤¾Ę∙į÷╝ėŻ¼▀@ę╗³cé„Įy╝▄śŗ¤oĘ©ØMūŃĪŻ

ĪĪĪĪĄ½ėą┴╦ūŃē“Ą─ā╚┤µÄ¦īÆ║¾Ż¼Š═┐╔ęįūīGEMV(ŠžĻć-Ž“┴┐ŽÓ│╦)ĪóDOT(Ž“┴┐-Ž“┴┐ŽÓ│╦)║═AXPY(Ž“┴┐-ś╦┴┐ŽÓ│╦)Š∙īŹ¼FśOų┬ąį─▄ĪŻĖ▀ā╚┤µÄ¦īÆį┌╔±ĮøŠWĮjėŗ╦Ńųąė╚×ķųžę¬Ż¼ę“×ķ▀@┐╔ęįīŹ¼FĘŪĮYśŗ╗»ŽĪ╩ĶĄ─│õĘų╝ė╦┘ĪŻę╗éĆŽĪ╩ĶGEMM▓┘ū„┐╔┐┤ū„╩ŪČÓéĆAXPY▓┘ū„Ą─║Ž╝»(ī”├┐éĆĘŪ┴Ńį¬╦žł╠ąąę╗┤╬▓┘ū„)ĪŻ

ĪĪĪĪCerebrasėŗ╦Ń║╦ą─Ą─╗∙ĄA╩Ūę╗éĆ═Ļ╚½┐╔ŠÄ│╠Ą─╠Ä└ĒŲ„Ż¼ęį▀mæ¬▓╗öÓūā╗»Ą─╔ŅČ╚īW┴ĢąĶŪ¾ĪŻ┼c═©ė├╠Ä└ĒŲ„ę╗śėŻ¼Cerebras║╦ą─╠Ä└ĒŲ„ų¦│ų╦ŃągĪó▀ē▌ŗĪó╝ė▌d/ā”┤µĪó▒╚▌^(compare)ĪóĘųų¦Ą╚ČÓĘNųĖ┴ŅĪŻ▀@ą®ųĖ┴Ņ║═öĄō■ę╗śėā”┤µį┌├┐éĆ║╦ą─Ą─48 KB▒ŠĄžā╚┤µųąŻ¼▀@ęŌ╬Čų°║╦ą─ų«ķgŽÓ╗ź¬Ü┴óŻ¼ę▓ęŌ╬Čų°š¹éĆąŠŲ¼┐╔ęį▀Mąą╝Ü┴ŻČ╚äėæBėŗ╦ŃĪŻ═©ė├ųĖ┴Ņį┌16éĆ═©ė├╝─┤µŲ„╔Ž▀\ąąŻ¼Ųõ▀\ąąį┌Šo£ÉĄ─6╝ē┴„╦«ŠĆųąĪŻ

ĪĪĪĪ│²┤╦ų«═ŌŻ¼Cerebras║╦ą─▀Ćį┌ė▓╝■īė├µų¦│ų╦∙ėąėąĻPöĄō■╠Ä└ĒĄ─Åł┴┐ųĖ┴ŅĪŻ▀@ą®Åł┴┐╦Ńūėį┌64-╬╗öĄō■═©┬Ęųął╠ąąŻ¼öĄō■═©┬Ęė╔4éĆFP16 FMAC(╚┌║Ž│╦Ęe└█╝ė▀\╦Ń)å╬į¬ĮM│╔ĪŻ

ĪĪĪĪ×ķ┴╦╠ß╔²ąį─▄┼cņ`╗ŅąįŻ¼CerebrasĄ─ųĖ┴Ņ╝»╝▄śŗ(ISA)īóÅł┴┐ęĢ×ķ┼c═©ė├╝─┤µŲ„║═ā╚┤µę╗śėĄ─ę╗Ą╚▓┘ū„öĄ(first-class operand)ĪŻ╔ŽłDĄ╚╩Į1╩Ūę╗éĆFMACųĖ┴ŅĄ─└²ūėŻ¼╦³īó3D║═2DÅł┴┐ęĢ×ķ▓┘ū„öĄų▒Įė▀\ąąĪŻ

ĪĪĪĪų«╦∙ęį┐╔ęįū÷ĄĮ▀@ę╗³cŻ¼╩Ūę“×ķCerebras║╦ą─╩╣ė├öĄō■ĮYśŗ╝─┤µŲ„(DSR)ū„×ķųĖ┴ŅĄ─▓┘ū„öĄĪŻCerebras║╦ą─ėą44éĆDSRŻ¼├┐éĆDSR░³║¼ę╗éĆ├Ķ╩÷Ę¹Ż¼└’├µėąųĖßśųĖŽ“Åł┴┐╝░ŲõķLČ╚Īóą╬ĀŅĪó┤¾ąĪĄ╚ą┼ŽóĪŻ

ĪĪĪĪėą┴╦DSR║¾Ż¼Cerebras║╦ą─Ą─ė▓╝■╝▄śŗĖ³ņ`╗ŅŻ¼╝┤┐╔ęįį┌ā╚┤µųąų¦│ųā╚┤µųąĄ─4DÅł┴┐Ż¼ę▓┐╔ų¦│ų┐ŚśŗÅł┴┐(fabric streaming tensors)ĪóFIFO(Ž╚▀MŽ╚│÷╦ŃĘ©)║═Łhą╬ŠÅø_Ų„ĪŻ┤╦═ŌŻ¼Cerebras║╦ą─▀Ć┼õėąė▓╝■ĀŅæBÖCüĒ╣▄└Ēš¹éĆÅł┴┐į┌öĄō■═©┬ĘųąĄ─┴„äė┤╬ą“ĪŻ

ĪĪĪĪ3

ĪĪĪĪ╝Ü┴ŻČ╚öĄō■┴„š{Č╚

ĪĪĪĪ│²┴╦Ė─▀MÅł┴┐æ¬ė├Ż¼Cerebras║╦ą─▀Ć┐╔ł╠ąą╝Ü┴ŻČ╚öĄō■┴„š{Č╚ĪŻ╚ńłD5╦∙╩ŠŻ¼╦∙ėąėŗ╦ŃČ╝ė╔öĄō■ė|░lĪŻFabricų▒Įėį┌ė▓╝■ųąé„▌ööĄō■║═ĻP┬ō┐ž╝■Ż¼ę╗Ą®║╦ą─Įė╩šöĄō■Ż¼Š═ķ_╩╝▓ķšę▀\ąąųĖ┴ŅŻ¼▓ķšę╣żū„═Ļ╚½╗∙ė┌Įė╩šĄĮĄ─öĄō■ĪŻ▀@ę╗öĄō■┴„ÖCųŲ╩╣š¹éĆėŗ╦ŃĮYśŗūā│╔ę╗éĆöĄō■┴„ę²ŪµŻ¼┐╔ęįų¦│ųŽĪ╩Ķ╝ė╦┘——ę“×ķ╦³ų╗╠Ä└ĒĘŪ┴ŃöĄō■ĪŻ░l╦═Ų„Ģ■▀^×V╦∙ėą┴ŃųĄŻ¼ę“┤╦Įė╩šŲ„ų╗Ģ■Įė╩šĄĮĘŪ┴ŃųĄŻ¼Č°╦∙ėąėŗ╦ŃČ╝ė╔ĘŪ┴ŃöĄō■ė|░lĪŻ

ĪĪĪĪ▀@śėū÷▓╗Ą½┐╔ęį╣Ø╩Ī╣”┬╩Ż¼▀Ć┐╔ęį╩Ī┬į▓╗▒žę¬Ą─ėŗ╦ŃŻ¼╝ė┐ņ▀\╦Ńą¦┬╩ĪŻ▓┘ū„ė╔å╬éĆöĄō■į¬╦žė|░lŻ¼╩╣Ą├Cerebras║╦ą─┐╔ęįų¦│ų│¼╝Ü┴ŻČ╚Īó═Ļ╚½ĘŪĮYśŗ╗»Ą─ŽĪ╩ĶąįŻ¼═¼Ģr▓╗Ģ■įņ│╔ąį─▄ōp╩¦ĪŻė╔ė┌öĄō■┴„Š▀ėąäėæBąįŻ¼╦∙ęįCerebras║╦ą─▀Ćų¦│ų8éĆÅł┴┐▓┘ū„═¼Ģr▀\ąąŻ¼╬ęéāĘQų«×ķ“╬óŠĆ│╠(micro-threads)”ĪŻ

ĪĪĪĪ╬óŠĆ│╠ų«ķgŽÓ╗ź¬Ü┴óŻ¼├┐┤╬裣hĢrė▓╝■┐╔į┌ŲõķgŪąōQĪŻš{Č╚Ų„│ų└m×ķ╦∙ėą┤²╠Ä└ĒÅł┴┐▒O┐ž▌ö╚ļ║═▌ö│÷╩Ūʱ┐╔ė├Ż¼▀ĆŠ▀ėąā׎╚╠Ä└ĒÖCųŲŻ¼▒ŻūCĻPµI╚╬䚥├ĄĮā׎╚╠Ä└ĒĪŻ«ö▓╗═¼╚╬äšķgĄ─ŪąōQ«a╔·┤¾┴┐äėæBąą×ķĢrŻ¼╬óŠĆ│╠┐╔ęį╠ß╔²└¹ė├┬╩Ż¼Ę±ät▀@ą®äėæBąą×ķ┐╔─▄Ģ■ī¦ų┬┴„╦«ŠĆ│÷¼FÜŌ┼▌ĪŻ

ĪĪĪĪ╔Ž╩÷╝Ü┴ŻČ╚ĪóäėæBĪóąĪą═║╦ą─╝▄śŗĄ╚╠ž³c╩╣╬ęéāĄ─╝▄śŗŠ▀éõŪ░╦∙╬┤ėąĄ─Ė▀ąį─▄Ż¼ŲõĘŪĮYśŗ╗»ŽĪ╩Ķėŗ╦ŃĄ─└¹ė├┬╩╩ŪGPUĄ─ų┴╔┘10▒ČĪŻ┐╔ęŖŻ¼═©▀^ī”ėŗ╦Ń║╦ą─╝▄śŗĄ─Ė─▀MŻ¼Cerebras┐╔īóąį─▄▀MąąöĄ┴┐╝ē╠ß╔²ĪŻ

ĪĪĪĪ4

ĪĪĪĪ┐vŽ“öUš╣Ż║│¼įĮ─”Ā¢Č©┬╔

ĪĪĪĪę¬┐vŽ“öUš╣ąŠŲ¼Ż¼é„ĮyĄ─ĘĮĘ©Č╝╩ŪÅ─ąŠŲ¼ųŲįņĘĮ├µ╚ļ╩ųŻ¼╝┤╠ß╔²ąŠŲ¼╝»│╔Č╚ĪŻ▀^╚źöĄ╩«─ĻŻ¼ąŠŲ¼ąąśIĄ─░lš╣Č╝Ę¹║Ž─”Ā¢Č©┬╔Ż¼ąŠŲ¼╝»│╔Č╚įĮüĒįĮĖ▀ĪŻ╚ńĮ±Ż¼─”Ā¢Č©┬╔▀Ćį┌čė└mŻ¼Ą½╦³Ą─į÷┴┐▓╗ē“┤¾Ż¼├┐ę╗┤·ųŲ│╠ų╗─▄īó╝»│╔Č╚╠ß╔²╝sā╔▒ČŻ¼▓╗ūŃęįØMūŃ╔±ĮøŠWĮjĄ─ėŗ╦ŃąĶŪ¾ĪŻ╦∙ęįŻ¼CerebrasŽŻ═¹┐╔ęį│¼įĮ─”Ā¢Č©┬╔Ż¼īŹ¼FöĄ┴┐╝ēĄ─ąį─▄╠ß╔²ĪŻ

ĪĪĪĪ×ķ┤╦Ż¼╬ęéāćLįć▀^é„ĮyĄ─ĘĮĘ©——öU┤¾ąŠŲ¼├µĘeŻ¼▓óį┌▀@ĘĮ├µū÷ĄĮ┴╦śOų┬Ż¼│╔╣¹Š═╩ŪWSE-2(Wafer-Scale EngineŻ¼Š¦łA╝ēę²Ūµ)ĪŻ╚ńĮ±Ż¼WSE-2Ą─æ¬ė├ęčĘŪ│ŻÅVĘ║ĪŻ╦³╩Ū╚½╩└ĮńūŅ┤¾Ą─ąŠŲ¼Ż¼│▀┤ń│¼▀^46,000ŲĮĘĮ║┴├ūŻ¼╩Ū─┐Ū░ūŅ┤¾Ą─CPUĄ─56▒ČĪŻå╬ēKWSE-2ėą2.6╚fā|éĆŠ¦¾w╣▄Ż¼║╦ą─öĄ▀_850,000éĆĪŻ²ŗ┤¾Ą─ąŠŲ¼├µĘe┐╔ęįīŹ¼FśO┤¾Ą─Ų¼╔Žā╚┤µ║═śOĖ▀Ą─ąį─▄ĪŻ

ĪĪĪĪ×ķ┴╦ūī│▀┤ń¾@╚╦Ą─WSE-2ę▓─▄į┌ś╦£╩Ą─öĄō■ųąą─ŁhŠ│ųą╩╣ė├Ż¼╬ęéā▀Ćßśī”ąįĄžįOėŗ┴╦Cerebras CS-2ŽĄĮyŻ¼ū÷ĄĮ┴╦ė├å╬ēKąŠŲ¼īŹ¼F╝»╚║╝ēėŗ╦ŃĪŻ

ĪĪĪĪęįŽ┬╩Ū╬ęéāÅ─ąĪą═║╦ą─śŗĮ©┤¾ą═Š¦łA╝ēę²ŪµĄ─▀^│╠Ż║╩ūŽ╚Ż¼╬ęéāį┌š¹Ų¼ų▒ÅĮ╝s300║┴├ūĄ─Š¦łA╔Žū÷│÷ę╗éĆéĆé„ĮyŠ¦┴Ż(Die)Ż¼├┐éĆŠ¦┴Ż║¼ėą╝s10,000éĆ║╦ą─;╚╗║¾Ż¼▓╗═¼ė┌ęį═∙Ą─╩ŪŻ¼╬ęéā▓╗īóå╬éĆŠ¦┴ŻŪąĖŅ│÷üĒū÷│╔é„ĮyąŠŲ¼Ż¼Č°╩Ūį┌š¹Ų¼Š¦łAā╚ŪąĖŅ│÷ę╗éĆ▀ģķL215║┴├ūĄ─ĘĮēKŻ¼ĘĮēK░³║¼84éĆŠ¦┴ŻŻ¼╣▓ėą850,000éĆėŗ╦Ń║╦ą─(łD6)ĪŻ

ĪĪĪĪīŹ¼F▀@śėĄ─│¼┤¾ąŠŲ¼│▀┤ńŻ¼ļx▓╗ķ_Ąūīė╝▄śŗĄ─┼õ║ŽŻ¼Ąūīė╝▄śŗ▒žĒÜ─▄╩╣öĄō■į┌š¹Ų¼Š¦łA╔ŽĖ▀ą¦ĪóĖ▀ąį─▄Ąžé„▌ö(łD7)ĪŻCerebrasĄ─ąŠŲ¼ĮYśŗ╩╣ė├2DŠWĖ±═žōõŻ¼▀@ĘNĮYśŗĘŪ│Ż▀m║ŽöUš╣Ż¼Č°Ūęų╗ąĶŽ¹║─śOĄ═Ą─ķ_õNĪŻ

ĪĪĪĪŠWĖ±═žōõīó╦∙ėą║╦ą─▀BĮėŲüĒŻ¼├┐éĆ║╦ą─į┌ŠWĀŅ═žōõųąėąę╗éĆĮYśŗ┬Ęė╔Ų„(fabric router)ĪŻĮYśŗ┬Ęė╔Ų„ėą5éĆČ╦┐┌Ż¼4éĆĘĮŽ“Ė„ėą1éĆŻ¼▀Ćėąę╗éĆČ╦┐┌├µŽ“║╦ą─ūį╔ĒŻ¼Ė„éĆČ╦┐┌Č╝ėą32╬╗Ą─ļpŽ“Įė┐┌ĪŻČ╦┐┌öĄ┴┐▌^╔┘Ą─║├╠Ä╩Ū┐╔ęįīó╣سcķgčėĢr▒Ż│ųį┌ę╗éĆĢrńŖų▄Ų┌ęįā╚Ż¼Å─Č°īŹ¼FĄ═│╔▒ŠĪó¤oōp┴„┐ž║═ĘŪ│ŻĄ═Ą─ŠÅø_ĪŻ

ĪĪĪĪąŠŲ¼ųąĄ─╗∙▒ŠöĄō■░³╩Ūßśī”╔±ĮøŠWĮjā×╗»║¾Ą─å╬éĆFP16öĄō■į¬╦žŻ¼┼cų«░ķļSĄ─╩Ū16╬╗Ą─┐žųŲą┼ŽóŻ¼╦³éā╣▓═¼ĮM│╔32╬╗Ą─│¼╝Ü┴ŻČ╚öĄō■░³ĪŻ

ĪĪĪĪ×ķ┴╦▀Mę╗▓Įā×╗»ąŠŲ¼ĮYśŗŻ¼╬ęéā╩╣ė├┴╦ņoæB┬Ęė╔(static routing)Ż¼ą¦┬╩Ė▀Ż¼ķ_õNĄ═Ż¼Č°Ūę┐╔ęį│õĘų└¹ė├╔±ĮøŠWĮjĄ─ņoæB▀BĮėĪŻ×ķ┴╦ūī═¼ę╗╬’└Ē▀BĮė╔Ž┐╔ęįėąČÓŚl┬Ęė╔Ż¼╬ęéā╠ß╣®24ŚlŽÓ╗ź¬Ü┴óĄ─ņoæB┬Ęė╔ęį╣®┼õų├Ż¼┬Ęė╔ų«ķg¤oūĶ╚¹Ż¼ŪęČ╝┐╔ęį═©▀^ĢrĘųÅ═ė├(time-multiplexing)╝╝ągį┌═¼ę╗╬’└Ē▀BĮė╔Žé„▌öĪŻ

ĪĪĪĪūŅ║¾Ż¼ė╔ė┌╔±ĮøŠWĮjé„▌öąĶę¬Ė▀╔╚│÷(fan-out)Ż¼ę“┤╦CerebrasąŠŲ¼Ą─├┐éĆĮYśŗ┬Ęė╔Ų„Č╝Š▀ėą▒ŠĄžÅV▓ź(native broadcast)║═ČÓ▓ź(multi-cast)─▄┴”ĪŻ

ĪĪĪĪėą┴╦╔Ž╩÷╗∙ĄA║¾Ż¼╬ęéāŠ═┐╔ęį▀MąąöUš╣ĪŻį┌å╬éĆŠ¦┴Żā╚▀MąąöUš╣▒╚▌^║åå╬Ż¼Ą½¼Fį┌ąĶę¬īóŠ¦┴Ż┼cŠ¦┴Ż▀BĮėŲüĒĪŻ×ķ┴╦┐ńįĮŠ¦┴Żķg▓╗ĄĮę╗║┴├ūīÆĄ─äØŲ¼▓█(scribe line)Ż¼╬ęéā╩╣ė├┴╦┼_ĘeļŖ╣ż╦ćųąĄ─Ė▀╝ēĮī┘īėĪŻ

ĪĪĪĪ╬ęéāīóėŗ╦Ń║╦ą─öUš╣×ķ2DŠWĖ±ėŗ╦ŃĮYśŗŻ¼╚╗║¾ėųį┌š¹éĆŠ¦łA╔Žą╬│╔┴╦═Ļ╚½═¼┘|Ą─ėŗ╦Ń║╦ą─Ļć┴ąĪŻŠ¦┴Ż-Š¦┴ŻĮė┐┌╩Ūę╗ĘNĖ▀ą¦Ą─į┤═¼▓Į▓óąąĮė┐┌Ż¼Ą½╩ŪŻ¼į┌╚ń┤╦┤¾Ą─Š¦łAęÄ─Ż╔ŽŻ¼┐é╣▓ėą│¼▀^ę╗░┘╚fŚlŠĆ┬ĘŻ¼╦∙ęį╬ęéāĄ─Ąūīėģfūh▒žĒÜ▓╔ė├╚▀ėÓČ╚įOėŗĪŻ╬ęéā═©▀^ė¢ŠÜ║═ūįäėąŻš²ĀŅæBÖCüĒū÷ĄĮ▀@ę╗³cĪŻėą┴╦▀@ą®Įė┐┌Ż¼╝┤╩╣į┌ųŲįņ▀^│╠ųą┤µį┌Ķ”┤├Ż¼š¹éĆŠ¦łAĄ─ĮYśŗę▓─▄ū÷ĄĮ═Ļ╚½Š∙┘|ĮYśŗ(uniform fabric)ĪŻ

ĪĪĪĪąŠŲ¼╔Ž┐┤╦Ų║åå╬Ą─Č╠ŠĆŲõīŹ╩«Ęųųžę¬Ż¼╦³éāį┌╣Ķ╔ŽĄ─ŠÓļx▓╗ĄĮę╗║┴├ūĪŻ▀@ĘNŠĆ┬ĘįOėŗ┼cé„ĮyĄ─SERDESĘĮĘ©║▄▓╗ę╗śėĪŻ┼cŪ░├µ╠ߥĮĄ─Ą─ā╚┤µįOėŗŽÓ═¼Ż¼Č╠ŠĆįOėŗ╩Ū│÷ė┌║åå╬Ą─╬’└ĒįŁ└ĒŻ║į┌ąŠŲ¼╔Žīó▒╚╠žöĄō■é„▌ö▓╗ĄĮ1║┴├ūĄ─ŠÓļxŻ¼▒╚═©▀^ĘŌčb▀BĮėŲ„ĪóPCB╗“š▀ŠĆ└|é„▌öČ╝Ė³╚▌ęūĪŻ

ĪĪĪĪ┼cé„ĮyIOŽÓ▒╚Ż¼▀@ĘNĘĮʩĦüĒ┴╦öĄ┴┐╝ēĄ─Ė─▀MĪŻÅ─łD8öĄō■┐╔┐┤│÷Ż¼WSE-2├┐å╬╬╗├µĘeĄ─ĦīÆ▒╚GPUČÓ│÷╝sę╗éĆöĄ┴┐╝ēŻ¼▓óŪę├┐▒╚╠žĄ─╣”┬╩ą¦┬╩╠ßĖ▀┴╦Į³ā╔éĆöĄ┴┐╝ēĪŻ▀@ą®Č╝▒Ē├„š¹éĆŠ¦łAĮYśŗŠ▀éõ┴╦Ū░╦∙╬┤ėąĄ─Ė▀ąį─▄ĪŻ

ĪĪĪĪ╚ń╣¹▐D╗»×ķ═¼Ą╚Ą─GPU├µĘeŻ¼WSE-2Ą─ĦīÆ╩ŪGPUĄ─7▒ČŻ¼Č°╣”┬╩āH╝s5═▀ĪŻš²╩Ū▀@ĘN╝ēäeĄ─╚½ŠųĮYśŗąį─▄Ż¼╩╣Š¦łA─▄ē“ū„×ķå╬éĆąŠŲ¼▀\ąąĪŻėą┴╦╚ń┤╦ÅŖ┤¾Ą─å╬ąŠŲ¼Ż¼╬ęéāŠ═┐╔ęįĮŌøQę╗ą®śOŠ▀╠¶æąįĄ─å¢Ņ}ĪŻ

ĪĪĪĪ5

ĪĪĪĪ═©▀^ÖÓųž┴„╩Į╝╝ągų¦│ų│¼┤¾─Żą═

ĪĪĪĪłD9Ż║═©▀^ÖÓųž┴„╩Į(Weight Streaming)╝╝ąg┐╔į┌å╬éĆąŠŲ¼╔Žų¦│ų╦∙ėą─Żą═┤¾ąĪĪŻ

ĪĪĪĪĖ▀ąį─▄Ą─ąŠŲ¼ĮYśŗ┐╔ęįūī╬ęéāį┌å╬éĆąŠŲ¼╔Ž▀\ąą┤¾ą═╔±ĮøŠWĮjĪŻWSE-2Š▀ėąūŃē“Ė▀Ą─ąį─▄║═╚▌┴┐üĒ▀\ąą╚ńĮ±ūŅ┤¾Ą──Żą═Ż¼Ūę¤oąĶĘųģ^╗“Å═ļsĄ─Ęų▓╝╩Į╠Ä└ĒŻ¼▀@╩Ū═©▀^ĘųĮŌ╔±ĮøŠWĮj─Żą═ĪóÖÓųž║═ėŗ╦ŃüĒ═Ļ│╔Ą─ĪŻ

ĪĪĪĪ╬ęéāīó╦∙ėą─Żą═ÖÓųž┤µā”į┌├¹×ķMemoryXĄ─═Ō▓┐įOéõųąŻ¼▓óīó▀@ą®ÖÓųž┴„╩Įé„▌öĄĮCS-2ŽĄĮyĪŻÖÓųžĢ■į┌╔±ĮøŠWĮjĖ„īėĄ─ėŗ╦Ńųąė├ĄĮŻ¼Č°Ūęę╗┤╬ų╗ėŗ╦Ńę╗īėĪŻÖÓųž▓╗Ģ■┤µā”į┌CS-2ŽĄĮy╔ŽŻ¼──┼┬╩ŪĢ║Ģrā”┤µĪŻCS-2Įė╩šĄĮÖÓųž║¾Ż¼╩╣ė├║╦ą─ųąĄ─ĄūīėöĄō■┴„ÖCųŲł╠ąąėŗ╦Ń(łD9)ĪŻ

ĪĪĪĪ├┐éĆå╬¬ÜĄ─ÖÓųžČ╝Ģ■ū„×ķå╬¬ÜĄ─AXPY▓┘ū„ė|░lėŗ╦ŃĪŻ═Ļ│╔ėŗ╦Ń║¾Ż¼įōÖÓųžŠ═Ģ■▒╗üGŚēŻ¼ė▓╝■īó└^└m╠Ä└ĒŽ┬ę╗éĆį¬╦žĪŻė╔ė┌ąŠŲ¼▓╗ąĶę¬ā”┤µÖÓųžŻ¼╦∙ęįąŠŲ¼Ą─ā╚┤µ╚▌┴┐▓╗Ģ■ė░ĒæąŠŲ¼┐╔╠Ä└ĒĄ──Żą═┤¾ąĪĪŻį┌Ę┤Ž“é„▓źųąŻ¼╠▌Č╚ęįŽÓĘ┤Ą─ĘĮŽ“┴„╗žĄĮMemoryXå╬į¬Ż¼╚╗║¾MemoryXå╬į¬▀MąąÖÓųžĖ³ą┬ĪŻ

ĪĪĪĪłD10 ═Ļš¹Ą─Š¦łA╩ŪMatMulĻć┴ąŻ¼┐╔ų¦│ų│¼┤¾ŠžĻćĪŻ

ĪĪĪĪęįŽ┬╩ŪąŠŲ¼ųął╠ąąėŗ╦ŃĄ─Š▀¾wĘĮĘ©ĪŻ╔±ĮøŠWĮjĖ„īėĄ─ėŗ╦Ń┐╔ÜwĮY×ķŠžĻć│╦Ę©Ż¼ė╔ė┌CS-2Ą─ęÄ─Ż▌^┤¾Ż¼╬ęéā─▄ē“ī󊦳AĄ─85╚féĆ║╦ą─ė├ū„å╬éĆŠ▐ą═ŠžĻć│╦Ę©Ų„ĪŻ

ĪĪĪĪ╦³╩Ū▀@śė╣żū„Ą─Ż║ī”ė┌Ž±GPT▀@śėĄ─Transformer─Żą═Ż¼╝ż╗ŅÅł┴┐Š▀ėą╚²éĆ▀ē▌ŗŠSČ╚Ż║┼·┤╬(B)Īóą“┴ą(S)║═ļ[▓ž(H)ŠSČ╚Ż¼╬ęéāīó▀@ą®Åł┴┐ŠSČ╚▓ĘųĄĮŠ¦łA╔ŽĄ─Č■ŠS║╦ą─ŠWĖ±╔ŽĪŻļ[▓žŠSČ╚į┌ąŠŲ¼ĮYśŗĄ─xĘĮŽ“╔ŽäØĘų(split)Ż¼Č°┼·┤╬║═ą“┴ąŠSČ╚į┌yĘĮŽ“╔ŽäØĘųĪŻ▀@śė┐╔ęįīŹ¼FĖ▀ą¦Ą─ÖÓųžÅV▓źęį╝░ą“┴ą║═ļ[▓žŠSČ╚Ą─Ė▀ą¦Üw╝sĪŻ

ĪĪĪĪ╝ż╗Ņ║»öĄ┤µā”į┌žōž¤ł╠ąąėŗ╦Ń╣żū„Ą─║╦ą─╔ŽŻ¼Ž┬ę╗▓Į╩Ūė|░l▀@ą®╝ż╗Ņ║»öĄĄ─ėŗ╦ŃŻ¼▀@╩Ū═©▀^╩╣ė├Ų¼╔ŽÅV▓źĮYśŗüĒ═Ļ│╔Ą─ĪŻ╬ęéā╩╣ė├Ų¼╔ŽÅV▓źĮYśŗüĒŽ“├┐ę╗┴ą░l╦═ÖÓųžĪóöĄō■║═├³┴ŅĄ─ĘĮĘ©ĪŻ

ĪĪĪĪ«ö╚╗Ż¼į┌ė▓╝■öĄō■┴„ÖCųŲŽ┬Ż¼ÖÓųžĢ■ų▒Įėė|░lFMAC▓┘ū„ĪŻ▀@ą®╩ŪAXPY▓┘ū„ĪŻė╔ė┌ÅV▓ź░l╔·į┌┴ą╔ŽŻ¼ę“┤╦░³║¼ŽÓ═¼╠žš„ūė╝»Ą─╦∙ėą║╦ą─Įė╩šŽÓ═¼Ą─ÖÓųžĪŻ┤╦═ŌŻ¼╬ęéā░l╦═├³┴ŅüĒė|░lŲõ╦¹ėŗ╦ŃŻ¼└²╚ńÜw╝s╗“ĘŪŠĆąį▓┘ū„ĪŻ

ĪĪĪĪ┼eéĆ└²ūėŻ¼╬ęéā╩ūŽ╚į┌š¹éĆŠ¦łA╔ŽÅV▓źÖÓųžąą(łD11)ĪŻ├┐ąąĄ─├┐éĆį¬╦žČ╝╩Ūś╦┴┐Ż¼«ö╚╗Ż¼į┌å╬ąąųąŻ¼ėąČÓéĆÖÓųžė│╔õĄĮå╬éĆ┴ą╔ŽŻ¼«ö┤µį┌ŽĪ╩ĶąįĢrŻ¼ų╗ėąĘŪ┴ŃÖÓųž▓┼Ģ■▒╗ÅV▓źĄĮ┴ąŻ¼ė|░lFMACėŗ╦ŃĪŻ╬ęéā╠°▀^╦∙ėąĄ─┴ŃÖÓųžŻ¼▓ó▌ö╚ļŽ┬ę╗éĆĘŪ┴ŃÖÓųžŻ¼▀@Š═╩Ū«a╔·ŽĪ╩Ķ╝ė╦┘Ą─įŁę“ĪŻ

ĪĪĪĪ╚ń╣¹╬ęéā¼Fį┌Ę┼┤¾ę╗éĆ║╦ą─Ż¼┐╔ęį┐┤ĄĮ║╦ą─╝▄śŗ╩Ū╚ń║╬▀Mąą┤╦▓┘ū„(łD12)ĪŻį┌öĄō■┴„ÖCųŲŽ┬Ż¼ÖÓųžĄų▀_║¾Ż¼Š═Ģ■ė|░l║╦ą─╔ŽĄ─FMACėŗ╦ŃĪŻÖÓųžųĄ┼c├┐éĆ╝ż╗Ņ║»öĄ▌ö│÷ŽÓ│╦Ż¼╚╗║¾└█╝ėĄĮ▄ø╝■╣▄└ĒŠÅ┤µųąĄ─▒ŠĄž└█╝ėŲ„ųąĪŻFMACėŗ╦Ń╩╣ė├Åł┴┐ųĖ┴Ņł╠ąąŻ¼īó╝ż╗Ņ║»öĄ▌ö│÷ęĢ×ķÅł┴┐▓┘ū„öĄĪŻ╔Ž╩÷ėŗ╦ŃČ╝▓╗Ģ■ī”║╦ą─įņ│╔Ņ~═Ōķ_õNĪŻ

ĪĪĪĪ┤╦═ŌŻ¼ÖÓųžę▓▓╗Ģ■«a╔·ā╚┤µķ_õNŻ¼ę“×ķę╗Ą®ėŗ╦Ń═Ļ│╔Ż¼║╦ą─Š═Ģ■▐DČ°ėŗ╦ŃŽ┬ę╗éĆÖÓųžŻ¼▓╗ąĶę¬┤µā”╚╬║╬ÖÓųžĪŻ╚¶š¹ąą║╦ą─Č╝Įė╩šĄĮÖÓųžŻ¼├┐éĆ║╦ą─Š═Č╝Ģ■«a╔·ę╗éĆpartial sumŻ¼╚╗║¾įōąą║╦ą─Ą─╦∙ėąpartial sumīó▀MąąÜw╝sĪŻ

ĪĪĪĪÜw╝sėŗ╦Ńė╔▒╗ÅV▓źĄĮ├┐┴ą╦∙ėą║╦ą─Ą─├³┴Ņ░³ė|░lĪŻ═¼śėŻ¼į┌öĄō■┴„š{Č╚ÖCųŲŽ┬Ż¼ę╗Ą®║╦ą─Įė╩šĄĮ├³┴Ņ░³Ż¼╦³Š═Ģ■ė|░lpartial sumÜw╝sėŗ╦ŃĪŻīŹļHĄ─Üw╝sėŗ╦Ń▒Š╔Ē╩Ū╩╣ė├║╦ą─Ą─Åł┴┐ųĖ┴Ņ═Ļ│╔Ż¼╩╣ė├Ą─╩ŪĮYśŗÅł┴┐▓┘ū„öĄĪŻ╦∙ėą┴ąČ╝Įė╩šę╗éĆPSUM├³┴ŅĪŻĄ½╩ŪŲõųąę╗┴ąĢ■╩šĄĮę╗éĆ╠ž╩ŌĄ─FSUM├³┴ŅŻ¼╦³ę¬Ū¾ā╚║╦┤µā”final sumĪŻ▀@śėū÷╩Ū×ķ┴╦╩╣ė├┼c▌ö╚ļ╠žš„ŽÓ═¼Ą─Ęų▓╝üĒ┤µā”▌ö│÷╠žš„Ż¼Å─Č°×ķŽ┬ę╗īėėŗ╦Ńū÷║├£╩éõĪŻ

ĪĪĪĪ╩šĄĮ├³┴Ņ║¾Ż¼║╦ą─╩╣ė├ĮYśŗ╔ŽĄ─Łhą╬─Ż╩Į▀Mąą═©ą┼Ż¼įō─Ż╩Į╩╣ė├ĮYśŗņoæB┬Ęė╔įOų├ĪŻ╩╣ė├╬óŠĆ│╠Ż¼╦∙ėąÜw╝sČ╝┼cŽ┬ę╗éĆÖÓųžąąĄ─FMACėŗ╦Ńųž»BŻ¼įōĘNFMACėŗ╦Ń▓óąąķ_╩╝ĪŻ«ö╦∙ėąĄ─ÖÓųžąąČ╝╠Ä└Ē═Ļ«ģŻ¼═Ļš¹Ą─GEMM▓┘ū„Š══Ļ│╔┴╦Ż¼═¼Ģr╦∙ėąĄ─╝ż╗Ņ║»öĄ▌ö│÷Č╝ęč═ĻéõŻ¼┐╔ęį▀MąąŽ┬ę╗īėėŗ╦ŃĪŻ

ĪĪĪĪ╔Ž╩÷įOėŗ─▄ūīĖ„ĘNęÄ─ŻĄ─╔±ĮøŠWĮjČ╝┐╔ęįį┌å╬éĆąŠŲ¼╔ŽĖ▀ąį─▄▀\ąąĪŻ¬Ü╠žĄ─║╦ą─ā╚┤µ║═ąŠŲ¼╝▄śŗ╩╣ąŠŲ¼┐╔ęį¤oąĶĘųēK╗“Ęųģ^╝┤┐╔ų¦│ų│¼┤¾ŠžĻćŻ¼╝┤╩╣╩ŪŠ▀ėąČÓ▀_100,000 x 100,000 MatMulīėĄ─│¼┤¾─Żą═ę▓┐╔ęįį┌▓╗▓ĘųŠžĻćĄ─ŪķørŽ┬▀\ąąĪŻ

ĪĪĪĪ╚¶╩╣ė├å╬éĆWSE-2ąŠŲ¼▀\ąą┤╦─Żą═Ż¼FP16ŽĪ╩Ķąį─▄┐╔▀_75 PetaFLOPS(╚¶ŽĪ╩ĶąįĖ³Ė▀Ż¼ąį─▄▀Ć┐╔Ė³Ė▀)Ż¼FP16├▄╝»ąį─▄┐╔▀_7.5 PetaFLOPSĪŻ▀@Š═╩Ū╬ęéāæ¬ī”ÖCŲ„īW┴Ģė▓╝■╠¶æĄ─Ą┌Č■éĆĘĮ├µŻ¼═©▀^öUš╣▀Mę╗▓ĮĦüĒę╗éĆöĄ┴┐╝ēĄ─ąį─▄╠ß╔²ĪŻ

ĪĪĪĪ6

ĪĪĪĪÖMŽ“öUš╣Ż║×ķ╩▓├┤▀@├┤ļy

ĪĪĪĪūŅ║¾ę╗éĆĘĮ├µŻ║╝»╚║ÖMŽ“öUš╣ĪŻ╚ńĮ±ęčĮø┤µį┌╝»╚║ĮŌøQĘĮ░ĖŻ¼Ą½×ķ╩▓├┤ÖMŽ“öUš╣╚į╚╗╚ń┤╦└¦ļy?

ĪĪĪĪūī╬ęéā┐┤┐┤¼FėąĄ─ÖMŽ“öUš╣╝╝ąg(łD13)ĪŻūŅ│ŻęŖĄ─╩ŪöĄō■▓󹹯¼▀@ę▓╩ŪūŅ║åå╬Ą─ĘĮĘ©Ż¼Ą½╦³▓╗▀mė├ė┌┤¾ą═─Żą═Ż¼ę“×ķ╦³ę¬Ū¾├┐éĆįOéõČ╝ėąūŃē“Ą─╚▌┴┐╚▌╝{š¹éĆ─Żą═ĪŻ

ĪĪĪĪ×ķ┴╦ĮŌøQ▀@éĆå¢Ņ}Ż¼│ŻęŖĄ─ĘĮĘ©╩Ū▓╔ė├─Żą═▓󹹯¼╝┤äØĘų─Żą═Ż¼ęį┴„╦«ŠĆĘĮ╩Įė├▓╗═¼Ą─įOéõ▀\ąą─Żą═Ą─▓╗═¼īėĪŻĄ½ļSų°┴„╦«ŠĆūāķLŻ¼╝ż╗ŅųĄā╚┤µ(activation memory)ęįČ■┤╬ĘĮĄ─╦┘Č╚į÷ķLĪŻ

ĪĪĪĪ×ķ┴╦▒▄├Ō▀@ĘNŪķørŻ¼┴Ēę╗ĘN│ŻęŖĄ──Żą═▓óąąĘĮĘ©╩Ū┐ńįOéõäØĘųīėŻ¼Ą½▀@Ģ■įņ│╔║▄┤¾Ą─═©ą┼ķ_õNŻ¼Č°ŪęäØĘųå╬éĆīėĘŪ│ŻÅ═ļsĪŻ

ĪĪĪĪė╔ė┌╔Ž╩÷ĘNĘNŽ▐ųŲŻ¼Į±╠ņ╚įø]ėąę╗ĘN╚f─▄Ą─ĘĮ╩ĮüĒīŹ¼FÖMŽ“öUš╣ĪŻį┌┤¾ČÓöĄŪķørŽ┬Ż¼ė¢ŠÜ║Ż┴┐─Żą═ąĶę¬öĄō■▓óąą║═─Żą═▓óąą╗ņ║ŽĄ─ĘĮĘ©ĪŻ¼F┤µĄ─ÖMŽ“öUš╣ĮŌøQĘĮ░Ė╚įėąįSČÓ▓╗ūŃŻ¼Ė∙▒ŠįŁę“║▄║åå╬Ż║į┌é„ĮyĄ─ÖMŽ“öUš╣ųąŻ¼ā╚┤µ║═ėŗ╦Ń╩ŪŠo├▄┬ōŽĄĄ─Ż¼╚ń╣¹į┌öĄŪ¦┼_įOéõ╔Ž▀\ąąå╬éĆ─Żą═Ż¼öUš╣ā╚┤µ║═ėŗ╦ŃŠ═ūā│╔ŽÓ╗źę└┘ćĄ─Ęų▓╝╩Į╝s╩°å¢Ņ}ĪŻ

ĪĪĪĪ▀@ĘNÅ═ļsąįī¦ų┬Ą─ĮY╣¹╩ŪŻ║łD14’@╩Š┴╦▀^╚źÄū─Ļį┌GPU╔Žė¢ŠÜĄ─ūŅ┤¾─Żą═╝░Ųõ╩╣ė├Ą─▓╗═¼▓óąąĘĮĘ©ĪŻÅ─ųą┐╔ęŖŻ¼įĮ┤¾Ą──Żą═ąĶꬥ─▓óąąŅÉą═ę▓įĮČÓŻ¼į÷╝ė┴╦Å═ļsąįĪŻ

ĪĪĪĪ└²╚ńŻ¼Åł┴┐─Żą═Ą─▓óąą╝ēäe╩╝ĮKŽ▐ųŲ×ķ8Ż¼ę“×ķį┌å╬éĆĘ■äšŲ„ųą═©│Żų╗ėą8éĆGPUĪŻę“┤╦Ż¼┤¾ą═─Żą═┤¾ČÓ▓╔ė├┴„╦«╩Į─Żą═▓󹹯¼▀@╩ŪūŅÅ═ļsĄ─ĘĮĘ©Ż¼įŁę“Š═╩Ūų«Ū░╠ߥĮĄ─ā╚┤µå¢Ņ}ĪŻį┌GPU╝»╚║╔Žė¢ŠÜ─Żą═ąĶę¬ĮŌøQ▀@ą®Ęų▓╝╩ĮŽĄĮyå¢Ņ}ĪŻ▀@ĘNÅ═ļsąįī¦ų┬ąĶę¬Ė³ķLĄ─ķ_░lĢrķgŻ¼▓óŪę═∙═∙¤oĘ©īŹ¼FūŅ╝čöUš╣ĪŻ

ĪĪĪĪ7

ĪĪĪĪCerebras╝▄śŗ╩╣öUš╣ūāĄ├╚▌ęū

ĪĪĪĪCerebras╝▄śŗ─▄ē“į┌å╬éĆąŠŲ¼╔Ž▀\ąą╦∙ėą─Żą═Ż¼¤oąĶ─Żą═ĘųĖŅŻ¼ę“┤╦öUš╣ūāĄ├║åå╬Č°ūį╚╗Ż¼┐╔ęįāH═©▀^öĄō■▓óąą▀MąąöUš╣Ż¼▓╗ąĶę¬╚╬║╬Å═ļsĄ──Żą═▓óąąĘųĖŅĪŻ

ĪĪĪĪ╬ęéā×ķöĄō■▓óąąīŻķTįOėŗ┴╦SwarmX(łD15)╗ź┬ō╝╝ągĪŻ╦³╬╗ė┌ā”┤µÖÓųžĄ─MemoryXå╬į¬║═ė├ė┌ėŗ╦ŃĄ─CS-2ŽĄĮyų«ķgŻ¼Ą½ėų¬Ü┴óė┌ā╔š▀ĪŻ

ĪĪĪĪSwarmXŽ“╦∙ėąCS-2ŽĄĮyÅV▓źÖÓųžŻ¼▓ó£p╔┘╦∙ėąCS-2Ą─╠▌Č╚Ż¼╦³▓╗āHāH╩Ūę╗éĆ╗ź┬ōŻ¼Ė³╩Ūė¢ŠÜ▀^│╠ųąĄ─ę╗éĆ╗Ņ▄SĮM╝■Ż¼īŻ×ķöĄō■▓óąąÖMŽ“öUš╣Č°śŗĮ©ĪŻ

ĪĪĪĪį┌ā╚▓┐Ż¼SwarmX╩╣ė├śõą╬═žōõüĒīŹ¼F─ŻēK╗»║═Ą═ķ_õNöUš╣Ż¼ę“×ķ╦³╩Ū─ŻēK╗»║═┐╔ĘųĮŌĄ─Ż¼╦∙ęįöUš╣ĄĮ╚╬ęŌöĄ┴┐Ą─Š▀ėą┼cå╬éĆŽĄĮyŽÓ═¼Ą─ł╠ąą─Żą═Ą─CS-2ŽĄĮyĪŻę¬öUš╣ĄĮĖ³ČÓėŗ╦ŃŻ¼ų╗ąĶį┌SwarmX═žōõųą╠Ē╝ėĖ³ČÓ╣سc║═Ė³ČÓCS-2ŽĄĮyĪŻ▀@Š═╩Ū╬ęéāæ¬ī”ÖCŲ„īW┴Ģė▓╝■ąĶŪ¾Ą─ūŅ║¾ę╗éĆĘĮ├µŻ║Ė─▀M▓ó┤¾┤¾║å╗»ÖMŽ“öUš╣ĪŻ

ĪĪĪĪ8

ĪĪĪĪ┐éĮY

ĪĪĪĪį┌▀^╚źĄ─Äū─Ļ└’Ż¼ÖCŲ„īW┴Ģ╣żū„žō▌dĄ─ąĶŪ¾į÷╝ė┴╦╚²éĆöĄ┴┐╝ēęį╔ŽŻ¼Č°Ūęø]ėąĘ┼ŠÅĄ─█EŽ¾ĪŻŅAėŗÄū─Ļ║¾īóį÷ķLĄĮłD16Ą─╝²Ņ^╬╗ų├Ż¼╬ęéāå¢ūį╝║Ż¼┐╔ęįØMūŃ▀@ĘNąĶŪ¾åß?

ĪĪĪĪCerebrasŽÓą┼Ż¼╬ęéā┐╔ęįŻ¼Ą½▓╗╩Ū═©▀^é„Įy╝╝ągū÷ĄĮ▀@ę╗³cŻ¼Č°╩Ū═©▀^ĘŪĮYśŗ╗»ŽĪ╩Ķ╝ė╦┘Ī󊦳A╝ēąŠŲ¼║═╝»╚║ÖMŽ“öUš╣Ą─ĮY║Žīóąį─▄╠ß╔²╚²éĆöĄ┴┐╝ēĪŻ╔±ĮøŠWĮj─Żą═ęÄ─Żę└╚╗│╩ųĖöĄ╝ēį÷ķLŻ¼┐╔ęį╩╣ė├▀@ą®┤¾─Żą═Ą─╣½╦Š║▄╔┘Ż¼Č°Ūę╬┤üĒų╗Ģ■Ė³╔┘ĪŻ

ĪĪĪĪ╚╗Č°Ż¼Cerebras╝▄śŗų¦│ųė├å╬éĆįOéõ▀\ąą│¼┤¾─Żą═Ż¼═¼Ģrų¦│ųų╗ąĶöĄō■▓󹹥─ÖMŽ“öUš╣Ż¼ęį╝░▒ŠĄžĘŪĮYśŗ╗»ŽĪ╩Ķ╝ė╦┘Ż¼īóūīĖ³ČÓ╚╦Č╝─▄╩╣ė├┤¾─Żą═ĪŻ

ĪĪĪĪ╬─š┬ā╚╚▌āH╣®ķåūxŻ¼▓╗śŗ│╔═Č┘YĮ©ūhŻ¼šłųö╔„ī”┤²ĪŻ═Č┘Yš▀ō■┤╦▓┘ū„Ż¼’LļUūįō·ĪŻ

║Żł¾╔·│╔ųą...

║Ż╦ćAIĄ──Żą═ŽĄĮyį┌ć°ļH╩ął÷╔ŽÅV╩▄║├įuŻ¼─┐Ū░šŠā╚└█ėŗ─Żą═öĄ│¼▀^80╚féĆŻ¼║Ł╔wīæīŹĪóČ■┤╬į¬Īó▓Õ«ŗĪóįOėŗĪóözė░Īó’LĖ±╗»łDŽ±Ą╚ČÓŅÉą═æ¬ė├ł÷Š░Ż¼╗∙▒ŠĖ▓╔w╦∙ėąų„┴„äōū„’LĖ±ĪŻ

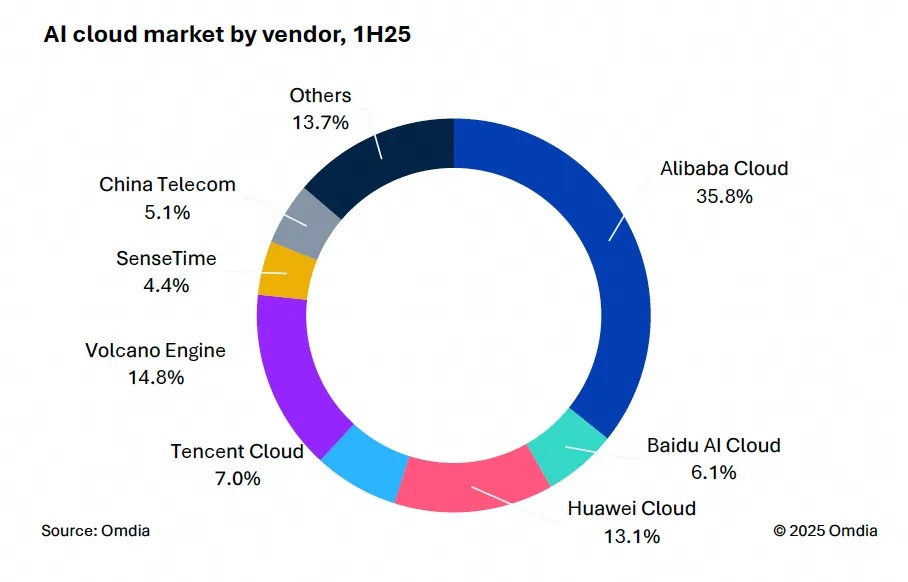

9į┬9╚šŻ¼ć°ļHÖÓ═■╩ął÷š{čąÖCśŗėóĖ╗┬³(Omdia)░l▓╝┴╦ĪČųąć°AIįŲ╩ął÷Ż¼1H25ĪĘł¾ĖµĪŻųąć°AIįŲ╩ął÷░ó└’įŲš╝▒╚8%╬╗┴ąĄ┌ę╗ĪŻ

9į┬24╚šŻ¼╚A×ķ└żņ`š┘ķ_Ī░ųŪ─▄¾w“ׯ¼ę╗Ų┴ĄĮ╬╗Ī▒╚A×ķIdeaHubŪ¦ąą░┘śI¾w“×╣┘ėŗäØ░l▓╝Ģ■ĪŻ

č┼±R╣■ū“╚šą¹▓╝═Ų│÷ā╔┐ŅŅ^┤„╩ĮČ·ÖCŻ¼Ęųäe╩ŪŲĮ░Õš±─żĄ─YH-4000║═äė╚”įŁ└ĒĄ─YH-C3000ĪŻ

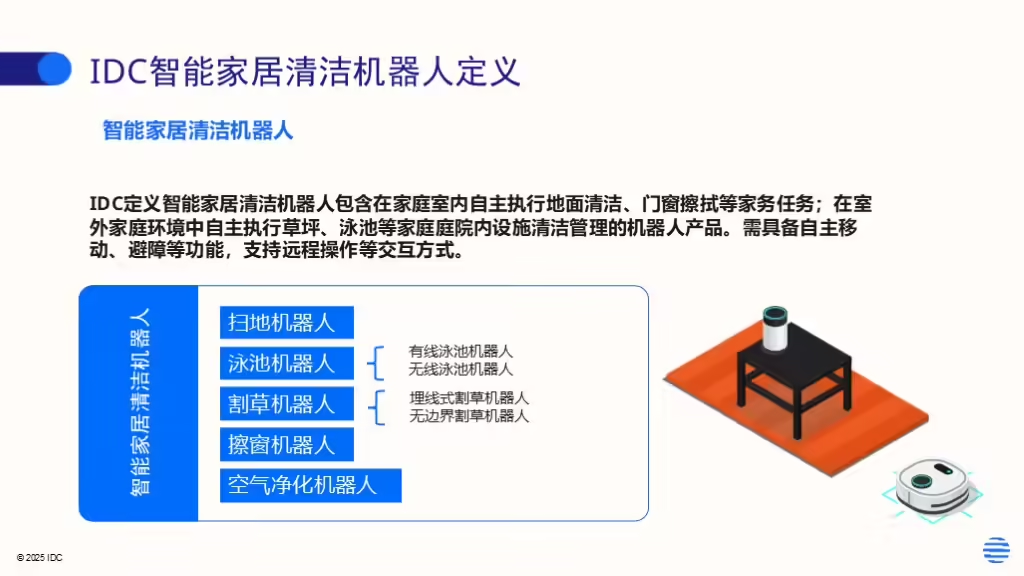

IDCĮ±╚š░l▓╝Ą─ĪČ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖCŲ„╚╦įOéõ╩ął÷╝ŠČ╚Ė·█Öł¾ĖµŻ¼2025─ĻĄ┌Č■╝ŠČ╚ĪĘ’@╩ŠŻ¼╔Ž░ļ─Ļ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖCŲ„╚╦╩ął÷│÷žø1,2╚f┼_Ż¼═¼▒╚į÷ķL33%Ż¼’@╩Š│÷ŲĘŅÉÅŖä┼Ą─╩ął÷ąĶŪ¾ĪŻ