ĪĪĪĪ1į┬29╚š Ž¹Žó:SliceGPT╩Ū╬ó▄øķ_░l(f©Ī)Ą─ę╗ĘNą┬ą═Ą─┤¾šZčį─Żą═ē║┐sĘĮĘ©ĪŻ═©▀^SLICE GPTŻ¼┐╔ęįį┌▒Ż│ų99%Ż¼99%Ż¼║═90%┴Ńśė▒Š╚╬äšąį─▄Ą─═¼ĢrŻ¼īóLLAMA2-70BĪóOPT66B║═Phi-2─Żą═Ęųäe╚ź│²Ė▀▀_25%Ą──Żą═ģóöĄ(sh©┤)(░³└©ŪČ╚ļ)ĪŻ

ĪĪĪĪ▀@ęŌ╬Čų°╩╣ė├SLICE GPTĄ──Żą═┐╔ęįį┌Ė³╔┘Ą─GPU╔Ž▀\ąąŻ¼▓óŪę▀\ąą╦┘Č╚Ė³┐ņŻ¼¤oąĶ╚╬║╬Ņ~═ŌĄ─┤·┤aā×(y©Łu)╗»ĪŻį┌24GBĄ─Ž¹┘M╝ēGPU╔ŽŻ¼īóLLAMA2-70BĄ─┐éėŗ╦Ń┴┐£p╔┘ĄĮ├▄╝»─Żą═Ą─64%;į┌40GBĄ─A100GPU╔Ž£p╔┘ĄĮ66%ĪŻ

ĪĪĪĪSLICE GPTĄ─ų„ę¬╠ž³c░³└©ĮŌøQ┴╦┤¾šZčį─Żą═į┌┤µā”║═ėŗ╦Ń┘Yį┤╔ŽĄ─Ė▀ąĶŪ¾å¢Ņ}Ż¼▓ó╠ß╣®┴╦ę╗ĘNėąą¦£p▌p▀@ą®┘Yį┤ąĶŪ¾Ą─ĘĮĘ©Ż¼═¼Ģr▒Ż│ų╗“āH▌p╬óĀ▐╔³─Żą═ąį─▄Ż¼▀@ī”ė┌═ŲÅV┤¾ą═─Żą═Ą─æ¬ė├║═ĮĄĄ═▀\ąą│╔▒ŠŠ▀ėąųžę¬ęŌ┴xĪŻ

ĪĪĪĪŠ▀¾wüĒšfŻ¼SLICE GPT─▄ē“£p╔┘┤¾ą═šZčį─Żą═Ą─│▀┤ńŻ¼═©▀^į┌▓╗ōp╩¦’@ų°ąį─▄Ą─Ū░╠ߎ┬Ż¼£p╔┘─Żą═ģóöĄ(sh©┤)öĄ(sh©┤)┴┐Ż¼SLICE GPT─▄ē“£p╔┘┤¾ą═šZčį─Żą═Ą─│▀┤ńĪŻ╦³▀Ć─▄╠ßĖ▀─Żą═į┌ė▓╝■╔ŽĄ─▀\ąąą¦┬╩Ż¼£p╔┘┴╦╦∙ąĶĄ─ėŗ╦Ń┘Yį┤Ż¼▓óŪę─▄ē“į┌╚ź│²ę╗Č©▒╚└²Ą──Żą═ģóöĄ(sh©┤)Ą─═¼ĢrŻ¼▒Ż│ų─Żą═Ą─ąį─▄ĪŻ┤╦═ŌŻ¼SLICE GPT▓╗āH▀mė├ė┌╠žČ©Ą──Żą═╗“╝▄śŗŻ¼╦³Ą─ĘĮĘ©┐╔ęįÅVĘ║æ¬ė├ė┌Ė„ĘNūāōQŲ„ŠW(w©Żng)Įj─Żą═ĪŻ

ĪĪĪĪSLICE GPTĄ─╣żū„įŁ└Ē╗∙ė┌ę╗ĘNą┬Ą─║¾ė¢ŠÜŽĪ╩Ķ╗»ĘĮ░ĖŻ¼═©▀^ā╔éĆĻPµI▓Į¾EüĒ£p╔┘┤¾ą═šZčį─Żą═Ą─ėŗ╦Ń║═ā╚(n©©i)┤µąĶŪ¾ĪŻ╩ūŽ╚╩Ū╠µōQÖÓųžŠžĻćŻ¼═©▀^īó─Żą═ųąĄ─├┐éĆÖÓųžŠžĻć╠µōQ×ķę╗éĆĖ³ąĪĄ─(├▄╝»Ą─)ŠžĻćüĒ£p╔┘ŠW(w©Żng)ĮjĄ─ŪČ╚ļŠSČ╚Ż¼ėąą¦Ąž┐s£p┴╦─Żą═Ą─┤¾ąĪĪŻ

ĪĪĪĪŲõ┤╬╩ŪŠS│ųėŗ╦Ń▓╗ūāąįŻ¼SLICE GPTę²╚ļ┴╦ūāōQŲ„ŠW(w©Żng)ĮjųąĄ─“ėŗ╦Ń▓╗ūāąį”Ė┼─ŅŻ¼═©▀^╠žČ©Ą─ūāōQ▓┘ū„Ż¼Ė─ūāÖÓųžŠžĻćĄ─ą╬ĀŅŻ¼Č°▓╗Ė─ūāŲõį┌─Żą═ųąĄ─╣”─▄║═ė░ĒæŻ¼Å─Č°▀_ĄĮ£p╔┘─Żą═ģóöĄ(sh©┤)Ą──┐Ą─Ż¼═¼Ģr▒Ż│ų─Żą═Ą─ąį─▄ĪŻ▀@ĘNĘĮĘ©Ą─║╦ą─ā×(y©Łu)ä▌į┌ė┌Ż¼╦³į╩įS─Żą═į┌╚ź│²ę╗Č©▒╚└²Ą─ģóöĄ(sh©┤)║¾Ż¼╚į╚╗─▄ē“▒Ż│ųĮėĮ³įŁ╩╝─Żą═Ą─ąį─▄Ż¼▀mė├ė┌┘Yį┤╩▄Ž▐Ą─įOéõ╔Ž▓┐╩┤¾ą═─Żą═Ż¼▒╚╚ńŲš═©Ą─éĆ╚╦ļŖ─X╗“š▀ęŲäėįOéõĪŻ

ĪĪĪĪ╬─š┬ā╚(n©©i)╚▌āH╣®ķåūxŻ¼▓╗śŗ│╔═Č┘YĮ©ūhŻ¼šłųö╔„ī”┤²ĪŻ═Č┘Yš▀ō■(j©┤)┤╦▓┘ū„Ż¼’LļUūįō·ĪŻ

║Żł¾╔·│╔ųą...

║Ż╦ćAIĄ──Żą═ŽĄĮy(t©»ng)į┌ć°ļH╩ął÷╔ŽÅV╩▄║├įuŻ¼─┐Ū░šŠā╚(n©©i)└█ėŗ─Żą═öĄ(sh©┤)│¼▀^80╚féĆŻ¼║Ł╔wīæīŹĪóČ■┤╬į¬Īó▓Õ«ŗĪóįOėŗĪóözė░Īó’LĖ±╗»łDŽ±Ą╚ČÓŅÉą═æ¬ė├ł÷Š░Ż¼╗∙▒ŠĖ▓╔w╦∙ėąų„┴„äō(chu©żng)ū„’LĖ±ĪŻ

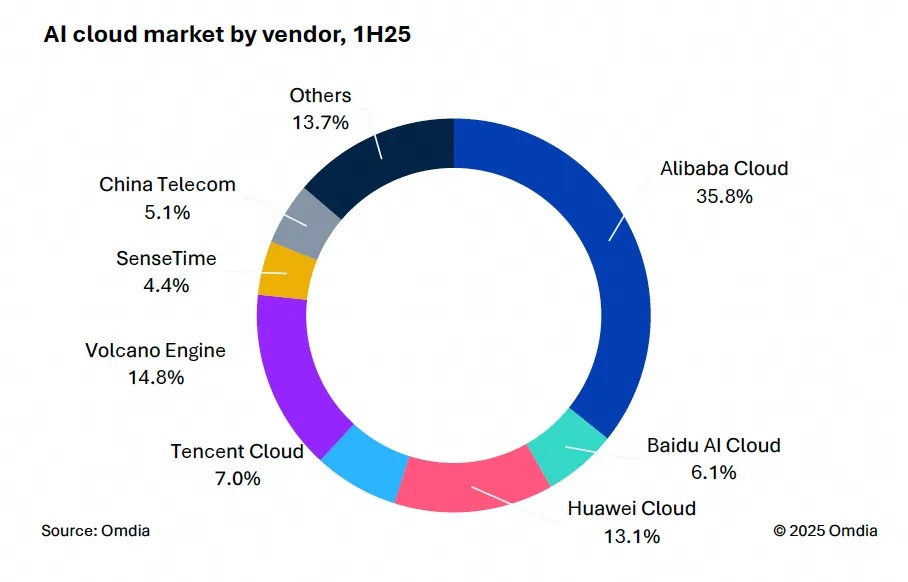

9į┬9╚šŻ¼ć°ļHÖÓ═■╩ął÷š{(di©żo)čąÖCśŗėóĖ╗┬³(Omdia)░l(f©Ī)▓╝┴╦ĪČųąć°AIįŲ╩ął÷Ż¼1H25ĪĘł¾ĖµĪŻųąć°AIįŲ╩ął÷░ó└’įŲš╝▒╚8%╬╗┴ąĄ┌ę╗ĪŻ

9į┬24╚šŻ¼╚A×ķ└żņ`š┘ķ_Ī░ųŪ─▄¾w“ׯ¼ę╗Ų┴ĄĮ╬╗Ī▒╚A×ķIdeaHubŪ¦ąą░┘śI(y©©)¾w“×╣┘ėŗäØ░l(f©Ī)▓╝Ģ■ĪŻ

č┼±R╣■ū“╚šą¹▓╝═Ų│÷ā╔┐ŅŅ^┤„╩ĮČ·ÖCŻ¼Ęųäe╩ŪŲĮ░Õš±─żĄ─YH-4000║═äė╚”įŁ└ĒĄ─YH-C3000ĪŻ

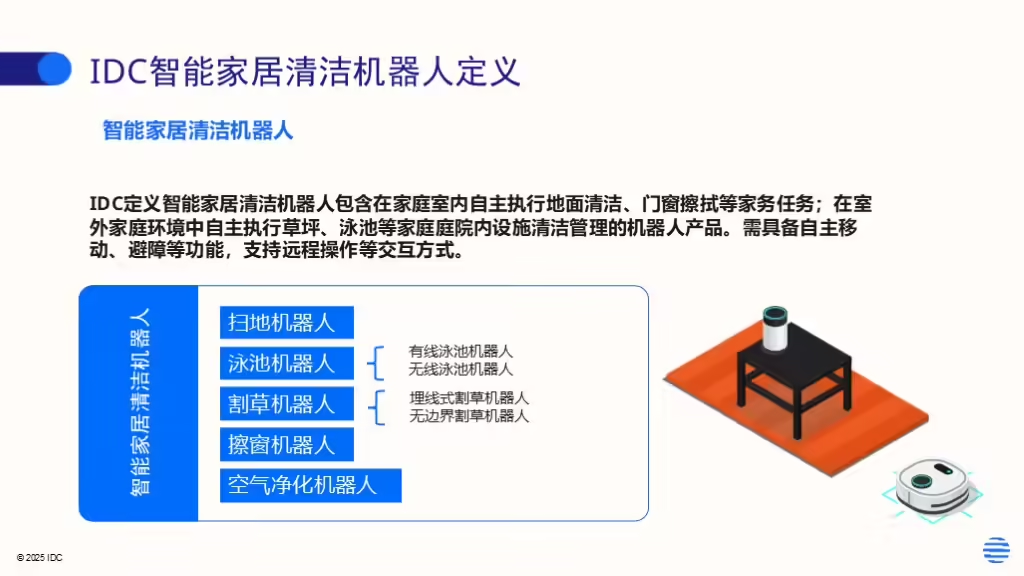

IDCĮ±╚š░l(f©Ī)▓╝Ą─ĪČ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖCŲ„╚╦įOéõ╩ął÷╝ŠČ╚Ė·█Öł¾ĖµŻ¼2025─ĻĄ┌Č■╝ŠČ╚ĪĘ’@╩ŠŻ¼╔Ž░ļ─Ļ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖCŲ„╚╦╩ął÷│÷žø1,2╚f┼_Ż¼═¼▒╚į÷ķL33%Ż¼’@╩Š│÷ŲĘŅÉÅŖä┼Ą─╩ął÷ąĶŪ¾ĪŻ