ĪĪĪĪūŅĮ³Ż¼╚╦éā░l¼F┴╦ę╗éĆėą╚żĄ─¼FŽ¾Ż¼╝┤AI─Żą═į┌▀xō±öĄūųĢr▒Ē¼F│÷ŅÉ╦Ų╚╦ŅÉĄ─┘Å┘I║═▒▄║├ąą×ķŻ¼▀@ūC├„┴╦─Żą═į┌╗ž┤å¢Ņ}ĢrųžÅ═ė¢ŠÜöĄō■ųąĄ─│ŻęŖā╚╚▌ĪŻ▀@ĘNąą×ķŠ▀ėą┤_Č©“╚╦ąį╗»”Ą─╠ž³cŻ¼ļm╚╗─Żą═▒Š╔Ē▓ó▓╗Š▀éõ╚╦ŅÉĄ─šJų¬─▄┴”ĪŻ

ĪĪĪĪį┌īŹ“×ųąŻ¼ę╗ą®╣ż│╠Ĥę¬Ū¾ÄūéĆų„ꬥ─LLM┴─╠ņÖCŲ„╚╦ļSÖC▀x╚Ī0ĄĮ100ų«ķgĄ─öĄūųĪŻĮY╣¹’@╩ŠŻ¼╦∙ėą─Żą═Č╝ėąę╗éĆ“ūŅŽ▓ÜgĄ─”öĄūųŻ¼▒Ē├„╦³éāį┌▀xō±öĄūųĢr▒Ē¼F│÷┴╦Ų½║├ĪŻ╝┤╩╣į┌“£žČ╚”Ž┬Ż¼▀@╚²éĆ─Żą═į┌▀xō±Ą─Ųõ╦¹öĄūųĢrę▓▒Ē¼F│÷ŅÉ╦Ų╚╦ŅÉĄ─Ų½ęŖĪŻ▀@ĘN¼FŽ¾Įę╩Š┴╦╚╦╣żųŪ─▄─Żą═▒Ē¼F│÷Ą─“╚╦ąį╗»”╠žš„Ż¼ĮŌ┤╚╦éā┼c▀@ą®ŽĄĮyĢrąĶę¬ėøūĪŲõ─ŻĘ┬╚╦ŅÉąą×ķĄ─▒Š┘|╠ß╣®┴╦åó╩ŠĪŻ

ĪĪĪĪGramener Ą─ę╗ą®╣ż│╠Ĥ▀Mąą┴╦ę╗ĒŚĘŪš²╩ĮĄ½╚į╚╗ę²╚╦╚ļä┘Ą─īŹ“ׯ¼╦¹éā║åå╬Ąžę¬Ū¾ÄūéĆų„ꬥ─ LLM ┴─╠ņÖCŲ„╚╦į┌0ĄĮ100ų«ķg▀xō±ę╗éĆļSÖCöĄūųŻ¼ĮY╣¹▓ó▓╗ļSÖCĪŻ

ĪĪĪĪ╚²éĆĮø▀^£yįćĄ──Żą═Č╝ėąę╗éĆ “Ž▓Üg” Ą─öĄūųŻ¼į┌ūŅ┤_Č©ąįĄ──Ż╩ĮŽ┬Ż¼▀@éĆöĄūų┐é╩Ū╦³éāĄ─┤░ĖŻ¼Ą½╝┤╩╣į┌Ė³Ė▀Ą─ “£žČ╚” Ž┬Ż¼▀@éĆöĄūųę▓Įø│Ż│÷¼FŻ¼Č° “£žČ╚” ╩Ū─Żą══©│ŻŠ▀ėąĄ─ę╗ĘNįOų├Ż¼┐╔ęįį÷╝ėŲõĮY╣¹Ą─ūā╗»ąįĪŻ

ĪĪĪĪOpenAI Ą─ GPT-3.5Turbo ĘŪ│ŻŽ▓Üg47ĪŻ┤╦Ū░Ż¼╦³Ž▓Üg42—— ▀@éĆöĄūų«ö╚╗ę“Ą└Ė±└Ł╦╣・üå«ö╦╣į┌ĪČŃy║ėŽĄ┬■ė╬ųĖ─ŽĪĘųąīóŲõČ©┴x×ķ╔·├³ĪóėŅųµ║═ę╗ŪąĄ─┤░ĖČ°┬ä├¹ĪŻAnthropic Ą─ Claude3 Haiku ▀xō±┴╦42Ż¼Gemini Ž▓Üg72ĪŻ

ĪĪĪĪĖ³ėą╚żĄ─╩ŪŻ¼╦∙ėą╚²éĆ─Żą═į┌▀xō±Ųõ╦¹öĄūųĢrČ╝š╣¼F│÷ŅÉ╦Ų╚╦ŅÉĄ─Ų½ęŖĪŻ

ĪĪĪĪ╦∙ėą─Żą═Č╝āAŽ“▒▄├Ō▀xō±Ą═╬╗║═Ė▀╬╗öĄūųŻ¼Claude Å─▓╗▀xō±│¼▀^87╗“Ą═ė┌27Ą─öĄūųŻ¼╝┤╩╣ėą▀@śėĄ─öĄūųŻ¼ę▓╩Ū«É│ŻųĄĪŻā╔╬╗ųžÅ═Ą─öĄę▓▒╗ć└Ė±▒▄├Ō:ø]ėą33Īó55╗“66Ż¼Ą½77│÷¼F┴╦(ęį7ĮY╬▓)ĪŻÄū║§ø]ėąęį0ĮY╬▓Ą─öĄūų —— ▒M╣▄ Gemini ėąĢrĢ■▀xō±0ĪŻ

ĪĪĪĪ×ķ╩▓├┤Ģ■▀@śė─ž?AI ▓╗╩Ū╚╦ŅÉ!╦³éā×ķ╩▓├┤į┌ęŌ “╦Ų║§” ļSÖC?╦³éāūŅĮKęčĮø½@Ą├┴╦ęŌūRŻ¼▀@╩Ū╦³éāš╣╩ŠĄ─ĘĮ╩Įåß?

ĪĪĪĪ▓╗ĪŻŠ═Ž±═©│ŻĄ─Ūķørę╗śėŻ¼╬ęéā▀^Č╚┘xėĶ┴╦öM╚╦╗»ĪŻ▀@ą®─Żą═▓ó▓╗ĻPą─╩▓├┤╩ŪļSÖCĄ─ĪŻ╦³éā▓╗ų¬Ą└ “ļSÖCąį” ╩Ū╩▓├┤!╦³éā╗ž┤▀@éĆå¢Ņ}Ą─ĘĮ╩Į┼c╗ž┤Ųõ╦¹å¢Ņ}Ą─ĘĮ╩ĮŽÓ═¼:▓ķ┐┤╦³éāĄ─ė¢ŠÜöĄō■Ż¼ųžÅ═į┌┐┤ŲüĒŽ± “▀xō±ę╗éĆļSÖCöĄūų” Ą─å¢Ņ}ų«║¾ūŅ│Ż│÷¼FĄ─ā╚╚▌ĪŻ╦³│÷¼FĄ─┤╬öĄįĮČÓŻ¼─Żą═Š═ųžÅ═╦³Ą─┤╬öĄįĮČÓĪŻ

ĪĪĪĪ▒M╣▄╚╦╣żųŪ─▄─Żą═Ą─▀@ĘNąą×ķ▒╗šJ×ķ╩Ū“╚╦ąį╗»”Ą─╠ž³cŻ¼Ą½╬ęéāąĶę¬ęŌūRĄĮ▀@▓ó▓╗┤·▒Ē─Żą═Š▀ėąšµš²Ą─šJų¬─▄┴”ĪŻ─Żą═▀xō±Ą─öĄūųąą×ķīŹļH╔Žų╗╩Ū─Żą═ųžÅ═ė¢ŠÜöĄō■ųąĄ─│ŻęŖā╚╚▌Ż¼ę“×ķ─Żą═▒Š╔Ē▓ó▓╗└ĒĮŌļSÖCąįŻ¼¤oĘ©▀Mąąėąą¦▀MąąĪŻę“┤╦Ż¼į┌▀@ą®ŽĄĮyĄ─╗źäėųąŻ¼╚╦éāąĶę¬└╬ėø╦³éāų╗╩Ū─ŻĘ┬Ą─╚╦ŅÉąą×ķŻ¼Č°▓óĘŪšµš²╦╝┐╝╗“└ĒĮŌĪŻ

ĪĪĪĪ╬─š┬ā╚╚▌āH╣®ķåūxŻ¼▓╗śŗ│╔═Č┘YĮ©ūhŻ¼šłųö╔„ī”┤²ĪŻ═Č┘Yš▀ō■┤╦▓┘ū„Ż¼’LļUūįō·ĪŻ

║Żł¾╔·│╔ųą...

║Ż╦ćAIĄ──Żą═ŽĄĮyį┌ć°ļH╩ął÷╔ŽÅV╩▄║├įuŻ¼─┐Ū░šŠā╚└█ėŗ─Żą═öĄ│¼▀^80╚féĆŻ¼║Ł╔wīæīŹĪóČ■┤╬į¬Īó▓Õ«ŗĪóįOėŗĪóözė░Īó’LĖ±╗»łDŽ±Ą╚ČÓŅÉą═æ¬ė├ł÷Š░Ż¼╗∙▒ŠĖ▓╔w╦∙ėąų„┴„äōū„’LĖ±ĪŻ

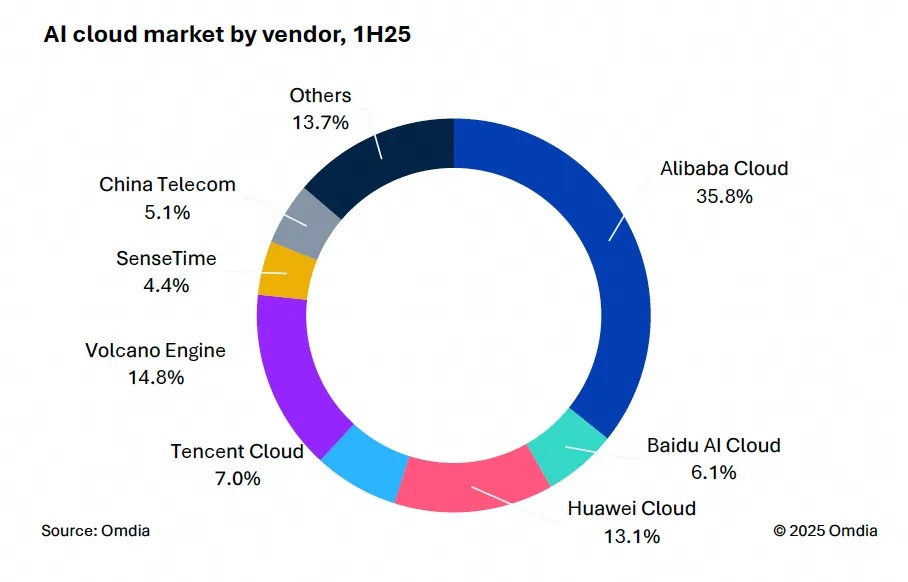

9į┬9╚šŻ¼ć°ļHÖÓ═■╩ął÷š{čąÖCśŗėóĖ╗┬³(Omdia)░l▓╝┴╦ĪČųąć°AIįŲ╩ął÷Ż¼1H25ĪĘł¾ĖµĪŻųąć°AIįŲ╩ął÷░ó└’įŲš╝▒╚8%╬╗┴ąĄ┌ę╗ĪŻ

9į┬24╚šŻ¼╚A×ķ└żņ`š┘ķ_Ī░ųŪ─▄¾w“ׯ¼ę╗Ų┴ĄĮ╬╗Ī▒╚A×ķIdeaHubŪ¦ąą░┘śI¾w“×╣┘ėŗäØ░l▓╝Ģ■ĪŻ

č┼±R╣■ū“╚šą¹▓╝═Ų│÷ā╔┐ŅŅ^┤„╩ĮČ·ÖCŻ¼Ęųäe╩ŪŲĮ░Õš±─żĄ─YH-4000║═äė╚”įŁ└ĒĄ─YH-C3000ĪŻ

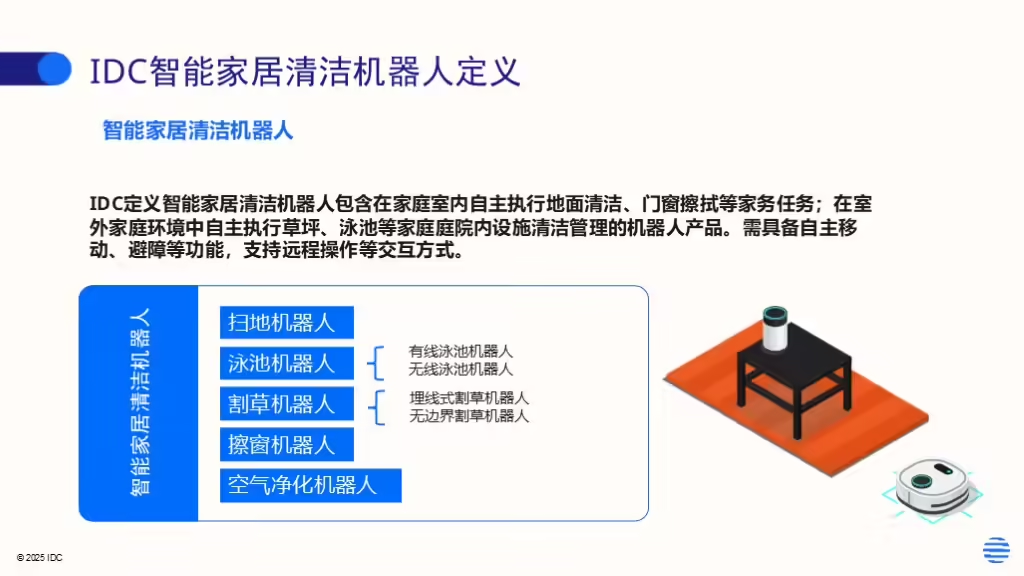

IDCĮ±╚š░l▓╝Ą─ĪČ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖCŲ„╚╦įOéõ╩ął÷╝ŠČ╚Ė·█Öł¾ĖµŻ¼2025─ĻĄ┌Č■╝ŠČ╚ĪĘ’@╩ŠŻ¼╔Ž░ļ─Ļ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖCŲ„╚╦╩ął÷│÷žø1,2╚f┼_Ż¼═¼▒╚į÷ķL33%Ż¼’@╩Š│÷ŲĘŅÉÅŖä┼Ą─╩ął÷ąĶŪ¾ĪŻ