ĪĪĪĪĮ³─ĻüĒŻ¼┤¾ą═šZčį─Żą═(LLMs)į┌ūį╚╗šZčį╠Ä└Ē(NLP)ŅIė“╚ĪĄ├┴╦’@ų°▀Mš╣Ż¼ÅVĘ║æ¬ė├ė┌╬─▒Š╔·│╔Īóš¬ę¬║═å¢┤Ą╚ł÷Š░ĪŻ╚╗Č°Ż¼▀@ą®─Żą═ę└┘ćė┌ųūųŅA£yĄ─ token ╝ē╠Ä└ĒĘĮĘ©Ż¼▀@ĘNĘĮ╩Įį┌└ĒĮŌ╔ŽŽ┬╬─Ģr┤µį┌└¦ļyŻ¼Ūę═∙═∙«a╔·▓╗ę╗ų┬Ą─▌ö│÷ĪŻ┤╦═ŌŻ¼īó LLMs öUš╣ĄĮČÓšZčį║═ČÓ─ŻæBæ¬ė├ĢrŻ¼ėŗ╦Ń│╔▒Š║═öĄō■ąĶŪ¾ę▓ŽÓī”▌^Ė▀ĪŻ×ķ┴╦ĮŌøQ▀@ą®å¢Ņ}Ż¼Meta AI ╠ß│÷┴╦ę╗ĘN╚½ą┬Ą─ĘĮĘ© —— ┤¾Ė┼─Ņ─Żą═(LCMs)ĪŻ

ĪĪĪĪ┤¾Ė┼─Ņ─Żą═(LCMs)┤·▒Ē┴╦é„Įy LLM ╝▄śŗĄ─ę╗┤╬ųžę¬▐DūāĪŻ╦³éāę²╚ļ┴╦ā╔éĆųž┤¾äōą┬:╩ūŽ╚Ż¼LCMs į┌ę╗éĆĖ▀ŠSŪČ╚ļ┐šķgųą▀MąąĮ©─ŻŻ¼Č°▓╗╩Ūę└┘ćė┌ļx╔óĄ─ tokensĪŻ▀@ę╗ŪČ╚ļ┐šķg▒╗ĘQ×ķ SONARŻ¼ų╝į┌ų¦│ų200ČÓĘNšZčį║═ČÓĘN─ŻæBŻ¼░³└©╬─▒Š║═šZ궯¼╠ß╣®šZčį║═─ŻæB¤oĻPĄ─╠Ä└Ē─▄┴”ĪŻŲõ┤╬Ż¼LCMs Ą─įOėŗį╩įSį┌šZ┴xīė├µ╔Ž¤o┐p▀^Č╔Ż¼─▄ē“į┌▓╗═¼šZčį║═─ŻæBų«ķgīŹ¼FÅŖ┤¾Ą─┴Ń - shot Ę║╗»─▄┴”ĪŻ

ĪĪĪĪį┌ LCMs Ą─║╦ą─Ż¼┤µį┌Ė┼─ŅŠÄ┤aŲ„║═ĮŌ┤aŲ„Ż¼▀@ą®ĮM╝■īó▌ö╚ļŠõūėė│╔õĄĮ SONAR Ą─ŪČ╚ļ┐šķgŻ¼▓óīóŪČ╚ļĮŌ┤a╗žūį╚╗šZčį╗“Ųõ╦¹─ŻæBĪŻ▀@ą®ĮM╝■Ą─ā÷ĮYįOėŗ┤_▒Ż┴╦─ŻēK╗»Ż¼ĘĮ▒Ńį┌▓╗ųžė¢š¹éĆ─Żą═Ą─ŪķørŽ┬öUš╣ą┬šZčį╗“─ŻæBĪŻ

ĪĪĪĪ╝╝ąg╝Ü╣ØĘĮ├µŻ¼LCMs ▓╔ė├┴╦īė┤╬╗»╝▄śŗŻ¼─ŻĘ┬╚╦ŅÉĄ─═Ų└Ē▀^│╠Ż¼Å─Č°╠ß╔²┴╦ķLŲ¬ā╚╚▌Ą─ę╗ų┬ąįŻ¼═¼Ģr─▄ē“į┌▓╗Ė╔ö_š¹¾w╔ŽŽ┬╬─Ą─ŪķørŽ┬▀MąąŠų▓┐ŠÄ▌ŗĪŻ═©▀^▓╔ė├öU╔ó─Żą═Ż¼LCMs į┌╔·│╔▀^│╠ųą▒Ē¼F│÷╔½Ż¼▀@ą®─Żą═╗∙ė┌Ū░├µĄ─ŪČ╚ļŅA£yŽ┬ę╗éĆ SONAR ŪČ╚ļĪŻīŹ“×ųąŻ¼▓╔ė├┴╦å╬╦■║═ļp╦■ā╔ĘN╝▄śŗŻ¼Ųõųąļp╦■╝▄śŗį┌╔ŽŽ┬╬─ŠÄ┤a║═╚źįļ╔ŽĘųķ_╠Ä└ĒŻ¼╠ßĖ▀┴╦ą¦┬╩ĪŻ

ĪĪĪĪīŹ“×ĮY╣¹’@╩ŠŻ¼╗∙ė┌öU╔óĄ─ļp╦■ LCM į┌ČÓéĆ╚╬äšųąš╣¼F┴╦ĖéĀÄ┴”Ż¼╚ńČÓšZčįš¬ę¬╚╬äšųąŻ¼LCMs į┌┴Ń - shot ŪķørŽ┬Ą─▒Ē¼Fā×ė┌╗∙ŠĆ─Żą═Ż¼ūC├„┴╦╦³éāĄ─▀mæ¬─▄┴”ĪŻ═¼ĢrŻ¼LCMs į┌╠Ä└Ē▌^Č╠ą“┴ąĢrę▓▒Ē¼F│÷Ė▀ą¦ąį║═£╩┤_ąįŻ¼ŽÓĻPČ╚┴┐ųĖś╦Ą─’@ų°╠ß╔²ėĪūC┴╦▀@ę╗³cĪŻ

ĪĪĪĪMeta AI Ą─┤¾Ė┼─Ņ─Żą═×ķé„Įy token ╝ēšZčį─Żą═╠ß╣®┴╦ę╗ĘNėąŪ░═ŠĄ─╠µ┤·ĘĮ░ĖŻ¼═©▀^Ė▀ŠSĖ┼─ŅŪČ╚ļ║═─ŻæB¤oĻPĄ─╠Ä└ĒŻ¼ĮŌøQ┴╦¼FėąĘĮĘ©Ą─ę╗ą®ĻPµIŠųŽ▐ĪŻļSų°ī”▀@ę╗╝▄śŗ蹊┐Ą─╔Ņ╚ļŻ¼LCMs ėą═¹ųžą┬Č©┴xšZčį─Żą═Ą──▄┴”Ż¼×ķ AI “īäėĄ─£Ž═©╠ß╣®Ė³Š▀┐╔öUš╣ąį║═▀mæ¬ąįĄ─ĘĮĘ©ĪŻ

ĪĪĪĪ╬─š┬ā╚╚▌āH╣®ķåūxŻ¼▓╗śŗ│╔═Č┘YĮ©ūhŻ¼šłųö╔„ī”┤²ĪŻ═Č┘Yš▀ō■┤╦▓┘ū„Ż¼’LļUūįō·ĪŻ

║Żł¾╔·│╔ųą...

║Ż╦ćAIĄ──Żą═ŽĄĮyį┌ć°ļH╩ął÷╔ŽÅV╩▄║├įuŻ¼─┐Ū░šŠā╚└█ėŗ─Żą═öĄ│¼▀^80╚féĆŻ¼║Ł╔wīæīŹĪóČ■┤╬į¬Īó▓Õ«ŗĪóįOėŗĪóözė░Īó’LĖ±╗»łDŽ±Ą╚ČÓŅÉą═æ¬ė├ł÷Š░Ż¼╗∙▒ŠĖ▓╔w╦∙ėąų„┴„äōū„’LĖ±ĪŻ

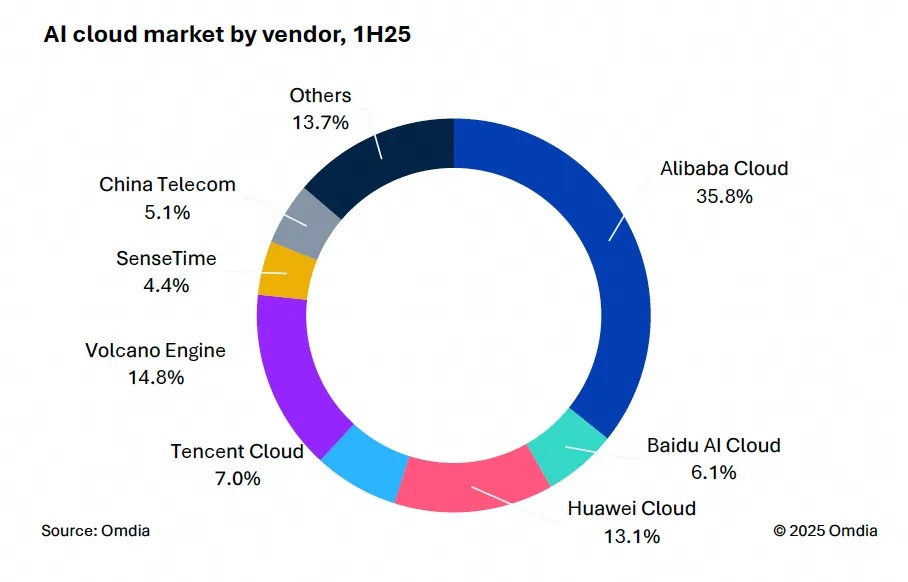

9į┬9╚šŻ¼ć°ļHÖÓ═■╩ął÷š{čąÖCśŗėóĖ╗┬³(Omdia)░l▓╝┴╦ĪČųąć°AIįŲ╩ął÷Ż¼1H25ĪĘł¾ĖµĪŻųąć°AIįŲ╩ął÷░ó└’įŲš╝▒╚8%╬╗┴ąĄ┌ę╗ĪŻ

9į┬24╚šŻ¼╚A×ķ└żņ`š┘ķ_Ī░ųŪ─▄¾w“ׯ¼ę╗Ų┴ĄĮ╬╗Ī▒╚A×ķIdeaHubŪ¦ąą░┘śI¾w“×╣┘ėŗäØ░l▓╝Ģ■ĪŻ

č┼±R╣■ū“╚šą¹▓╝═Ų│÷ā╔┐ŅŅ^┤„╩ĮČ·ÖCŻ¼Ęųäe╩ŪŲĮ░Õš±─żĄ─YH-4000║═äė╚”įŁ└ĒĄ─YH-C3000ĪŻ

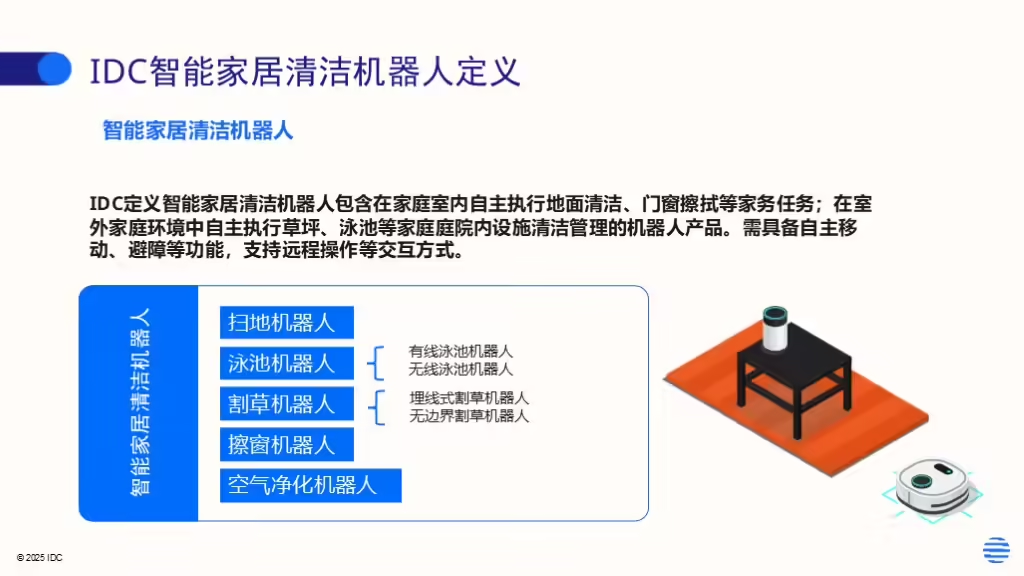

IDCĮ±╚š░l▓╝Ą─ĪČ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖCŲ„╚╦įOéõ╩ął÷╝ŠČ╚Ė·█Öł¾ĖµŻ¼2025─ĻĄ┌Č■╝ŠČ╚ĪĘ’@╩ŠŻ¼╔Ž░ļ─Ļ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖCŲ„╚╦╩ął÷│÷žø1,2╚f┼_Ż¼═¼▒╚į÷ķL33%Ż¼’@╩Š│÷ŲĘŅÉÅŖä┼Ą─╩ął÷ąĶŪ¾ĪŻ