ĪĪĪĪį┌░l▓╝▓╗ĄĮę╗ų▄║¾Ż¼Amazon Q —— üå±R▀dī”┐╣ Copilot Ą─╔·│╔╩Į AI ų·╩ų——ęč├µ┼R╔·┤µ═■├{Ż¼ę╗Ę▌ą┬ł¾Ėµ’@╩Š▀@┐Ņ AI ų·╩ų┐╔─▄«a╔·ĪĖć└ųž╗├ėXĪ╣ĪŻ

ĪĪĪĪō■ The Platformerį«ę²ą╣┬Č╬─╝■ł¾Ą└Ż¼Q š²├µ┼R£╩┤_ąį║═ļ[╦Įå¢Ņ}Ż¼░³└©╗├ėX║═öĄō■ą╣┬ČĪŻųĄĄ├ūóęŌĄ─╩ŪŻ¼▀@ę╗ł¾Ą└š²ųĄā╔ĒŚųžę¬čąŠ┐’@╩ŠŻ¼┤¾ą═šZčį─Żą═(LLM)į┌▀BĮėŲ¾śIöĄō■ÄņĢrĖ▀Č╚▓╗£╩┤_Ż¼ŪęūāĄ├įĮüĒįĮ▓╗═Ė├„ų«ļH░l▓╝ĪŻ

ĪĪĪĪ╚╗Č°Ż¼ō■üå±R▀dę╗╬╗░lčį╚╦▒Ē╩ŠŻ¼Amazon Q ▓ó╬┤ą╣┬Č╚╬║╬ÖC├▄ą┼ŽóĪŻ

ĪĪĪĪĪĖę╗ą®åT╣ż═©▀^ā╚▓┐Ū■Ą└║═╣żå╬ŽĄĮyĘųŽĒĘ┤üŻ¼▀@╩Ūüå±R▀dĄ─ś╦£╩ū÷Ę©ĪŻ─Ūą®Ę┤ü▓ó╬┤ūRäe│÷╚╬║╬░▓╚½å¢Ņ}ĪŻ╬ęéāĖąųx╩šĄĮĄ─╦∙ėąĘ┤üŻ¼▓óīó└^└mš{š¹ QŻ¼╩╣ŲõÅ─ŅAė[«aŲĘ▀^Č╔ĄĮŲš▒ķ┐╔ė├Ż¼Ī╣įō░lčį╚╦▒Ē╩ŠĪŻ

ĪĪĪĪ▒M╣▄üå±R▀d┬ĢĘQŲõ×ķöĄ░┘╚f╚╦Ą─╣żū„╗’░ķŻ¼Ęų╬÷╚╦╩┐šJ×ķüå±R▀d Q ┐╔─▄▀Ć╬┤£╩éõ║├ė├ė┌Ų¾śIŁhŠ│ĪŻ

ĪĪĪĪEIIRTrend & Pareekh Consulting ╩ūŽ»ł╠ąą╣┘ Pareekh Jain ▒Ē╩ŠŻ║ĪĖ╚ń╣¹┤µį┌╗├ėXŻ¼Š═▓╗─▄į┌Ų¾śIŁhŠ│ųąė├ė┌øQ▓▀ĪŻ╦³▀mė├ė┌éĆ╚╦╩╣ė├╗“½@╚Īą┼ŽóŻ¼Ą½▓╗▀mė├ė┌øQ▓▀▀^│╠ĪŻĪ╣

ĪĪĪĪĖ³ČÓ£yįćąĶŪ¾

ĪĪĪĪüå±R▀d┐╔─▄į┌Ųõ╔·│╔╩Į AI ų·╩ų£╩éõ║├╔╠śI░l▓╝ų«Ū░├µ┼Rųž┤¾Ą─£yįć╠¶æĪŻJain ÅŖš{┴╦▀MąąÅVĘ║ā╚▓┐įć“×ęį┤_▒Ż£╩éõŠ═ŠwĄ─ųžę¬ąįĪŻ

ĪĪĪĪĪĖ╬ęšJ×ķ╦¹éāąĶꬎ╚ī”ā╚▓┐åT╣ż▀MąąĖ³ČÓ£yįćŻ¼Ī╣Jain ča│õĄ└ĪŻĪĖ’@╚╗Ż¼▀@š²╩Ū╦¹éā¼Fį┌š²į┌ū÷Ą─ĪŻūŅĮKŻ¼ø]ėą═Ō▓┐üĒį┤ł¾Ėµ▀@ą®å¢Ņ}ĪŻ▀@└’ėąā╔éĆĘĮ├µŻ║ę╗╩ŪöĄō■Ż¼┴Ēę╗éĆ╩Ū╦ŃĘ©ĪŻ╦¹éā▒žĒÜ┐┤┐┤▀@╩ŪöĄō■å¢Ņ}▀Ć╩Ū╦ŃĘ©å¢Ņ}ĪŻĪ╣

ĪĪĪĪQ └¹ė├┴╦ 17 ─Ļ AWS Ą─öĄō■║═ķ_░lĮø“ׯ¼ų╝į┌ū„×ķŲ¾śIĄ─ČÓ╣”─▄╣żŠ▀ĪŻĶbė┌ąąśIĄ─░lš╣ĘĮŽ“Ż¼üå±R▀dį┌▀@┐Ņ AI «aŲĘ╔Ž═Č╚ļ┴╦Š▐┤¾Ą─┘ĆūóĪŻ

ĪĪĪĪ▒M╣▄ĪĖ╗├ėXĪ╣▓ó▓╗Ž„╚§╔·│╔╩Į AI į┌Ž¹┘Mš▀║═Ų¾śIė├└²ųąĄ─Øō┴”Ż¼Ą½▀m«öĄ─ė¢ŠÜų┴ĻPųžę¬Ż¼╩ął÷蹊┐╣½╦Š IDC Ą─Ė▒┐é▓├ Sharath Srinivasamurthy ▒Ē╩ŠĪŻ

ĪĪĪĪĪĖį┌Ė³Ė▀┘|┴┐öĄō■╔Žė¢ŠÜ─Żą═Īó╠ß╩Šį÷ÅŖ(ę²ī¦ė├æ¶╩╣ė├─Żą═╚▌ęū└ĒĮŌĄ─ŅAČ©┴x╠ß╩Š)Īóßśī”ĮM┐Ś╗“ąąśI╠žČ©öĄō■║═š■▓▀▓╗öÓ╬óš{─Żą═Īóį┌Ēææ¬┐╔ę╔Ģrį÷╝ė╚╦╣żÖz▓ķīėŻ¼▀@ą®Č╝╩ŪąĶę¬▓╔╚ĪĄ─▓Į¾EŻ¼ęį│õĘų└¹ė├▀@ĒŚą┬┼d╝╝ągŻ¼Ī╣Srinivasamurthy šfĪŻ

ĪĪĪĪ╗├ėX╩ŪʱĢ■┤┘╩╣Ų╚ŪąąĶę¬▀Mąą▒O╣▄?

ĪĪĪĪĻPė┌╗├ėXĄ─ł¾Ėµę²░l┴╦ī”▒O╣▄ąĶę¬║═┐╔─▄į┌─│ę╗Ģr┐╠╔·ą¦Ą─ęÄätć└ųžąįĄ─ō·ænĪŻ╚╗Č°Ż¼Greyhound Research ╩ūŽ»Ęų╬÷Ĥ╝µ CEO Sanchit Vir Gogia ųĖ│÷Ż¼╚╬║╬ė╔┤╦«a╔·Ą─▒O╣▄┐╔─▄▀mĄ├ŲõĘ┤ĪŻ

ĪĪĪĪĪĖ╩┬īŹ╔ŽŻ¼╚╬║╬▒O╣▄Č╝┐╔─▄£pŠÅöĄō■Ą─Į╗ōQ║═└¹ė├Ż¼Ī╣Gogia šfĪŻĪĖę“┤╦Ż¼─┐Ū░üĒšfŻ¼▀@éĆąąśIįĮ▓╗╩▄▒O╣▄įĮ║├ĪŻ▀@į╩įSĖ³╚▌ęūĪóĖ³ĒśĢ│Ąž╩╣ė├öĄō■ĪŻęį OpenAI Ą─ GPT ×ķ└²——╚ń╣¹ī”┐╔▓Č½@öĄō■įOų├ć└Ė±Ą─Ę└ūoÖ┌Ż¼─Ū├┤╦³Š═▓╗Ģ■╚ĪĄ├│╔╣”ĪŻĪ╣

ĪĪĪĪJain ę▓Į©ūhŻ¼įOų├═Ō▓┐▀ģĮń┐╔─▄▓╗╩Ūę╗éĆ┐╔ąąĄ─ŽļĘ©Ż¼Ą½╣½╦Š▒Š╔Ē┐╔─▄Ģ■ĖČ│÷Ė³ČÓ┼¼┴”ĪŻ

ĪĪĪĪĪĖ▒O╣▄┐╔─▄┤µį┌Ż¼Ą½ųž³cų„ę¬╩Ūūį╬ę▒O╣▄Ż¼Ī╣Jain ĮŌßīšfĪŻĪĖ▒M╣▄▒O╣▄║═ųĖī¦ĘĮßś╩Ū▒žę¬Ą─Ż¼Ą½ī”ė┌─▄ē“ł╠ąąĄ─īÅ║╦│╠Č╚ėąę╗Č©Ą─Ž▐ųŲĪŻųž³cæ¬įō╩Ūžōž¤╚╬Ą─ AIŻ¼ŲõųąĄ─▀ē▌ŗ┐╔ęįŽ“┐═æ¶ĮŌßīŻ¼Č°▓╗╩ŪäōĮ©Ī║║┌ŽõĪ╗ŽĄĮyĪŻ╚╗Č°Ż¼į┌╬ę┐┤üĒŻ¼ėąę╗éĆķōųĄŻ¼│¼▀^▀@éĆķōųĄŻ¼ž¤╚╬Ė³ČÓĄž▐DŽ“Ų¾śI╚ń║╬ū„×ķ░▓╚½å¢Ņ}üĒ┐┤┤²║═īŹ╩®▀@ą®┤ļ╩®ĪŻĪ╣

ĪĪĪĪ╦∙ėą─┐╣ŌŠ█Į╣ė┌üå±R▀d

ĪĪĪĪļm╚╗▀@ą®ęŖĮŌ═╣’@┴╦Ė³ÅŖ┤¾Ą─ā╚▓┐£yįć║═ūį╬ę▒O╣▄āAŽ“Ą─▒žę¬ąįŻ¼Ą½į┌Ų¾śIŁhŠ│ųą▓┐╩ AI Ą─Ą└┬Ę│õØM┴╦Å═ļsąįĪŻ¼Fį┌üå±R▀dąĶę¬į┌▀@ą®╠¶æųąšęĄĮĘĮŽ“Ż¼╠žäe╩Ūę“×ķ╦³į┌▀@ę╗ŅIė“Ą─═ĒŲ┌▀M╚ļĪŻ

ĪĪĪĪĪĖAWS į┌▀@éĆŅIė“ėąą®┬õ║¾Ż¼─┐Ū░╬ó▄ø║═╣╚ĖĶš²į┌ŅIŽ╚Ż¼Ī╣Jain ča│õĄ└ĪŻĪĖę“┤╦Ż¼╚╦éāī”ė┌┴─╠ņÖCŲ„╚╦║═Ųõ╦¹ŽÓĻP╝╝ąg▒¦ėąĖ³Ė▀Ą─Ų┌═¹ĪŻĪ╣

ĪĪĪĪ╬─š┬ā╚╚▌āH╣®ķåūxŻ¼▓╗śŗ│╔═Č┘YĮ©ūhŻ¼šłųö╔„ī”┤²ĪŻ═Č┘Yš▀ō■┤╦▓┘ū„Ż¼’LļUūįō·ĪŻ

║Żł¾╔·│╔ųą...

║Ż╦ćAIĄ──Żą═ŽĄĮyį┌ć°ļH╩ął÷╔ŽÅV╩▄║├įuŻ¼─┐Ū░šŠā╚└█ėŗ─Żą═öĄ│¼▀^80╚féĆŻ¼║Ł╔wīæīŹĪóČ■┤╬į¬Īó▓Õ«ŗĪóįOėŗĪóözė░Īó’LĖ±╗»łDŽ±Ą╚ČÓŅÉą═æ¬ė├ł÷Š░Ż¼╗∙▒ŠĖ▓╔w╦∙ėąų„┴„äōū„’LĖ±ĪŻ

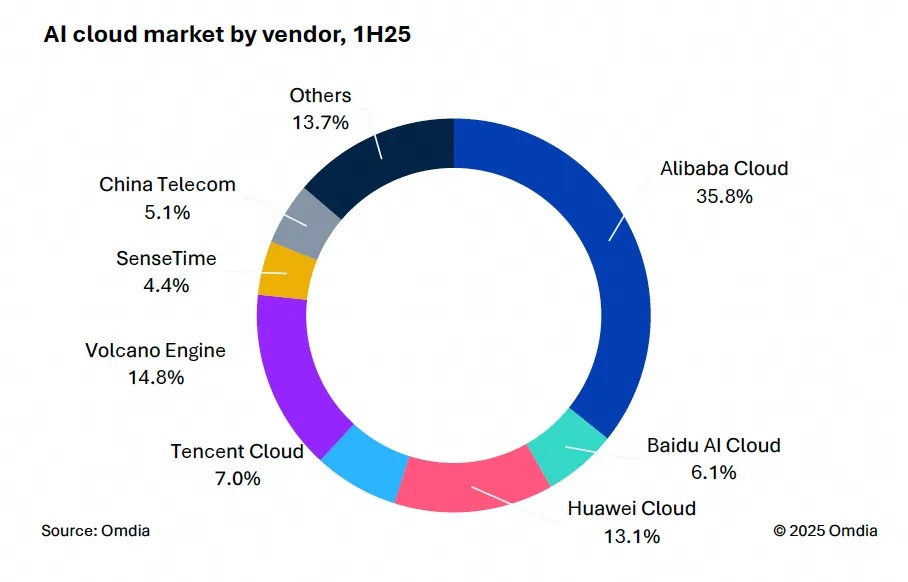

9į┬9╚šŻ¼ć°ļHÖÓ═■╩ął÷š{čąÖCśŗėóĖ╗┬³(Omdia)░l▓╝┴╦ĪČųąć°AIįŲ╩ął÷Ż¼1H25ĪĘł¾ĖµĪŻųąć°AIįŲ╩ął÷░ó└’įŲš╝▒╚8%╬╗┴ąĄ┌ę╗ĪŻ

9į┬24╚šŻ¼╚A×ķ└żņ`š┘ķ_Ī░ųŪ─▄¾w“ׯ¼ę╗Ų┴ĄĮ╬╗Ī▒╚A×ķIdeaHubŪ¦ąą░┘śI¾w“×╣┘ėŗäØ░l▓╝Ģ■ĪŻ

č┼±R╣■ū“╚šą¹▓╝═Ų│÷ā╔┐ŅŅ^┤„╩ĮČ·ÖCŻ¼Ęųäe╩ŪŲĮ░Õš±─żĄ─YH-4000║═äė╚”įŁ└ĒĄ─YH-C3000ĪŻ

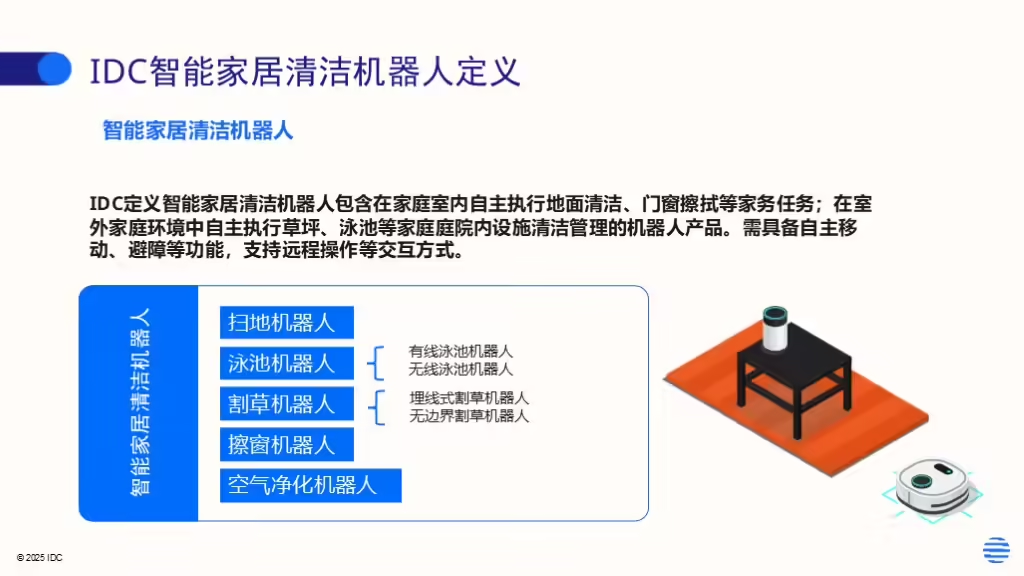

IDCĮ±╚š░l▓╝Ą─ĪČ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖCŲ„╚╦įOéõ╩ął÷╝ŠČ╚Ė·█Öł¾ĖµŻ¼2025─ĻĄ┌Č■╝ŠČ╚ĪĘ’@╩ŠŻ¼╔Ž░ļ─Ļ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖCŲ„╚╦╩ął÷│÷žø1,2╚f┼_Ż¼═¼▒╚į÷ķL33%Ż¼’@╩Š│÷ŲĘŅÉÅŖä┼Ą─╩ął÷ąĶŪ¾ĪŻ